MANUALE MICROSOFT AZURE

Per imparare a utilizzarlo, per ottenere la certificazione

CORSI APPLICAZIONI MICROSOFT 365 PER IL LAVORO - Segnalali agli amici, costano pochissimo

MOTORE DI RICERCA E SCHEDE DIDATTICHE SULLE APPLICAZIONI MICROSOFT 365

ORGANIZZA LO STUDIO PER IL CORSO/CONCORSO OSS CON QUESTO DIAGRAMMA DI GANTT

WIKI CARDS EXPLORER CON RIASSUNTO AUTOMATICO SU CLIC

Dona 1 Euro

PROGETTO FINALE – Realizzazione di un e-commerce. Breve illustrazione.

CAPITOLO 1 – Panoramica Generale

Introduzione generale su Azure

Inquadramento argomenti del capitolo con slides illustrate

1. Servizi principali di Azure – Compute, Storage, Networking

2. Organizzazione e gestione delle risorse con i Resource Groups

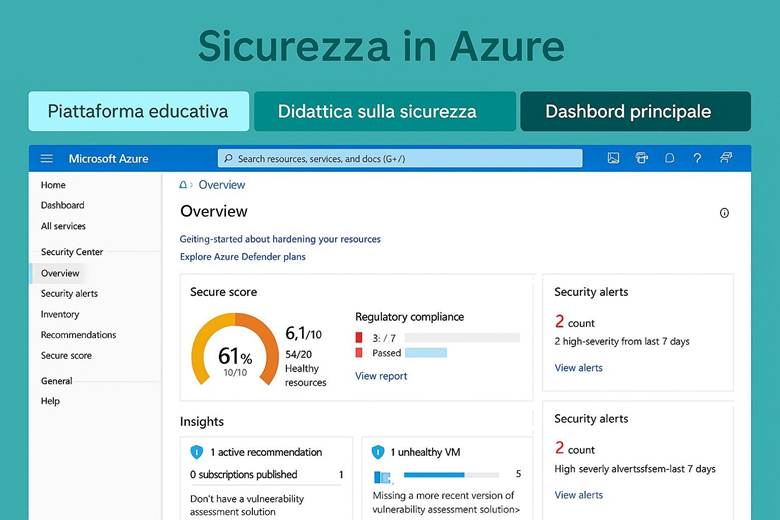

3. Sicurezza in Azure – Postura, Identità e Protezione dei Dati

4. Reti in Azure – Connettività sicura e flessibile

5. Archiviazione dei dati – Tipi di account e ridondanza

6. Servizi di calcolo – le Macchine Virtuali (VM) in dettaglio

7. Monitoraggio e Osservabilità con Azure Monitor

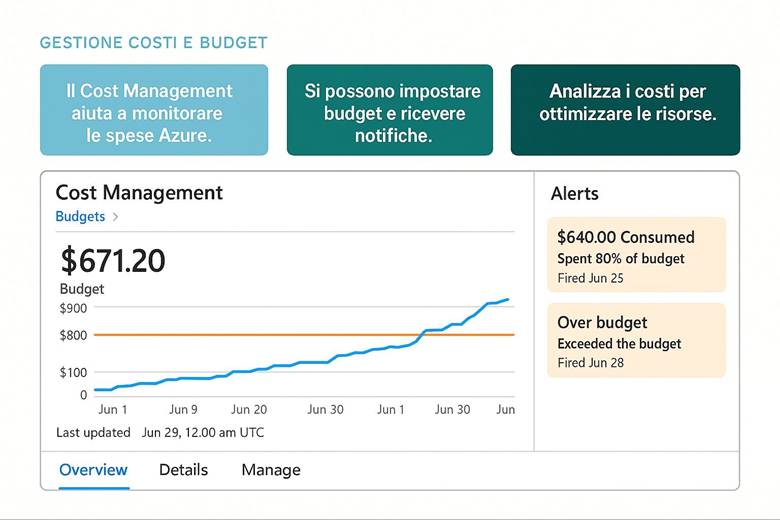

8. Gestione dei costi e Budgeting nel cloud Azure

9. Azure Marketplace – Soluzioni pronte dei partner

CAPITOLO 2 – I principali servizi

Inquadramento argomenti del capitolo con slides illustrate

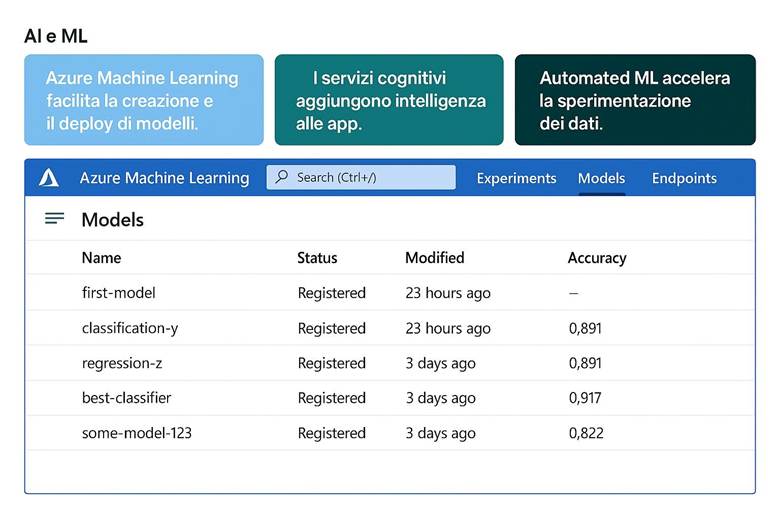

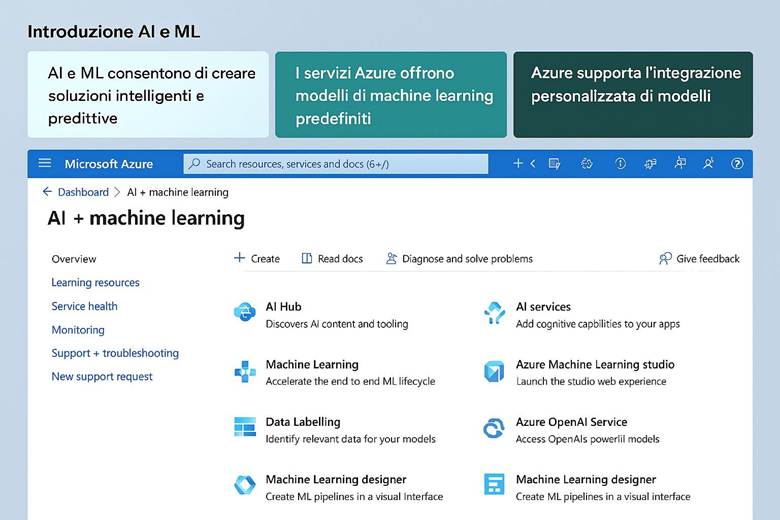

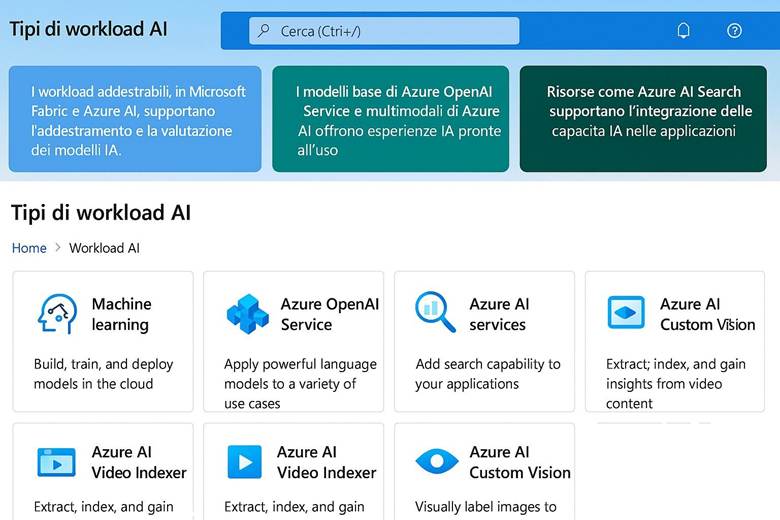

5. Intelligenza Artificiale e Machine Learning

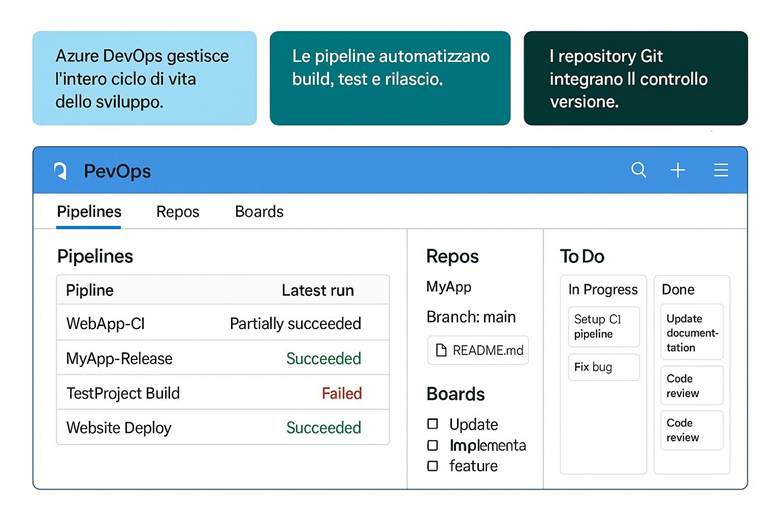

6. DevOps e Application Lifecycle

9. Analisi dei Dati (Analytics e Big Data)

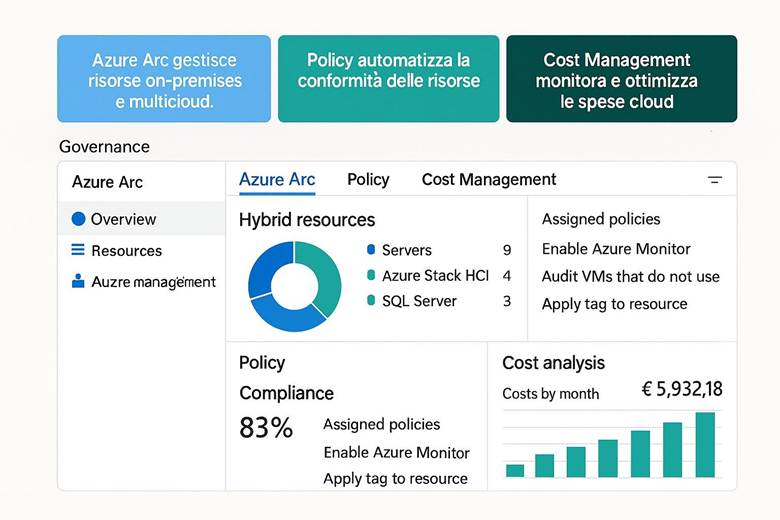

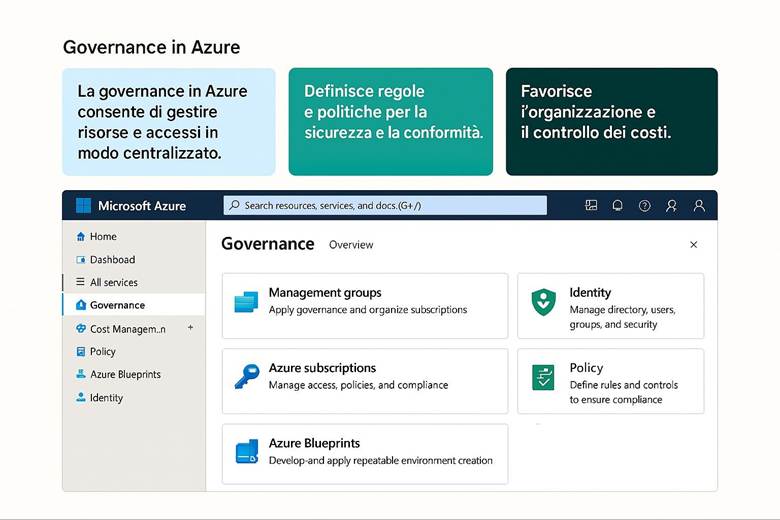

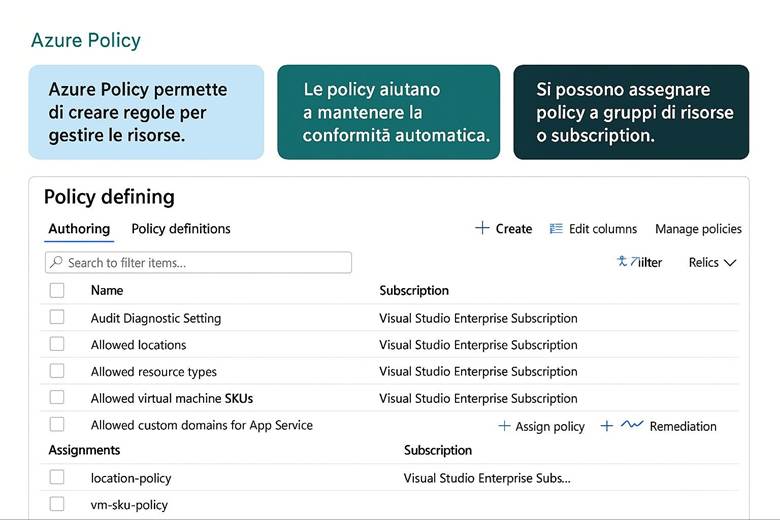

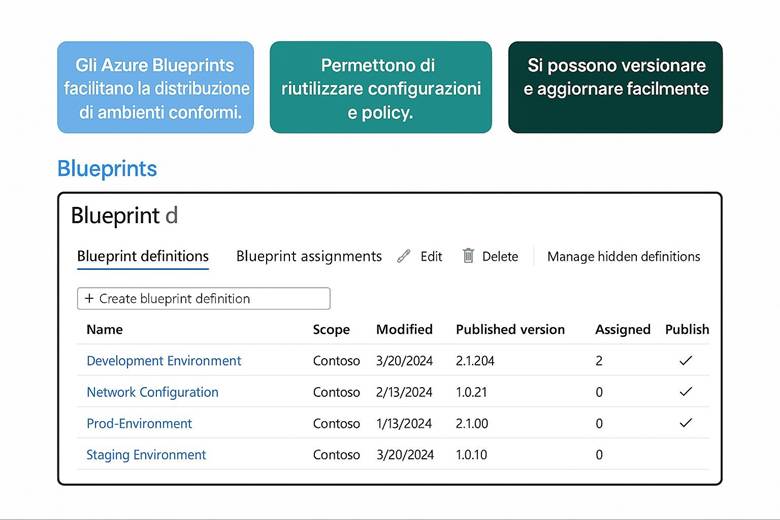

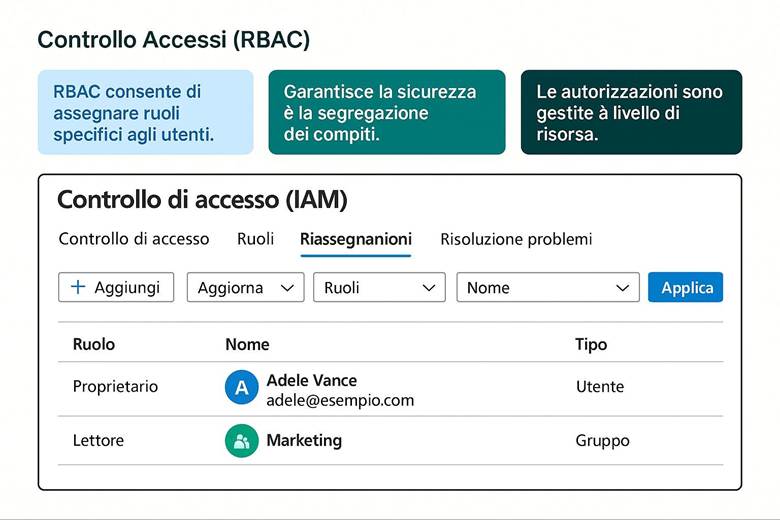

10. Governance e Gestione Cloud

CAPITOLO 3 – Il servizio di calcolo

Inquadramento argomenti del capitolo con slides illustrate

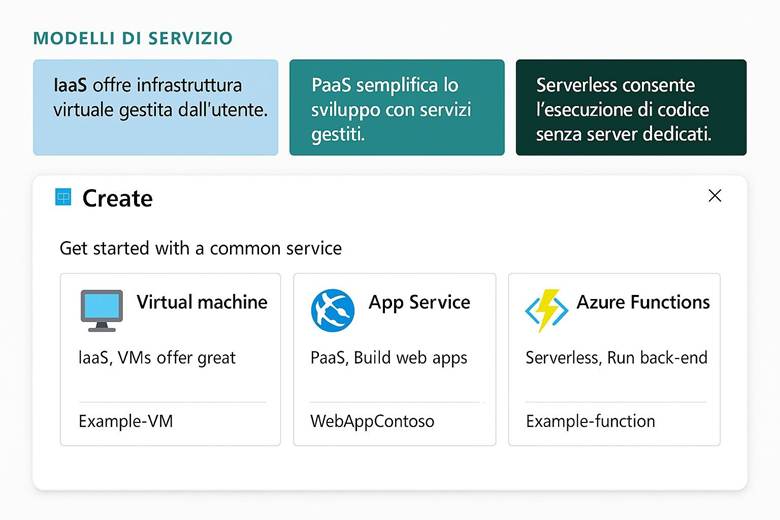

1. Modelli di servizio: IaaS, PaaS e Serverless

2. Azure Virtual Machines (IaaS) – Controllo e flessibilità

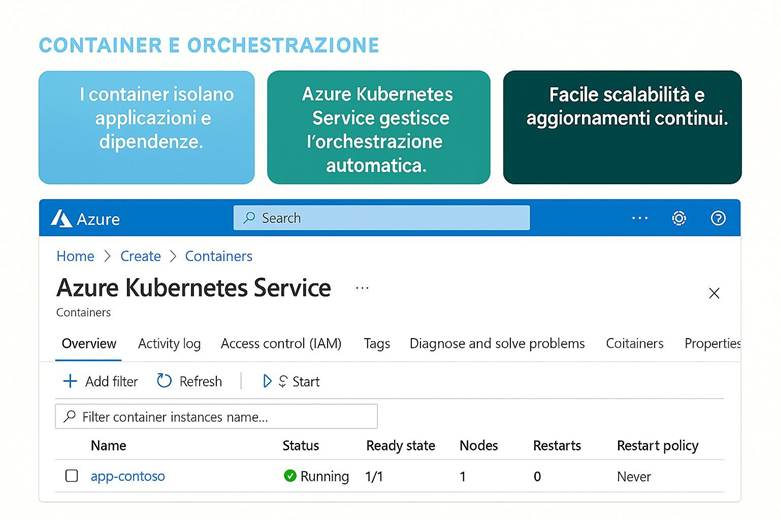

3. Container e orchestrazione con Azure Kubernetes Service (AKS)

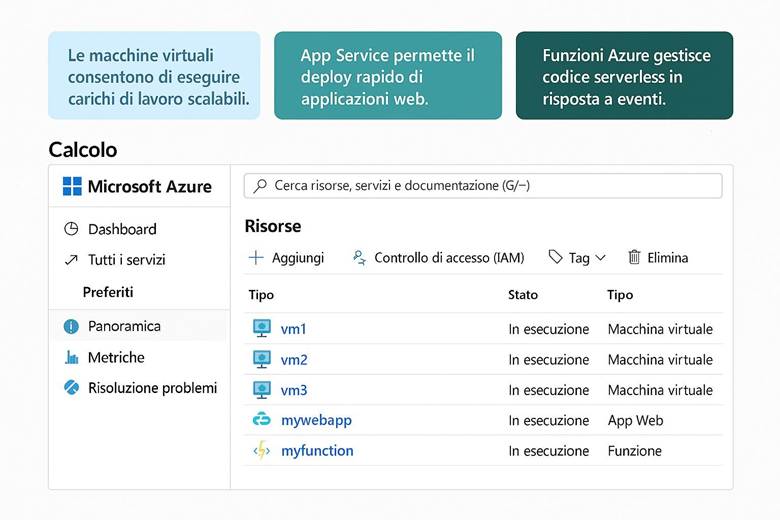

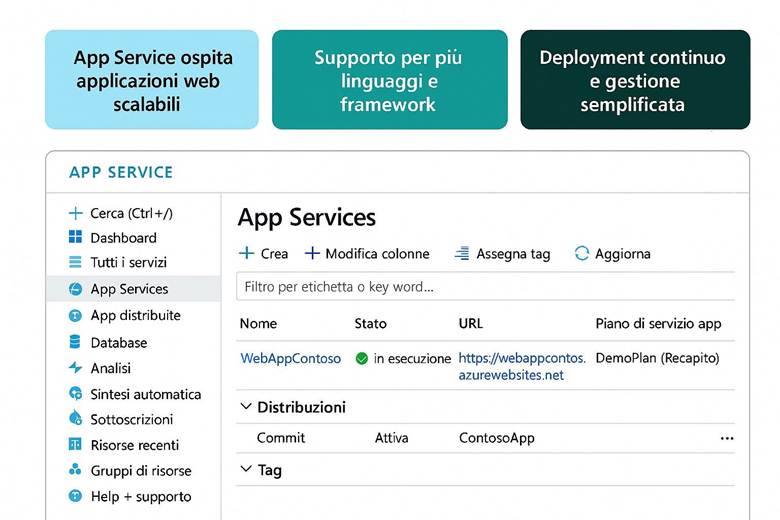

4. Azure App Service – Ospitare applicazioni web e API (PaaS)

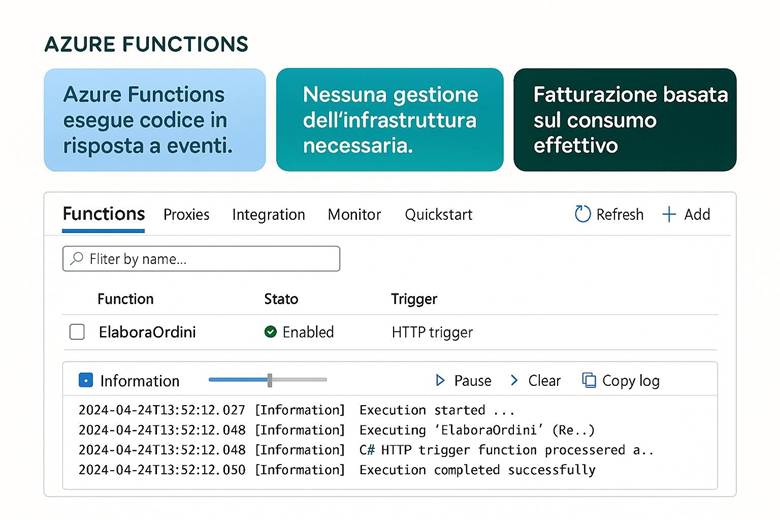

5. Azure Functions – Calcolo serverless basato su eventi

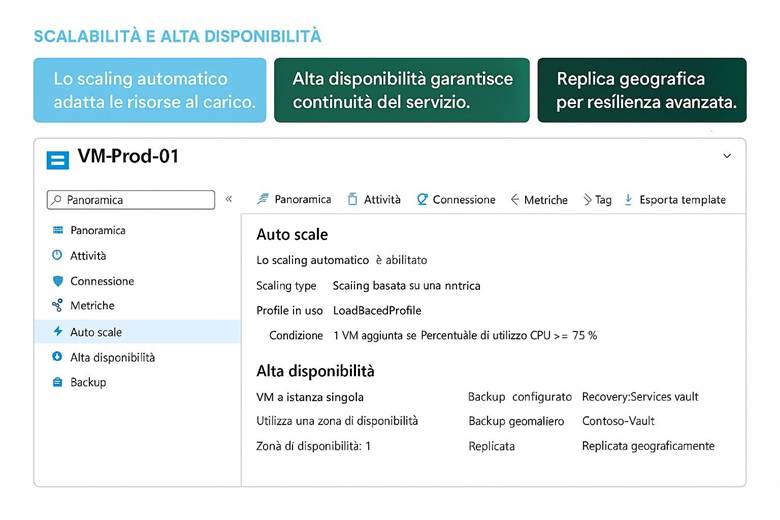

6. Scalabilità e alta disponibilità

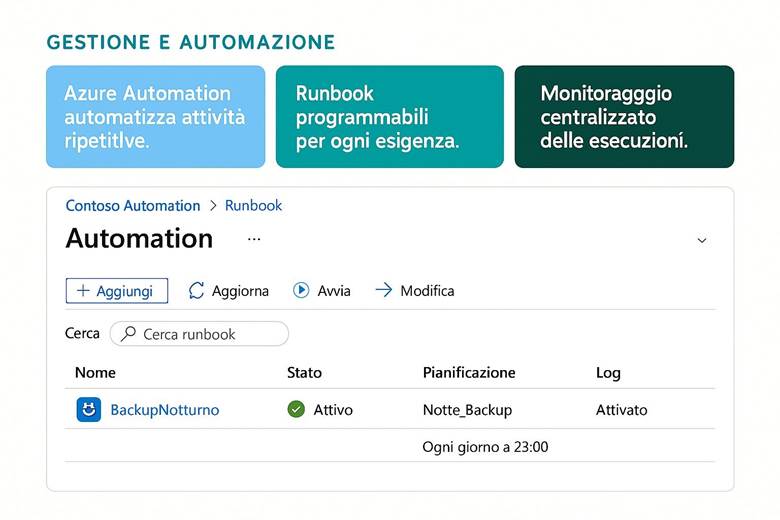

7. Gestione e automazione operativa

9. Casi d’uso e ottimizzazione dei costi

CAPITOLO 4 – Il servizio storage

Inquadramento argomenti del capitolo con slides illustrate

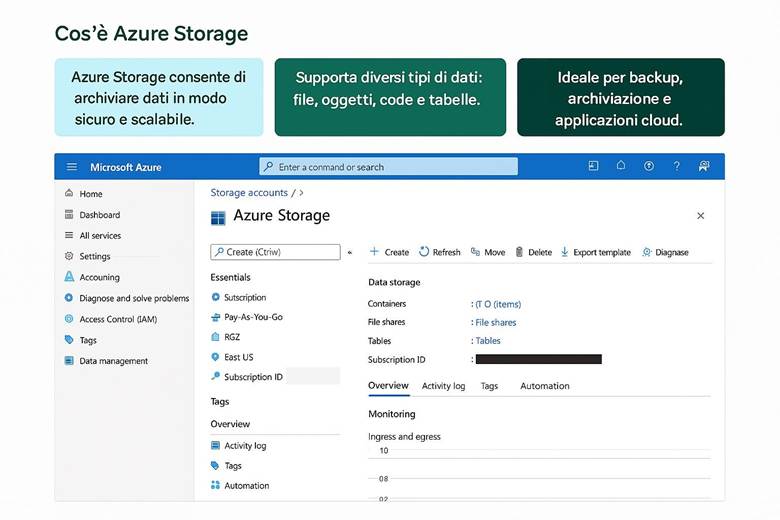

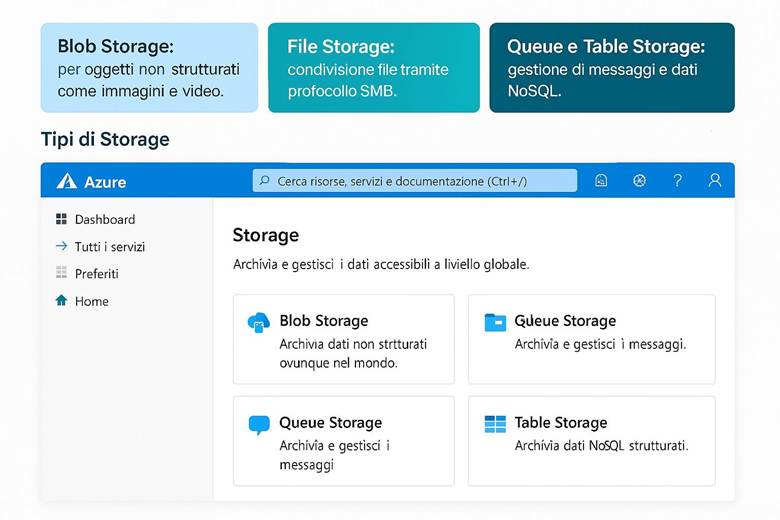

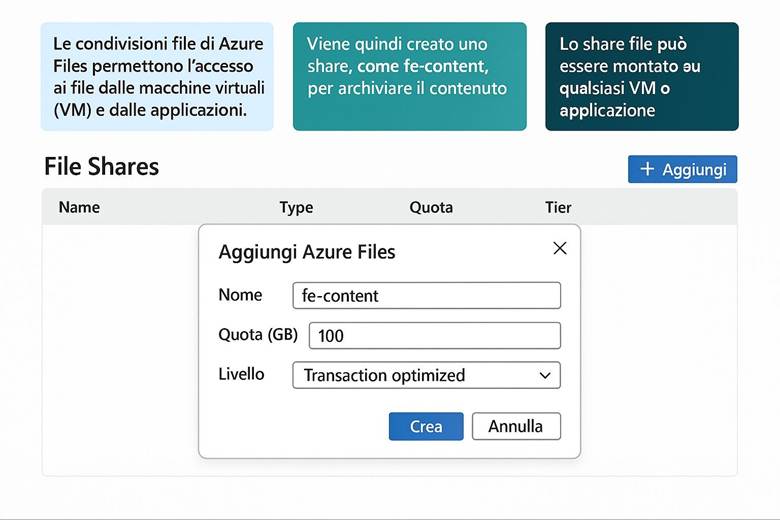

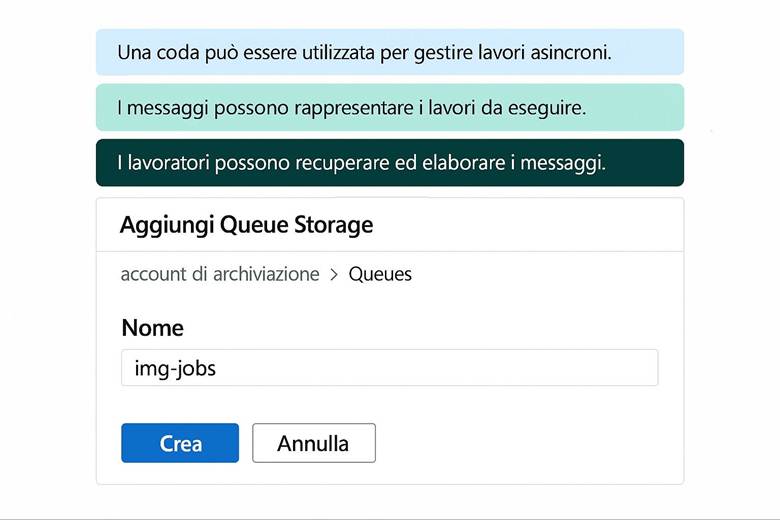

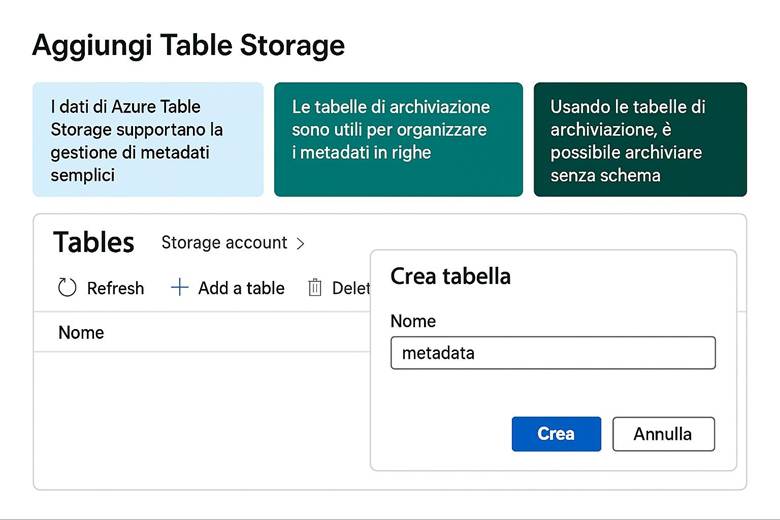

1. Servizi di archiviazione: Blob, File, Code e Tabelle

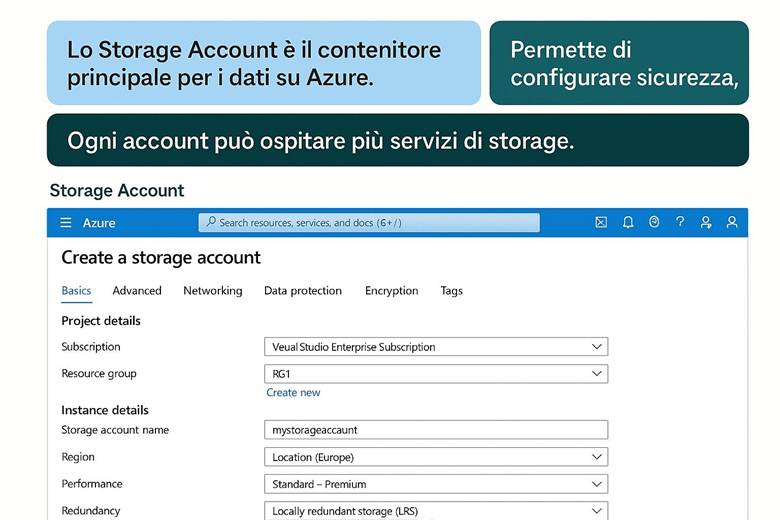

2. Account di archiviazione e configurazione di base

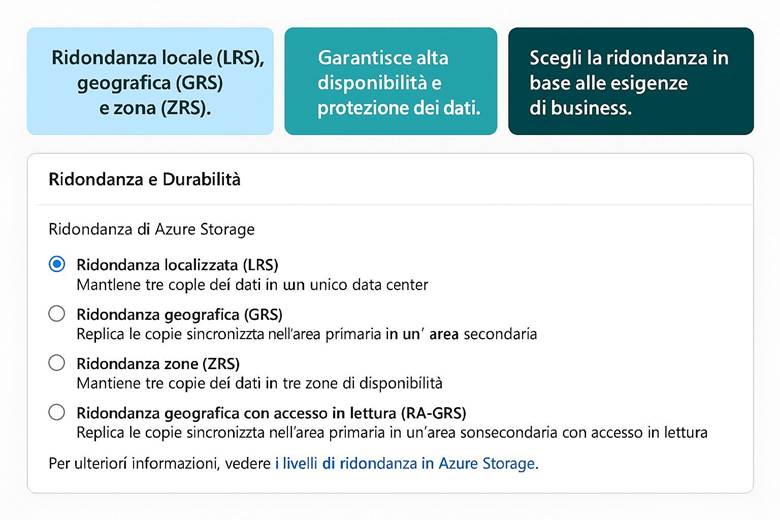

3. Opzioni di ridondanza dei dati

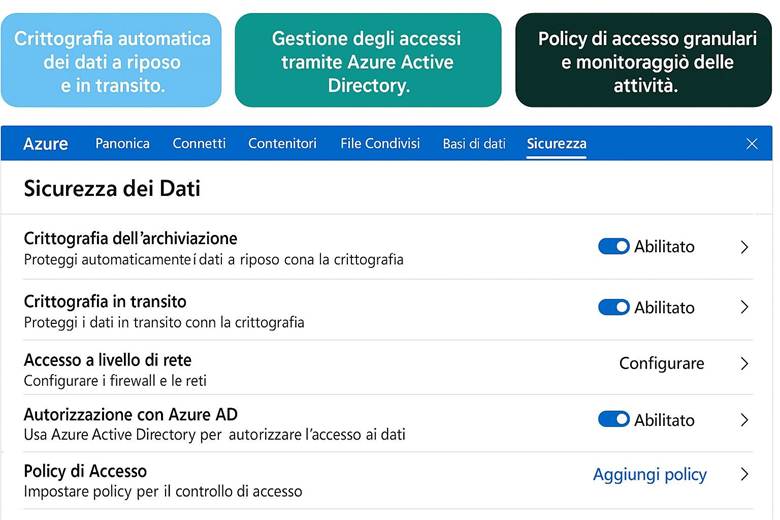

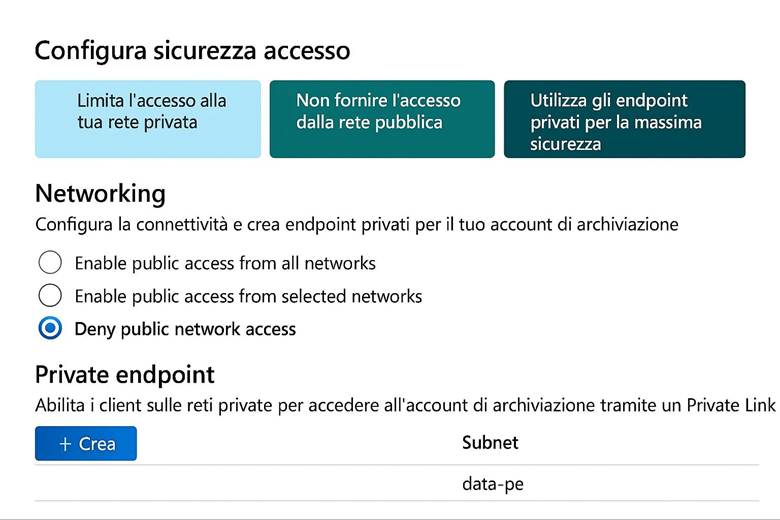

4. Sicurezza e controllo dell’accesso

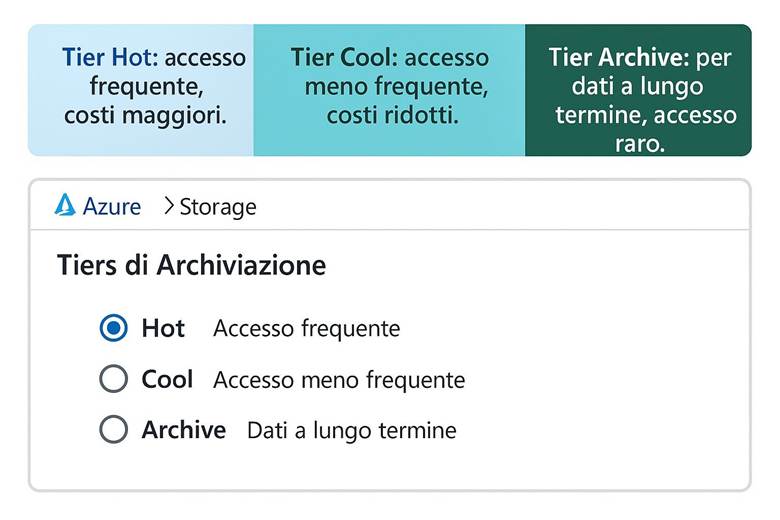

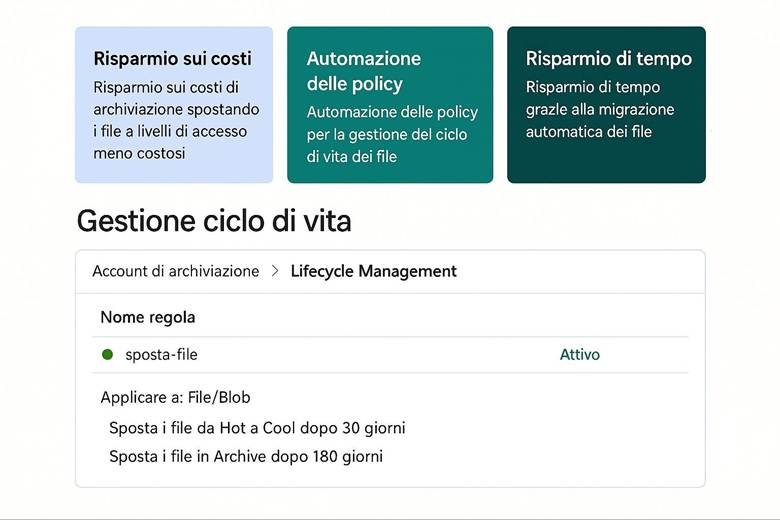

5. Tier di archiviazione: Hot, Cool, Archive

6. Strumenti per la gestione di Azure Storage

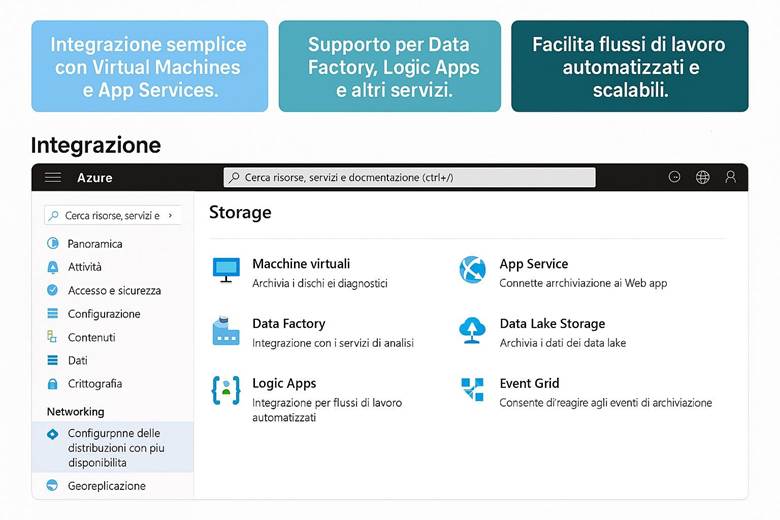

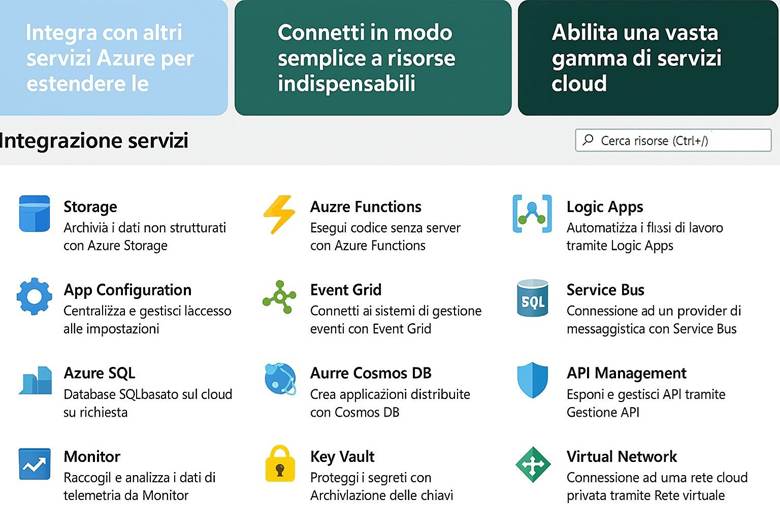

7. Integrazione con altri servizi Azure

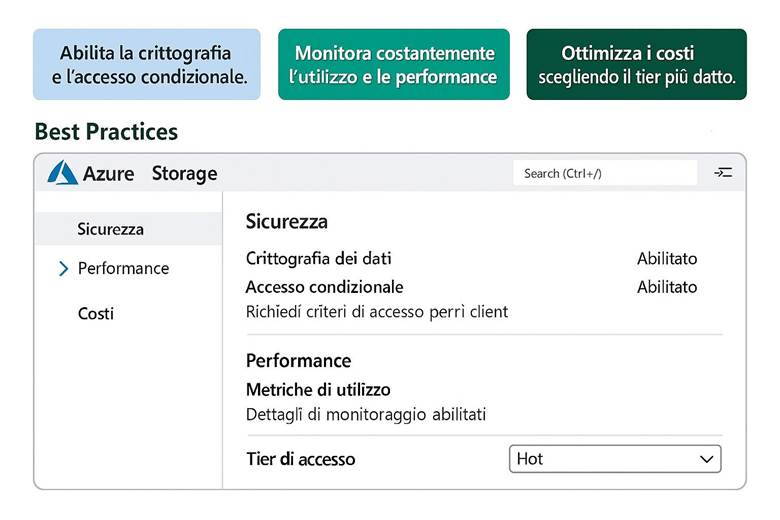

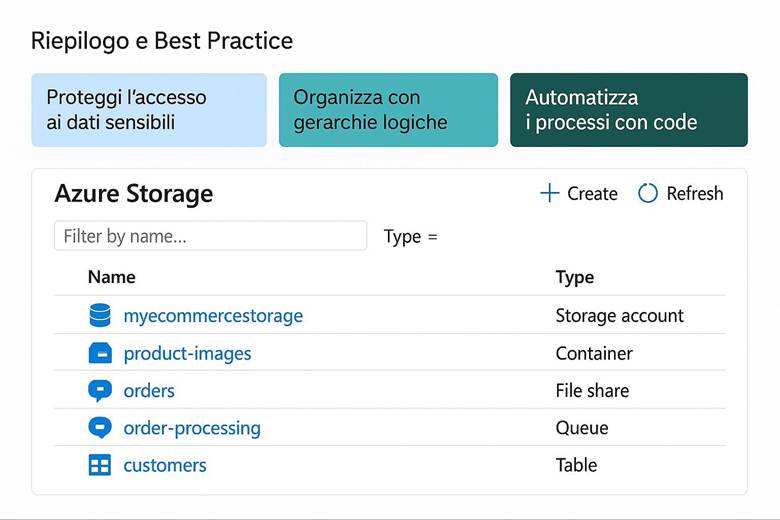

8. Best practice per l’utilizzo di Azure Storage

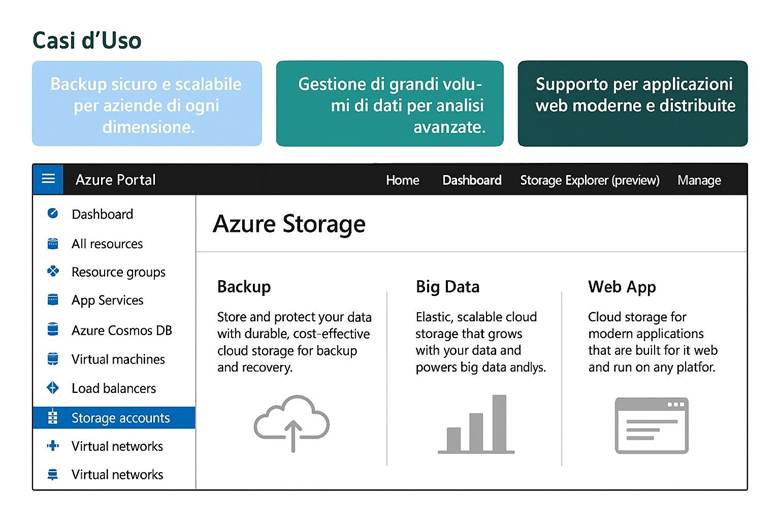

9. Casi d’uso e scenari pratici

CAPITOLO 5 – Il servizio networking

Inquadramento argomenti del capitolo con slides illustrate

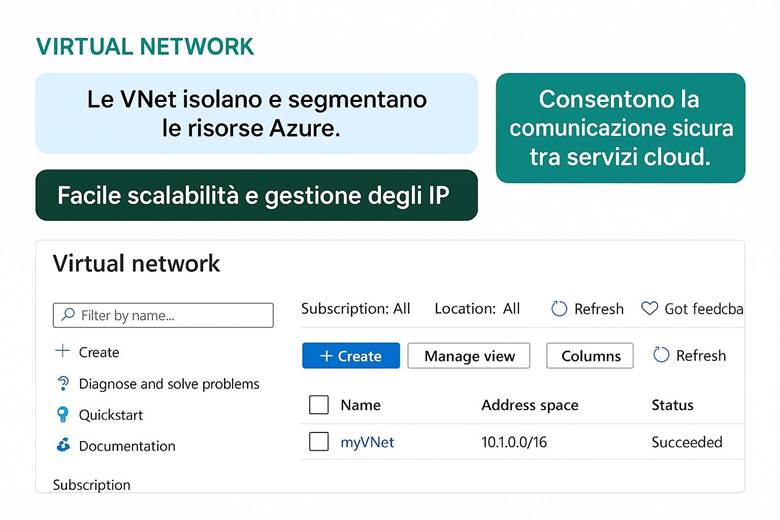

1. Reti Virtuali (Azure Virtual Network - VNet)

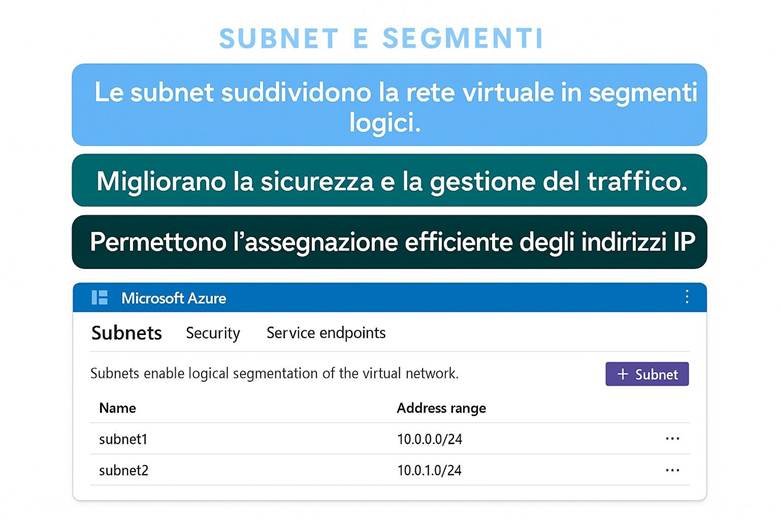

2. Subnet (Segmentazione Logica della Rete)

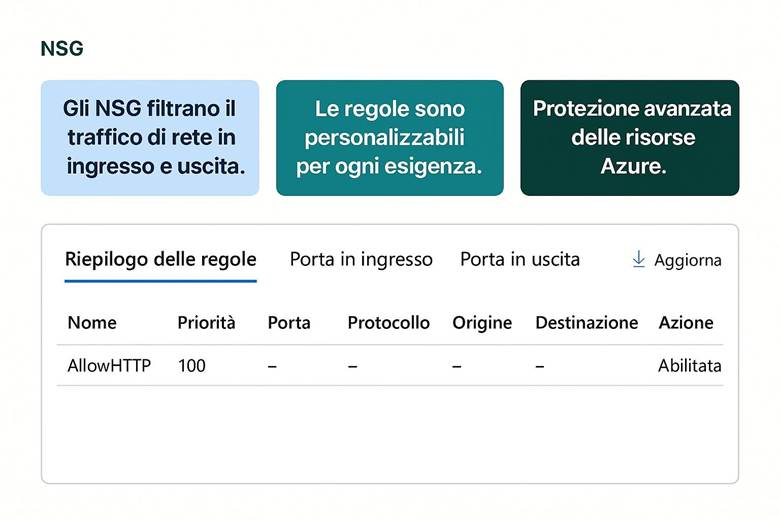

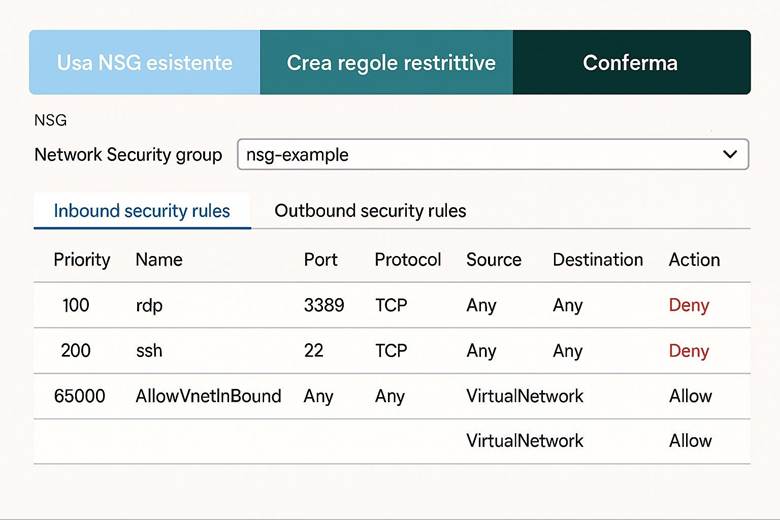

3. Gruppi di Sicurezza di Rete (Network Security Groups - NSG)

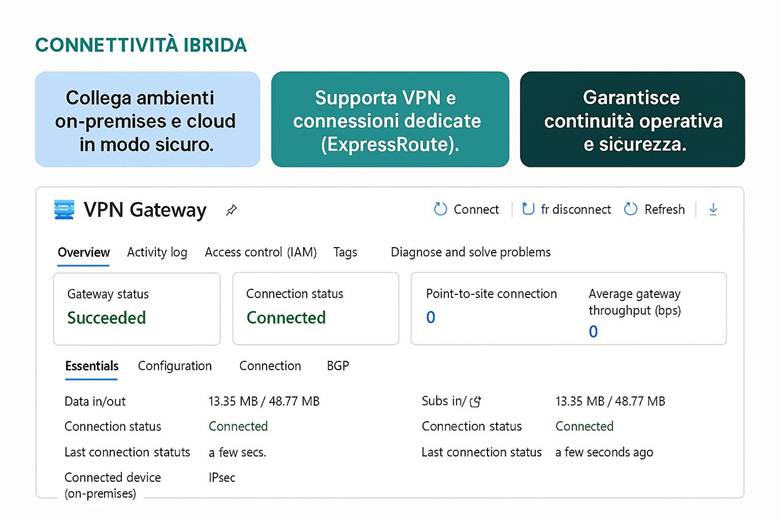

4. Connettività Ibrida (VPN Gateway ed ExpressRoute)

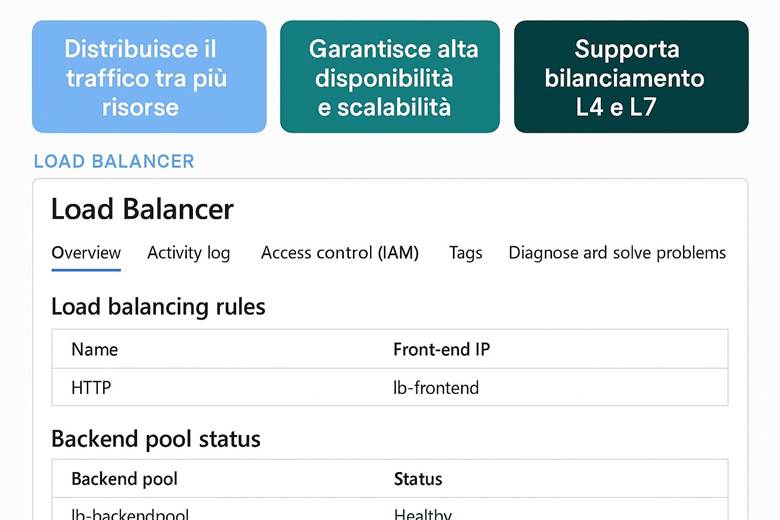

5. Bilanciamento del Carico (Load Balancer, Application Gateway, Front Door)

6. Sicurezza Avanzata in Rete (Azure Firewall, Protezione DDoS, Defender for Cloud)

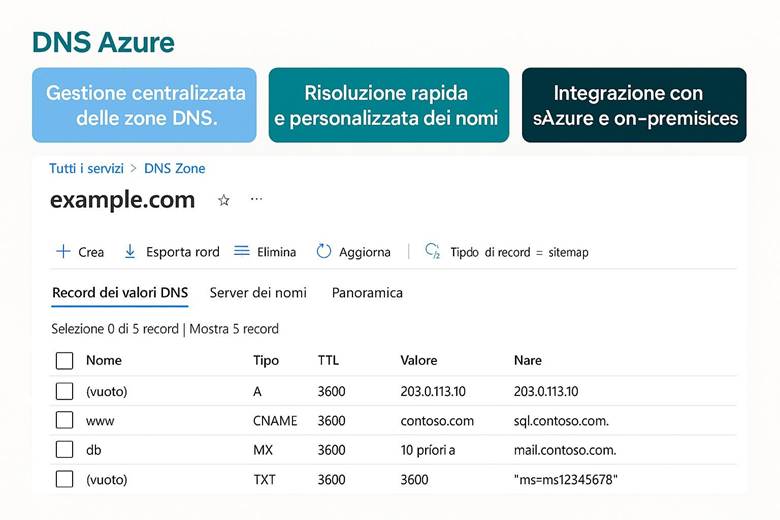

7. Gestione dei Nomi (Azure DNS)

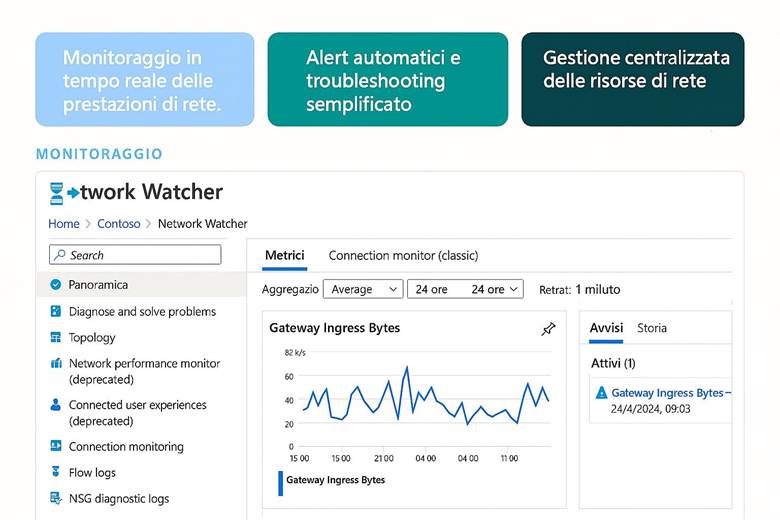

8. Monitoraggio e Risoluzione dei Problemi (Network Watcher)

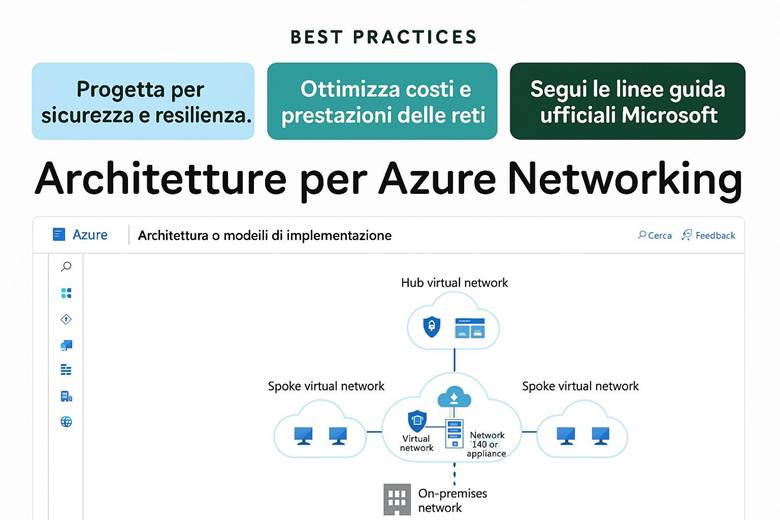

9. Best practice Architetturali per Azure Networking

10 . Tabella riassuntiva dei servizi di Azure Networking

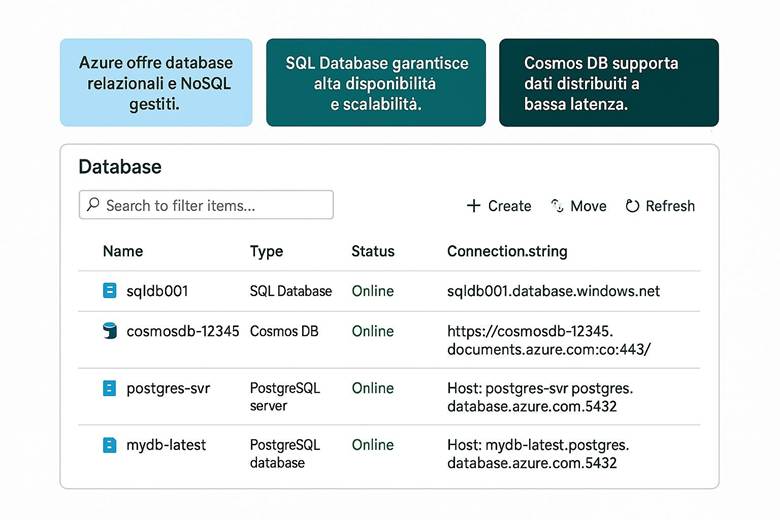

CAPITOLO 6 – Il servizio database

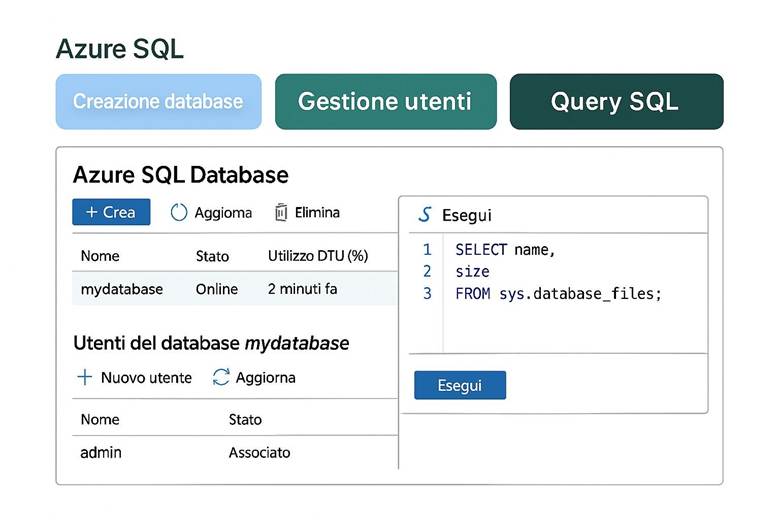

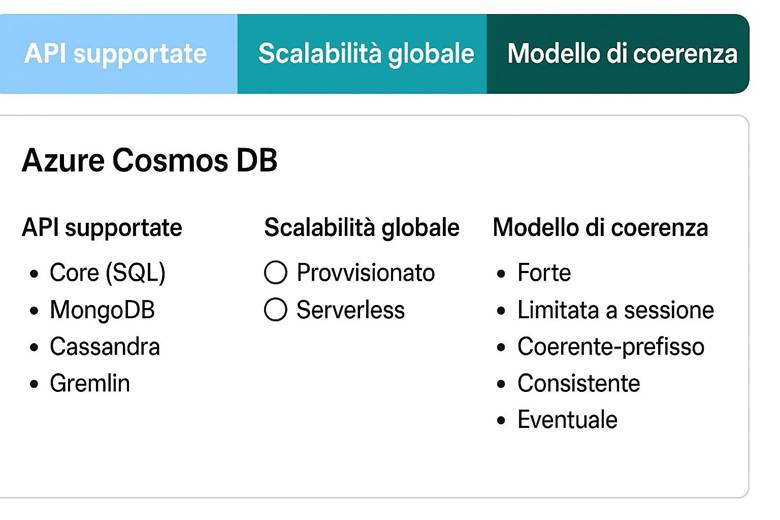

Inquadramento argomenti del capitolo con slides illustrate

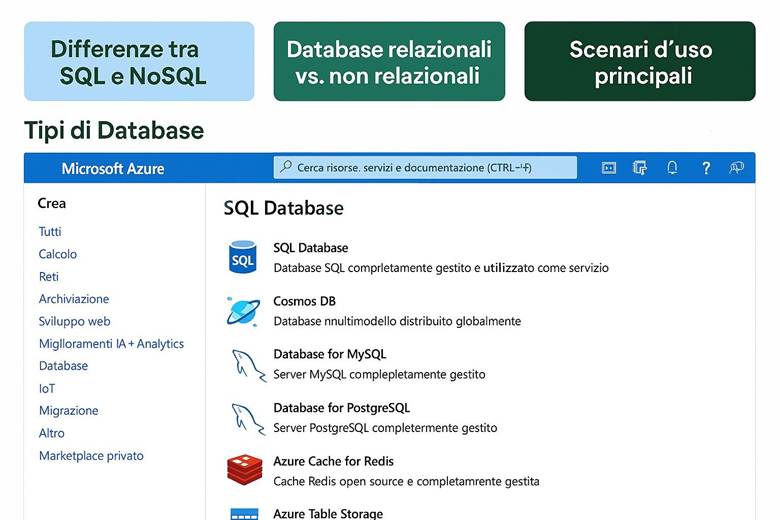

1. Tipi di Database – SQL Relazionali vs NoSQL

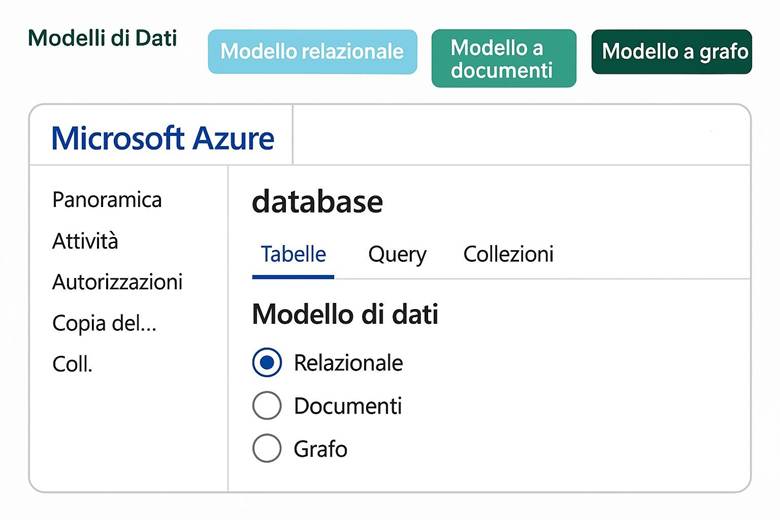

2. Modelli di Dati – Relazionale, Documenti e Grafo

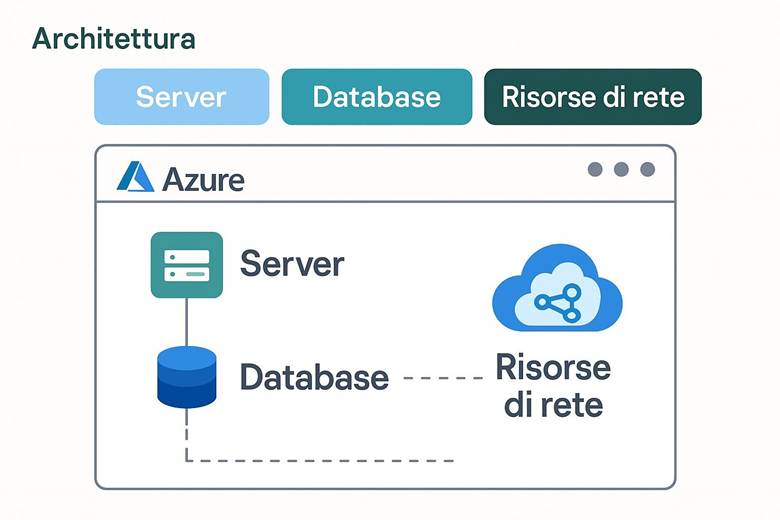

3. Architettura dei Servizi Database in Azure

4. Sicurezza nei Database in Azure

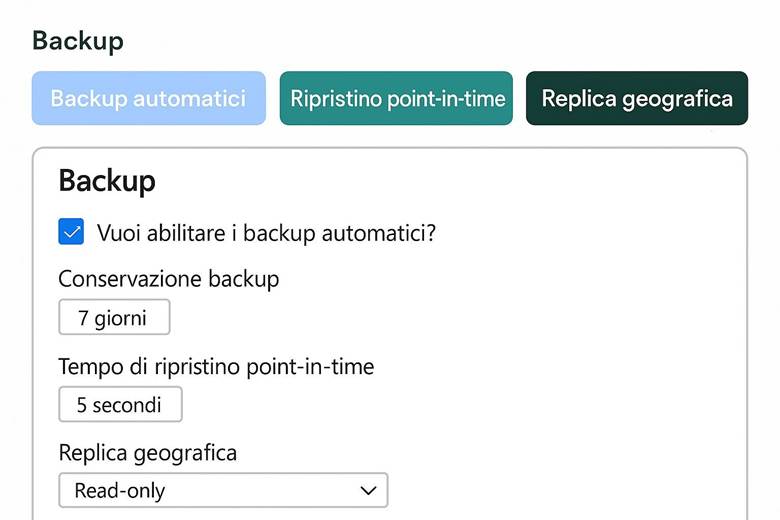

5. Backup e Ripristino (Disaster Recovery)

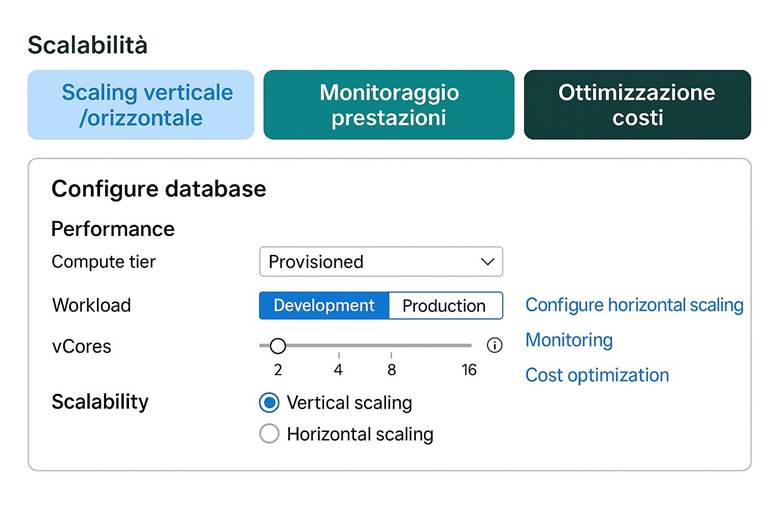

6. Scalabilità e Monitoraggio delle Prestazioni

7. Integrazione con Altri Servizi Azure

8. Casi d’Uso – Scenari Applicativi

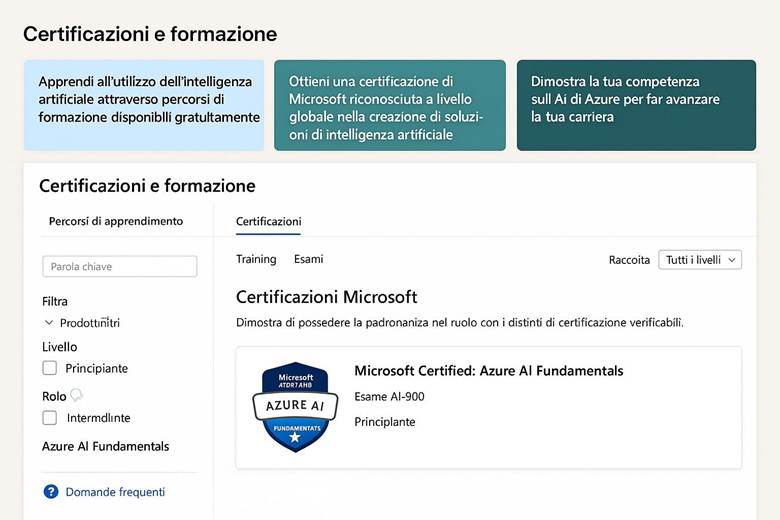

CAPITOLO 7 – Il servizio di intelligenza artificiale e di machine learning

Inquadramento argomenti del capitolo con slides illustrate

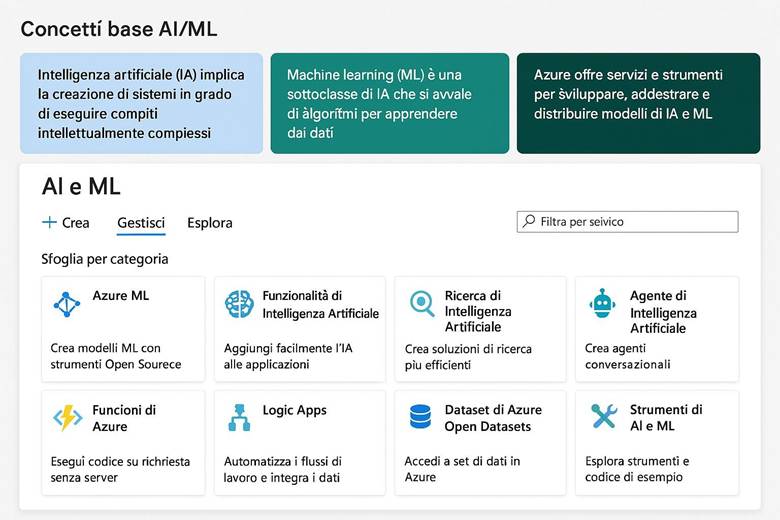

1. Concetti di IA e Machine Learning

2. Tipi di Apprendimento Automatico

3. Architettura del Ciclo di Vita del ML

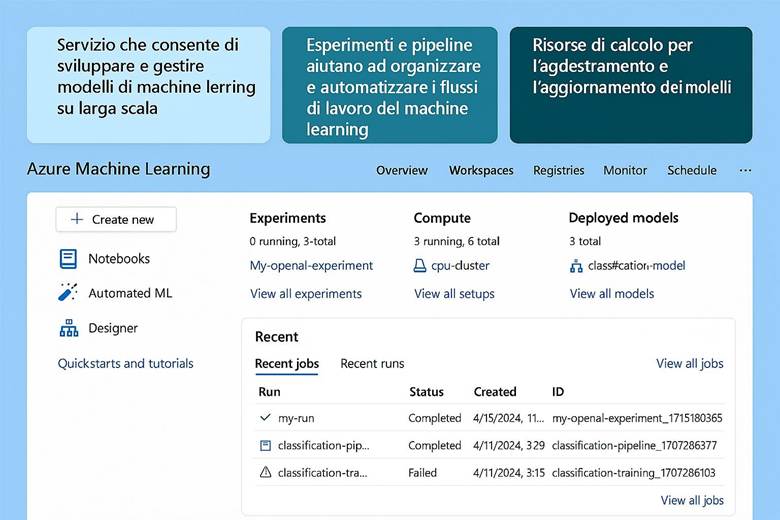

4. Azure Machine Learning: Piattaforma per il Ciclo ML

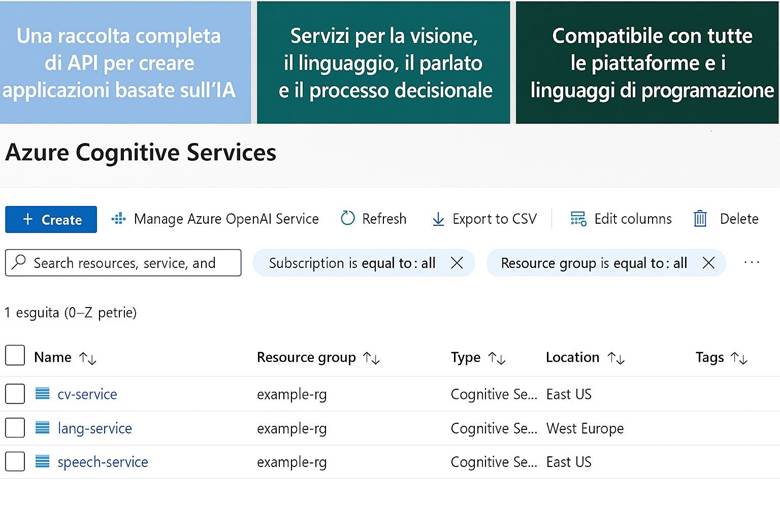

5. Servizi Cognitivi di Azure (Azure AI Services)

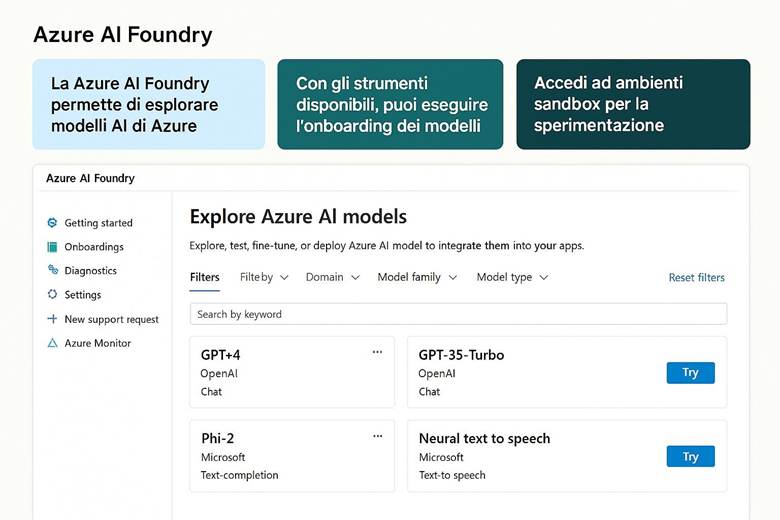

6. Azure OpenAI e Microsoft Foundry: Soluzioni di Generative AI

7. Integrazione delle Soluzioni AI con i Servizi Azure

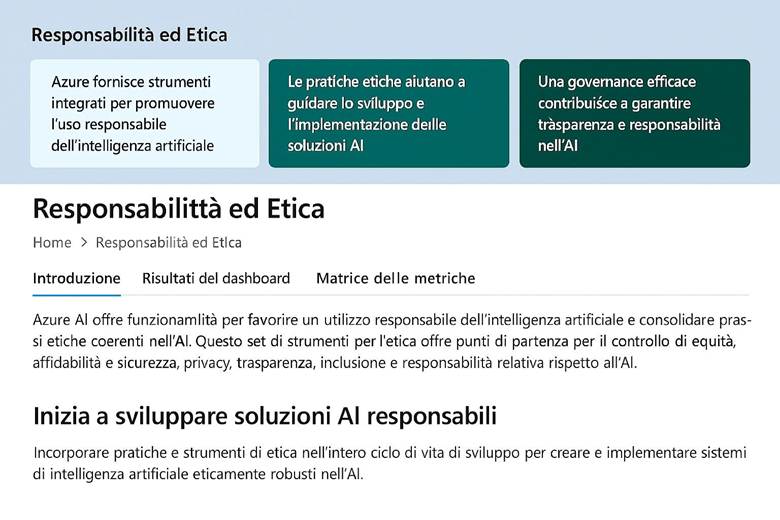

8. Intelligenza Artificiale Responsabile (Responsible AI)

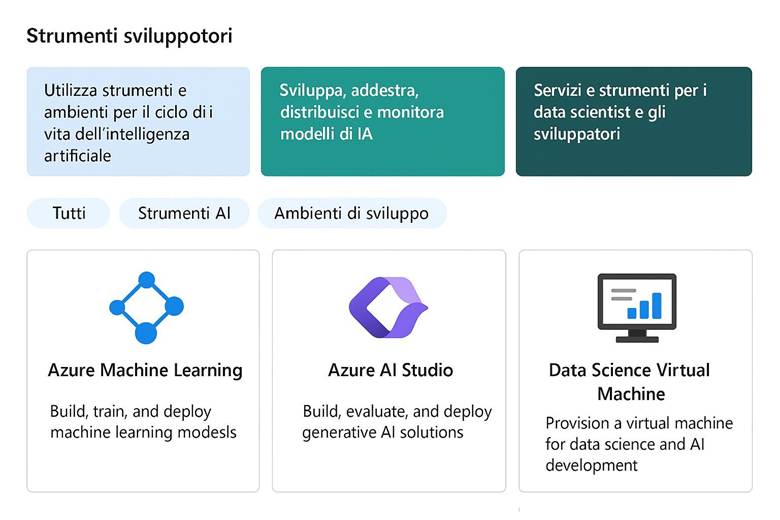

9. Strumenti e Ambienti per Sviluppatori

CAPITOLO 8 – Il servizio DevOps

Inquadramento argomenti del capitolo con slides illustrate

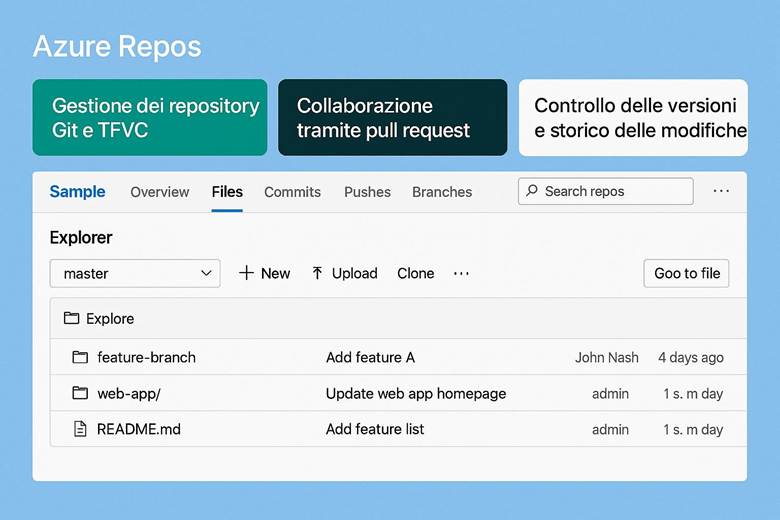

1. Azure Repos: Controllo di Versione e Collaborazione

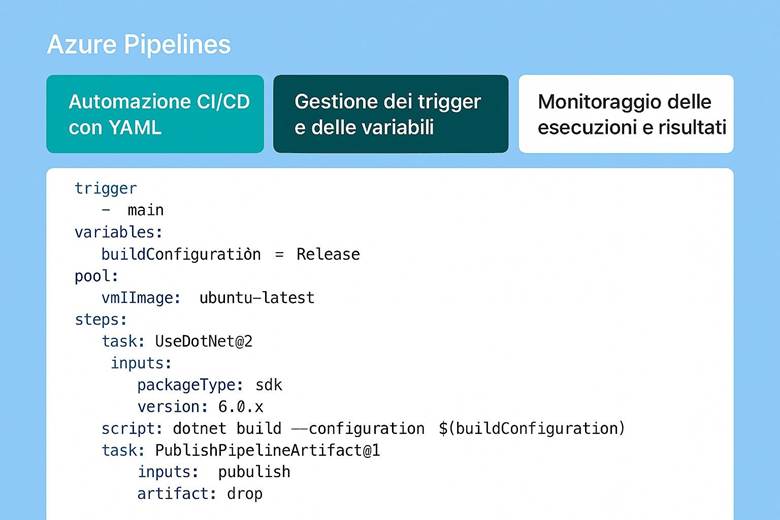

2. Azure Pipelines: Continuous Integration e Delivery Automatizzata

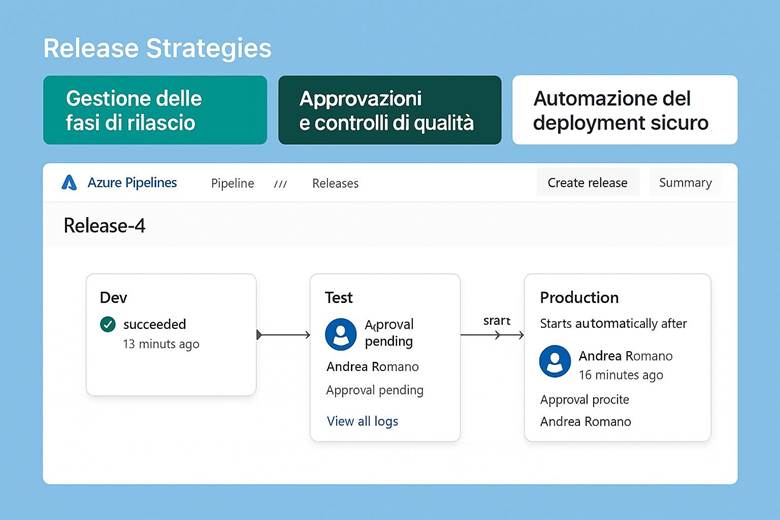

3. Strategie di Rilascio, Approvazioni e Controlli di Qualità

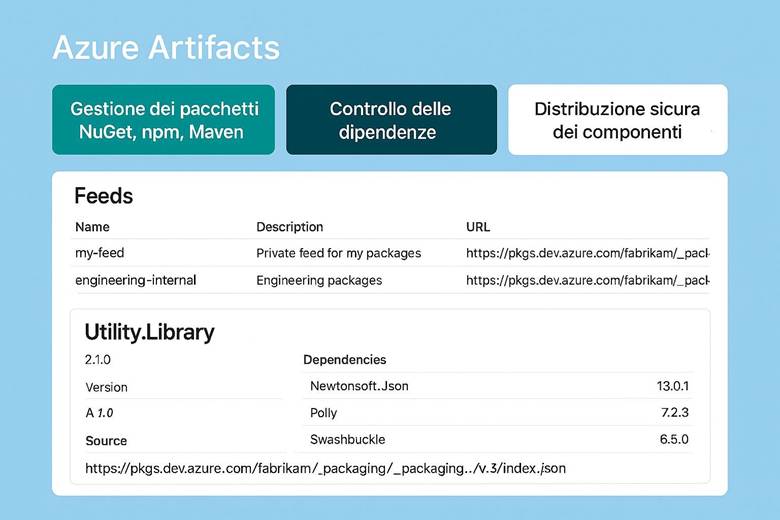

4. Azure Artifacts: Gestione di Pacchetti e Dipendenze

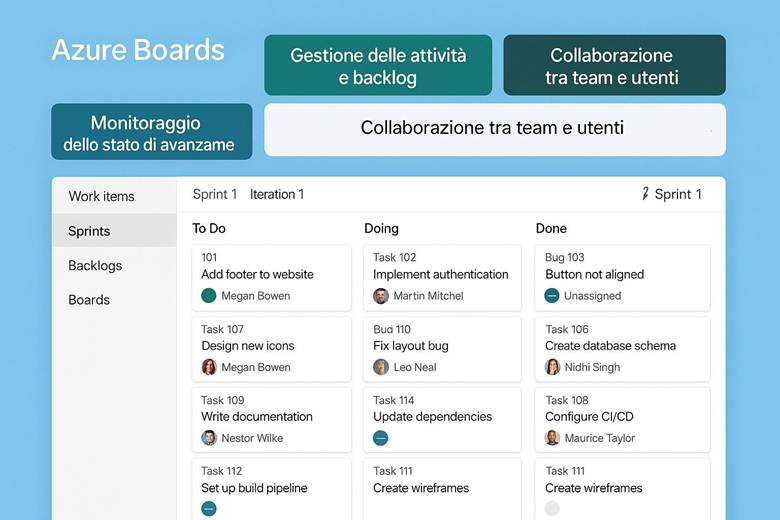

5. Azure Boards: Gestione del Lavoro e Collaborazione Agile

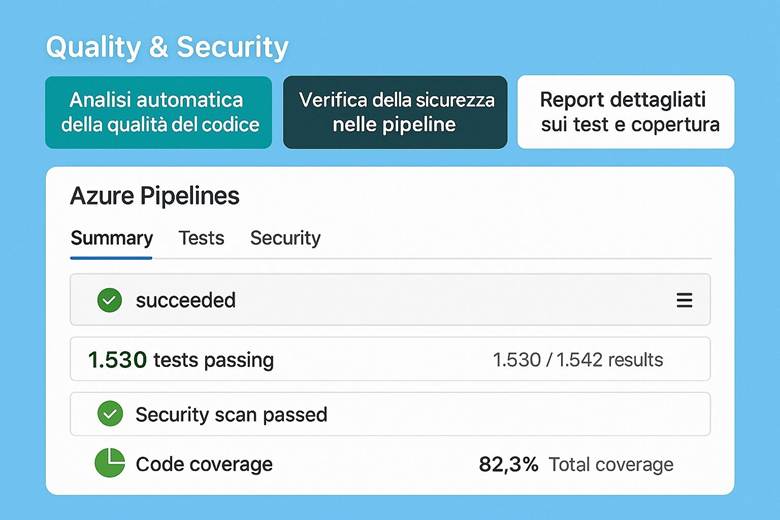

6. Qualità del Codice e Sicurezza nelle Pipeline

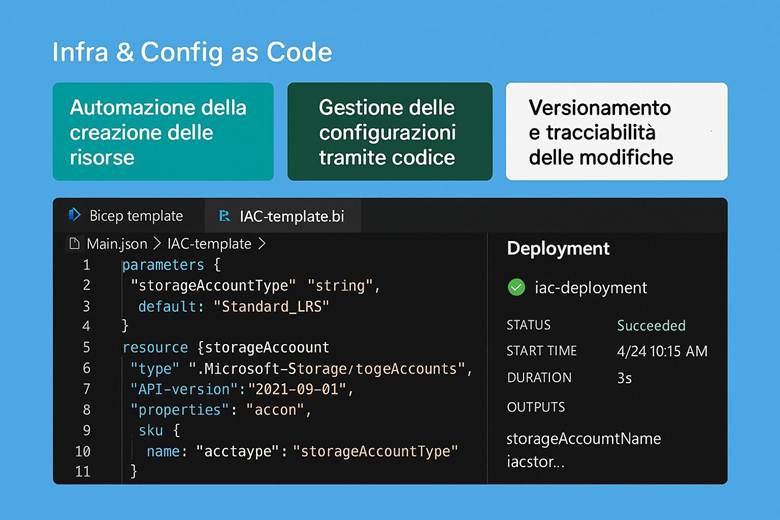

7. Infrastructure as Code (IaC) e Configuration as Code (CaC)

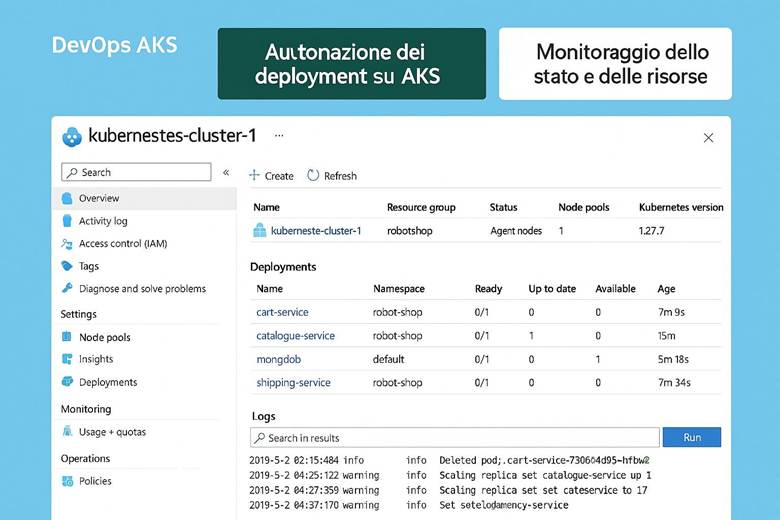

8. DevOps su Azure Kubernetes Service (AKS): Deployment e Osservabilità

9. Governance e Compliance con Azure DevOps e Azure

10. Organizzazione dell’Account, Permessi e Scalabilità dei Progetti

11. Tabella Riepilogativa dei Servizi DevOps Principali

CAPITOLO 9 – Il servizio di sicurezza

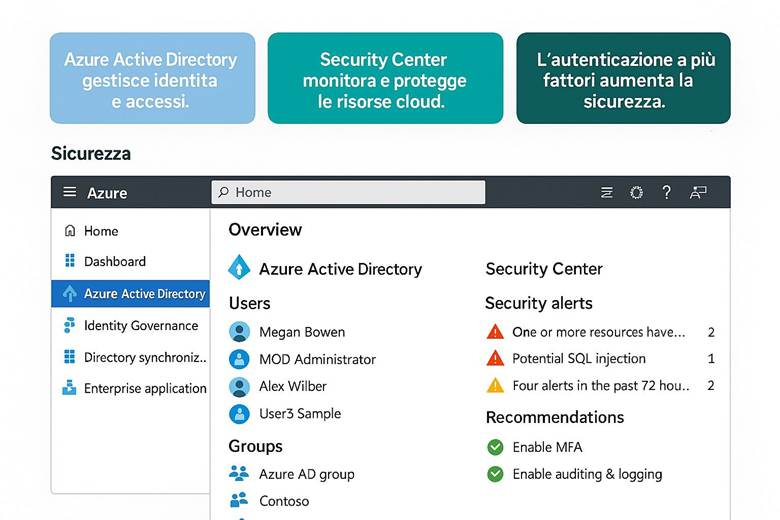

Inquadramento argomenti del capitolo con slides illustrate

1. Panoramica e Principi Operativi della Sicurezza in Azure

3. Gestione delle Identità e degli Accessi

4. Crittografia dei Dati e Gestione delle Chiavi

5. Sicurezza di Rete (Firewall, NSG e VPN)

6. Protezione delle Risorse e Backup

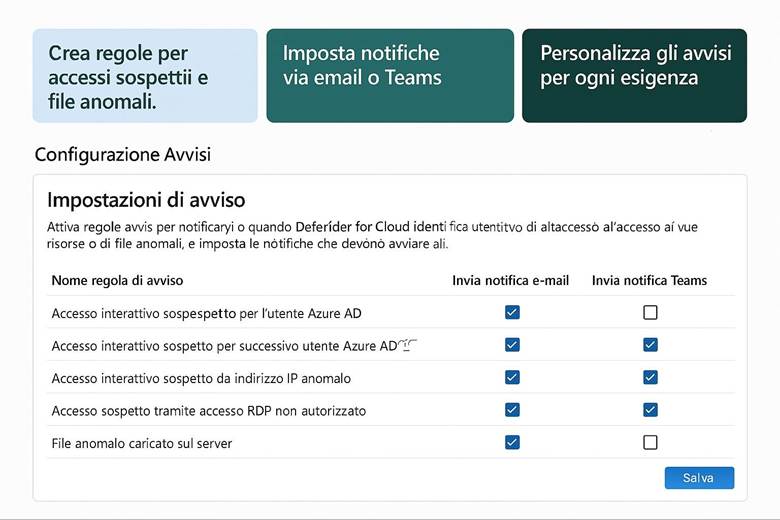

7. Monitoraggio e Risposta agli Incidenti

8. Sicurezza delle Applicazioni

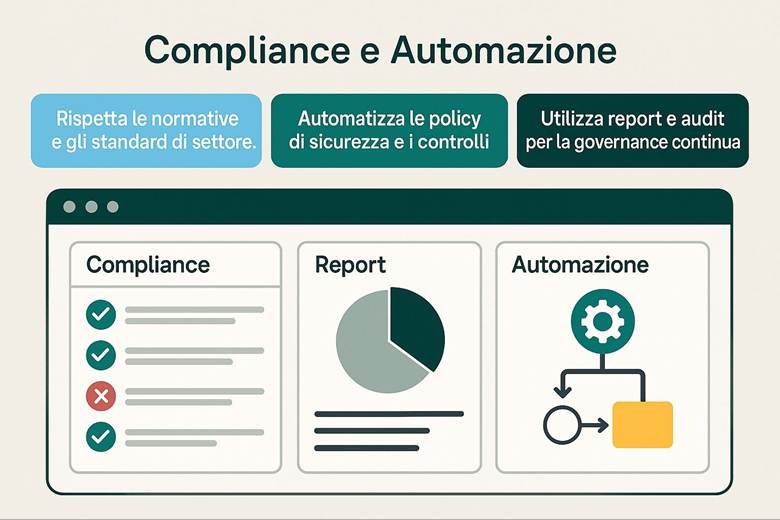

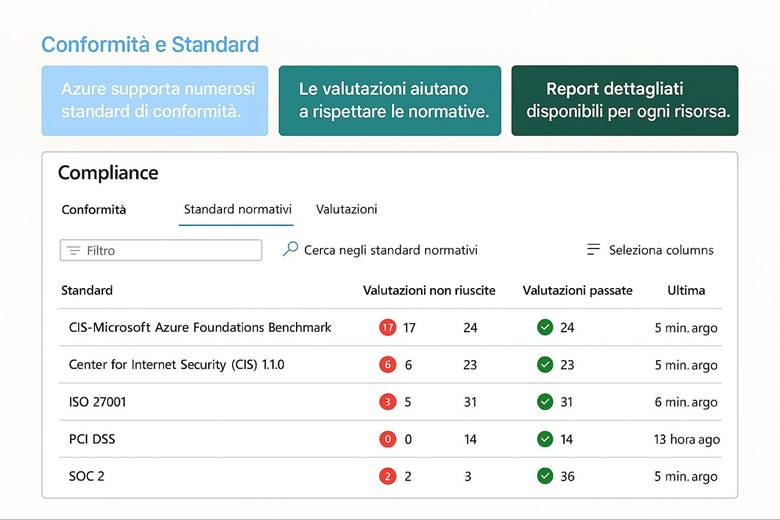

9. Conformità e Automazione della Sicurezza

CAPITOLO 10 – Il servizio di automazione

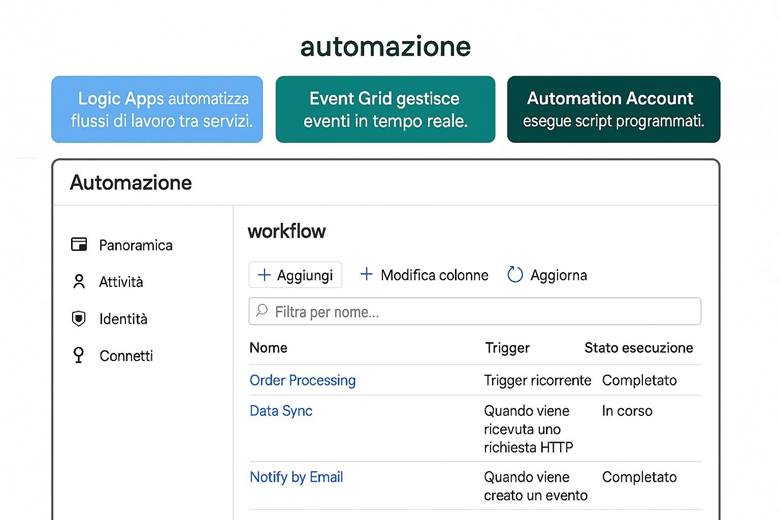

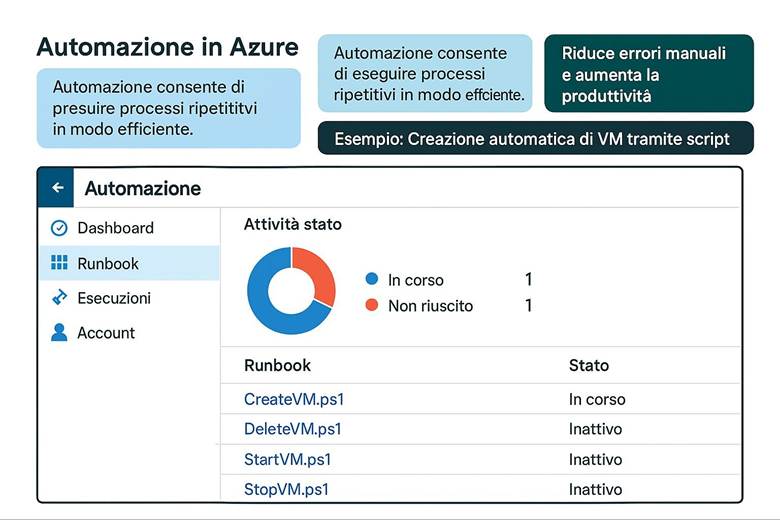

Inquadramento argomenti del capitolo con slides illustrate

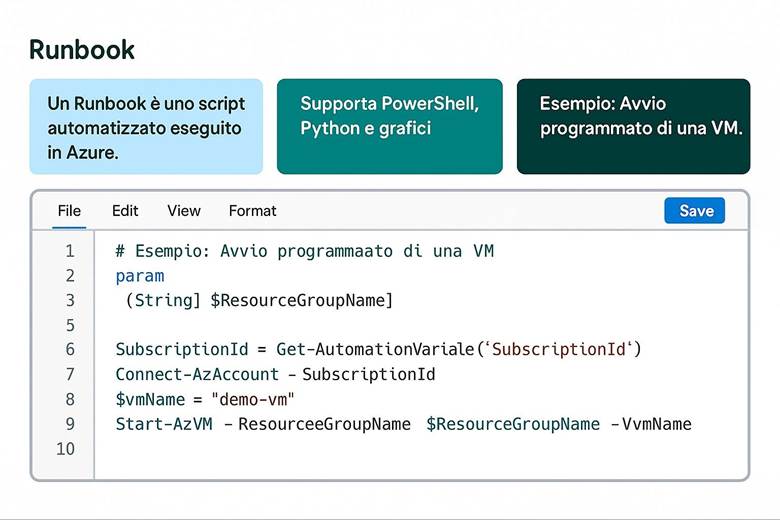

1. Runbook e Automazione delle Attività

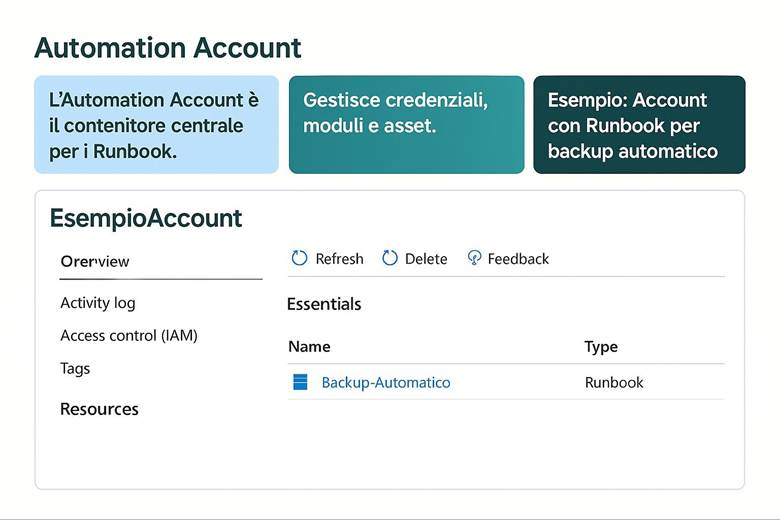

2. Automation Account: Il Contenitore Centrale

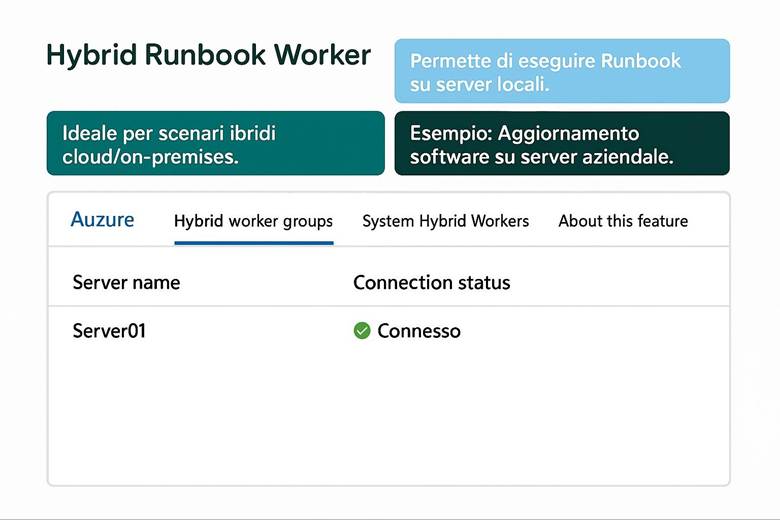

3. Hybrid Runbook Worker: Automazione Ibrida

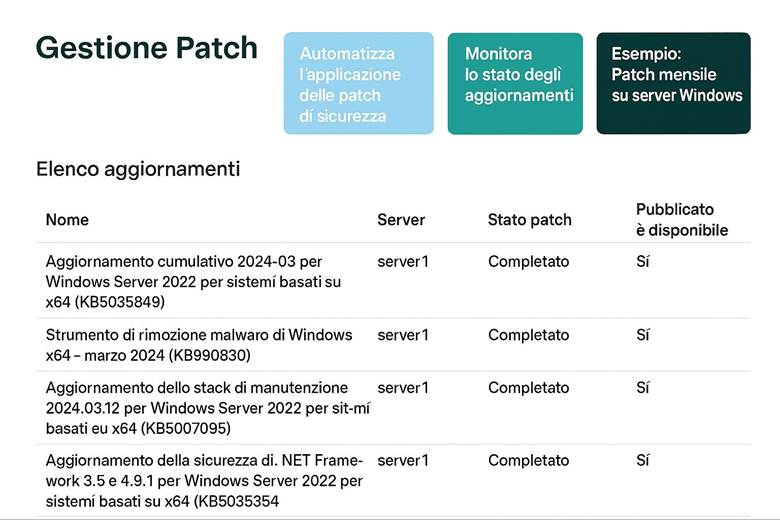

4. Update Management: Gestione degli Aggiornamenti delle VM

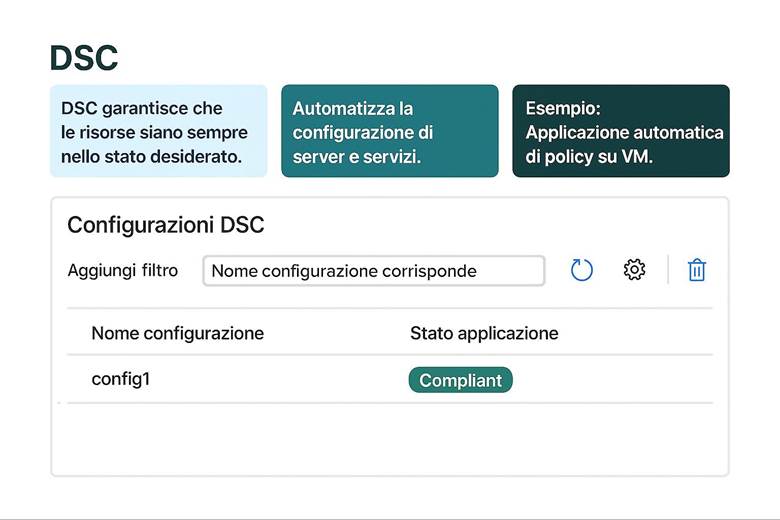

5. Configurazione dello Stato: Azure Automation State Configuration (DSC)

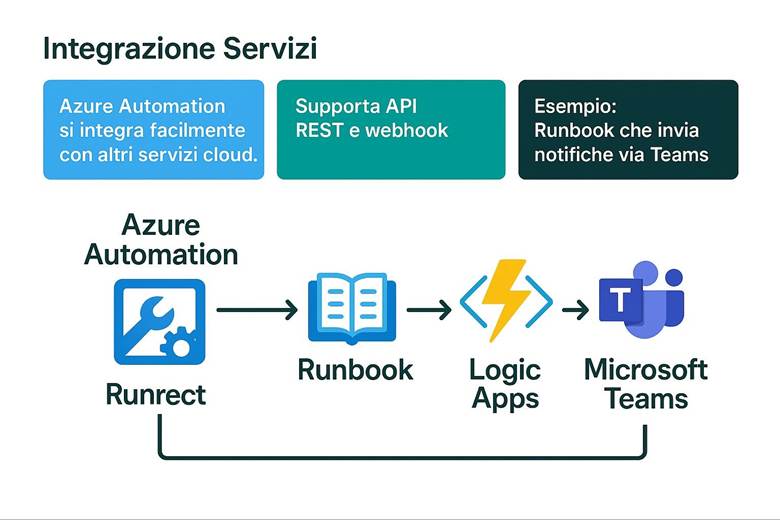

6. Integrazione Runbook con altri Servizi

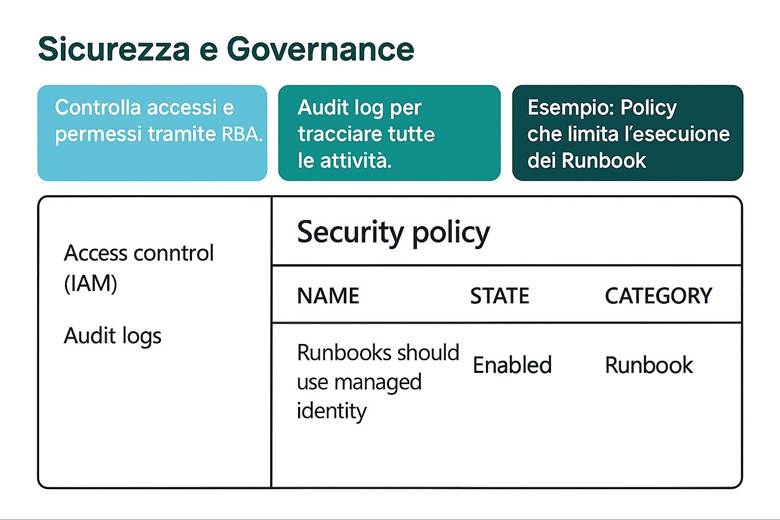

7. Baseline di Sicurezza e Governance per l’Automazione

8. Ottimizzazione dei Costi con l’Automazione

9. Migliori Pratiche per Azure Automation e Considerazioni Finali

CAPITOLO 11 – Il servizio di analisi

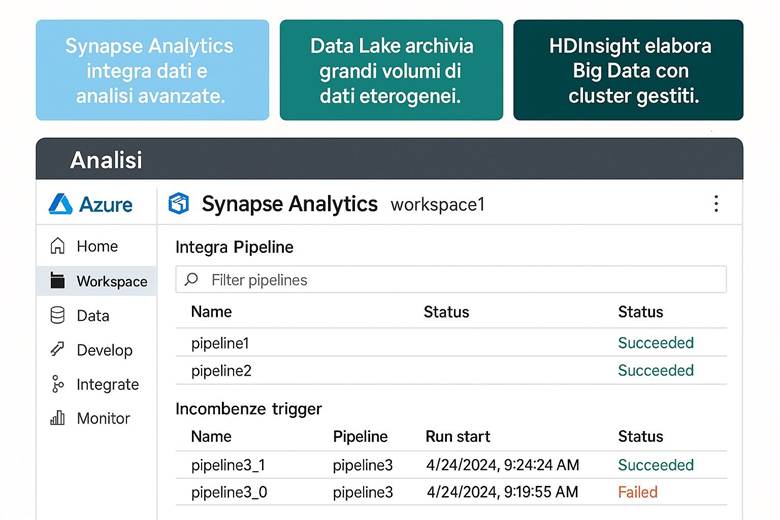

Inquadramento argomenti del capitolo con slides illustrate

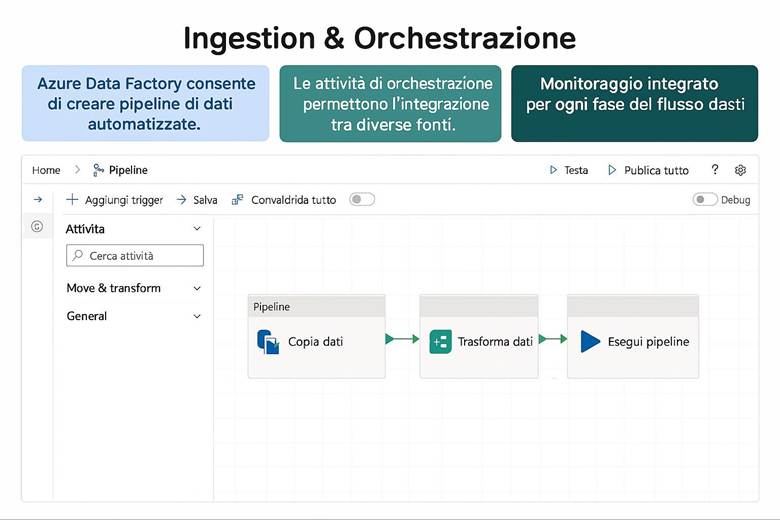

1. Azure Data Factory: Orchestrazione di Pipeline di Dati

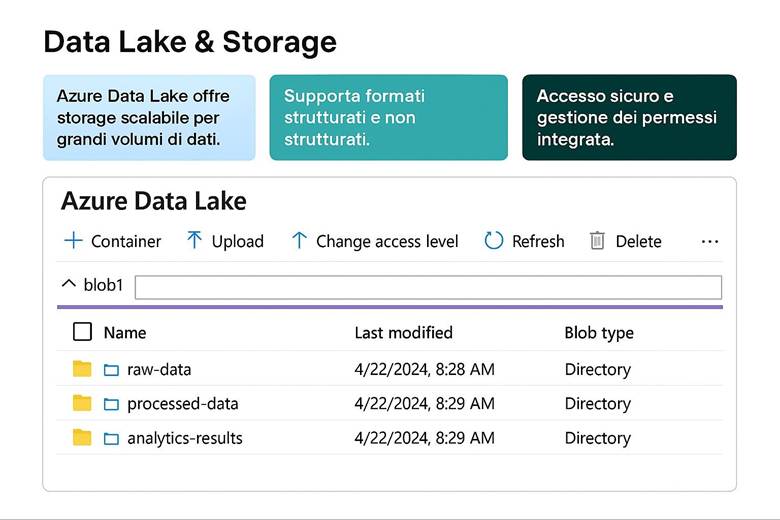

2. Azure Data Lake Storage Gen2: Fondamenti e Best Practice

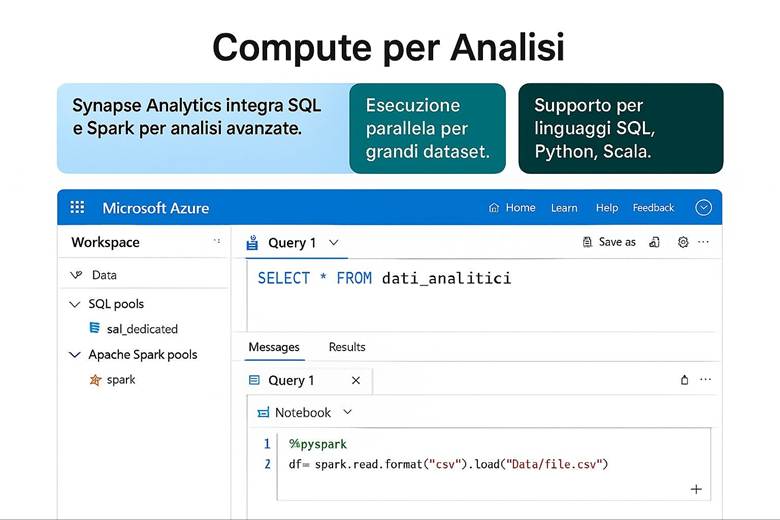

3. Azure Synapse Analytics: Integrazione di SQL e Spark

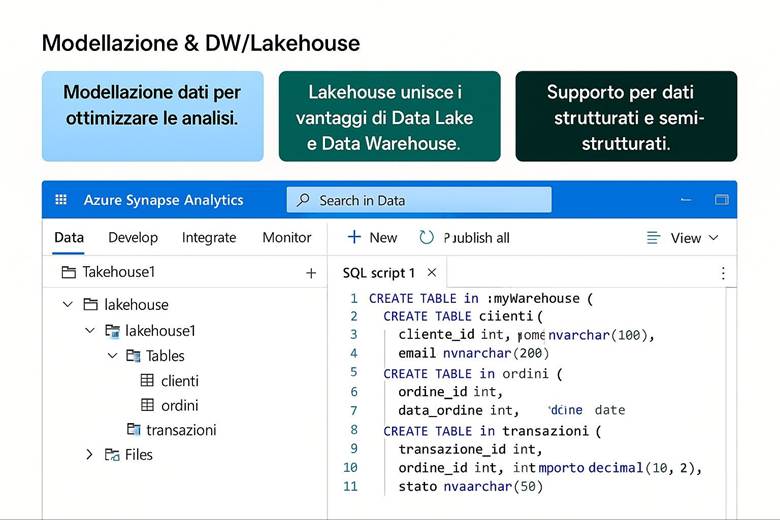

4. Lakehouse e Medallion Architecture: Unire Data Lake e Data Warehouse

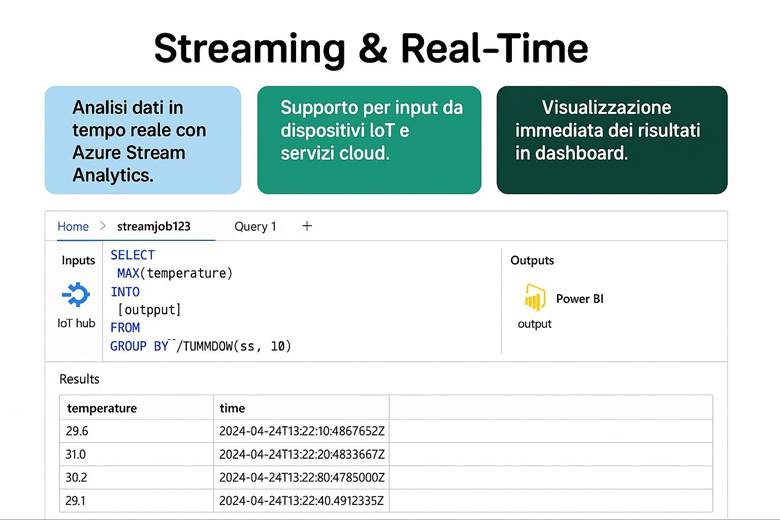

5. Azure Stream Analytics: Elaborazione Dati in Tempo Reale

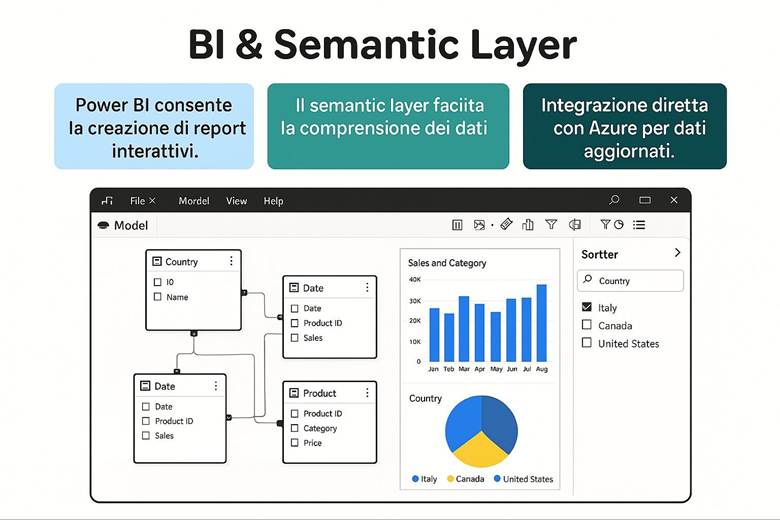

6. Power BI: Modelli Semantici per l’Analisi Self-Service

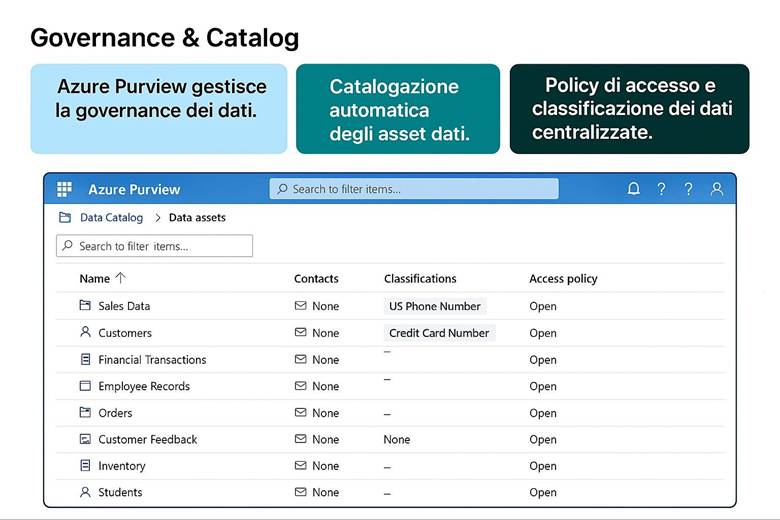

7. Microsoft Purview: Catalogo Dati e Data Governance

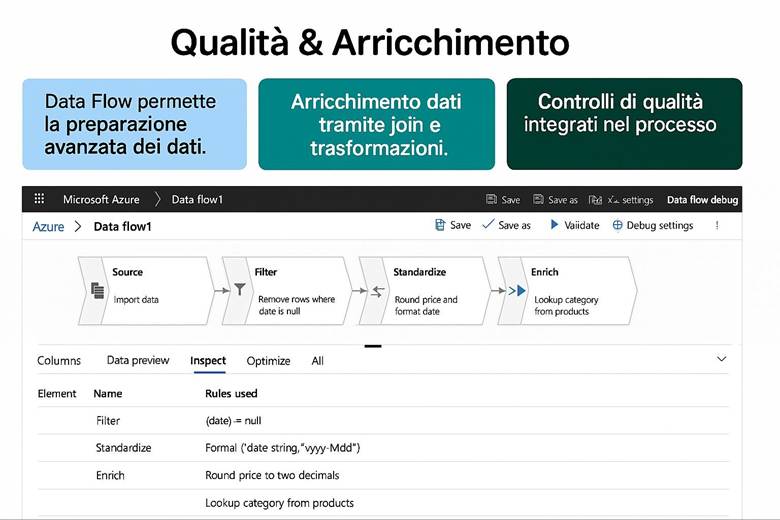

8. Mapping Data Flows: Trasformazioni Visive Scalabili

9. Sicurezza dei Dati Analitici in Azure

10. Monitoraggio e Gestione dei Costi in Azure

CAPITOLO 12 – Il servizio governance

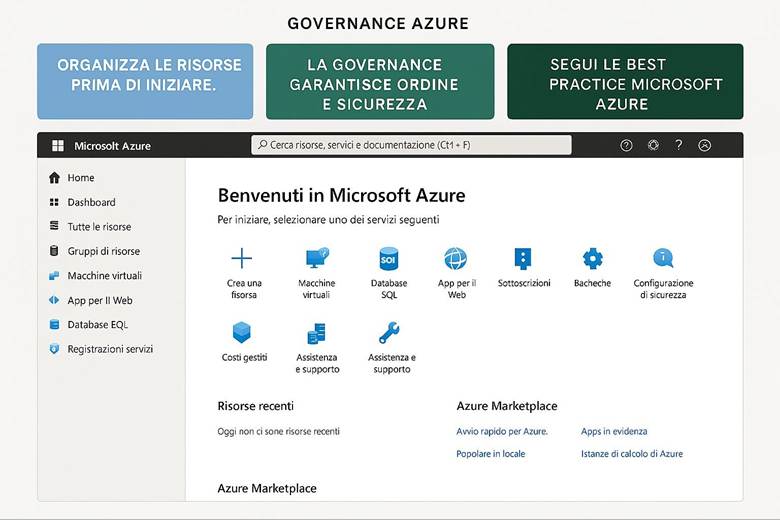

Inquadramento argomenti del capitolo con slides illustrate

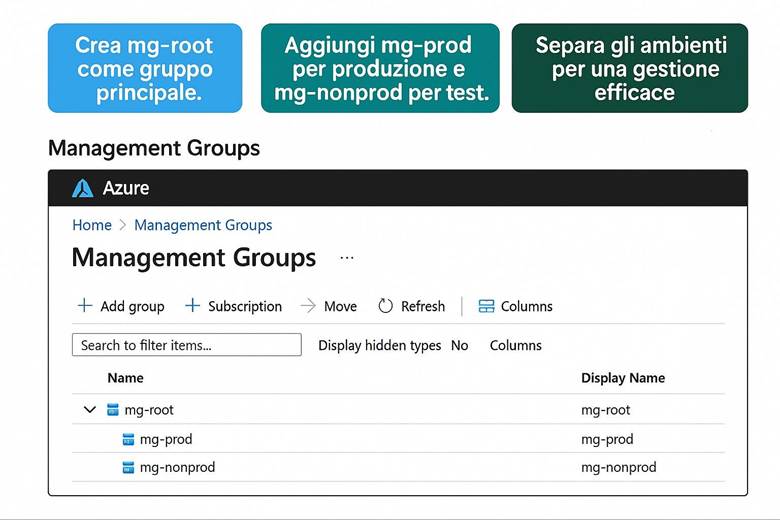

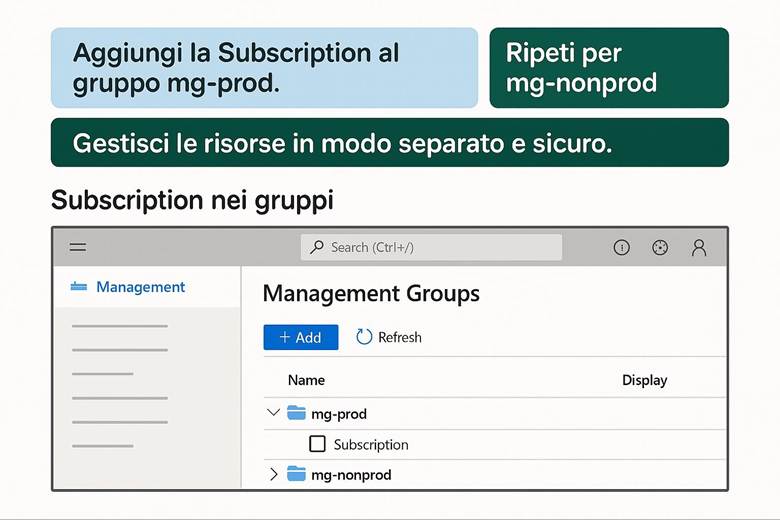

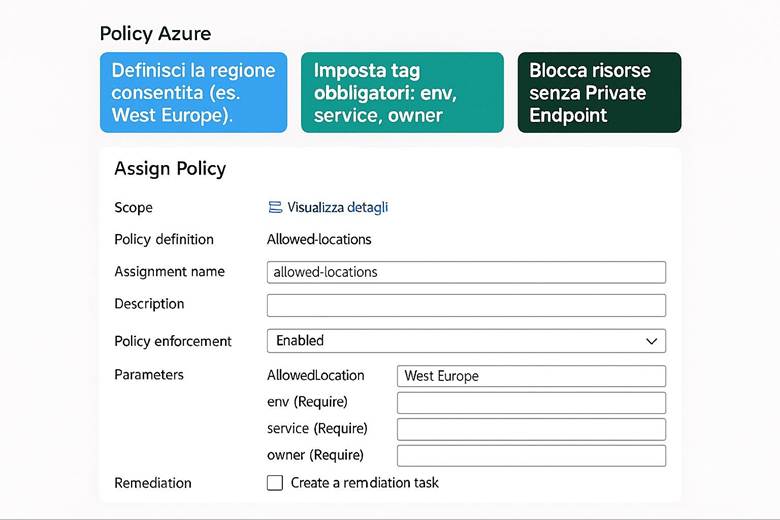

1. Gruppi di gestione (Management Groups)

3. Controllo degli accessi (RBAC)

4. Gestione dei costi e budget

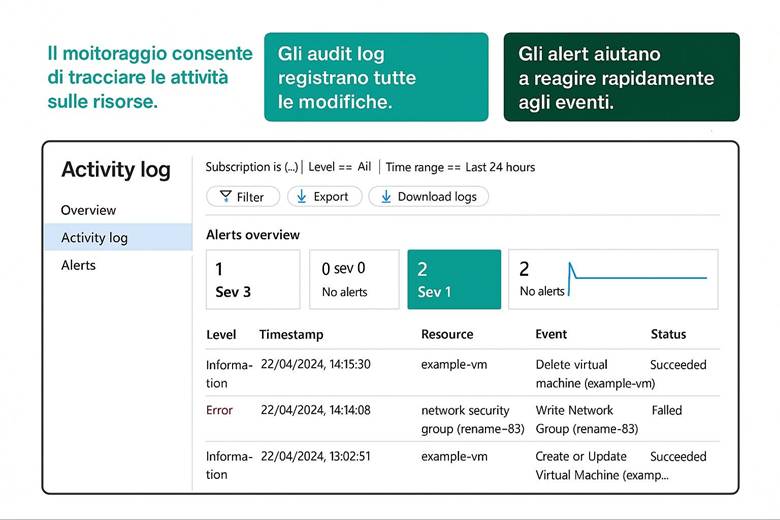

7. Monitoraggio, audit e alert

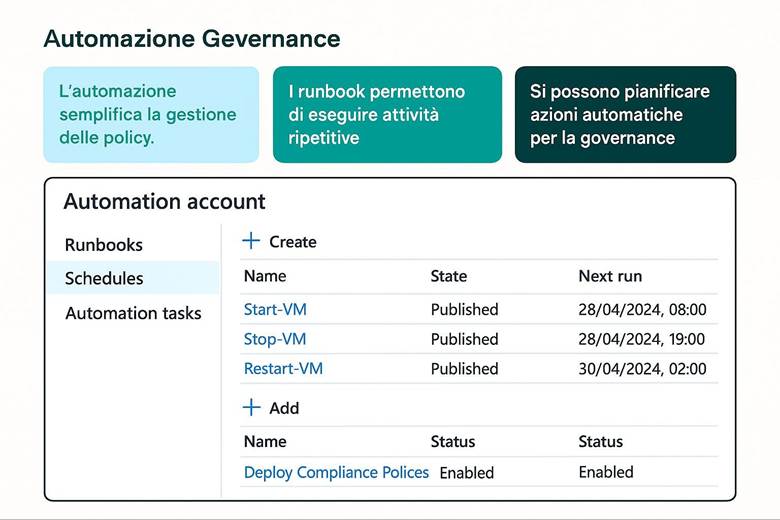

8. Automazione della governance

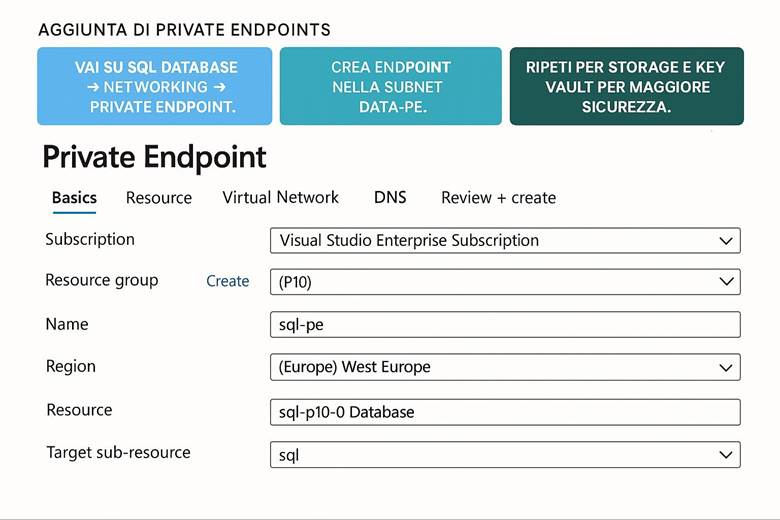

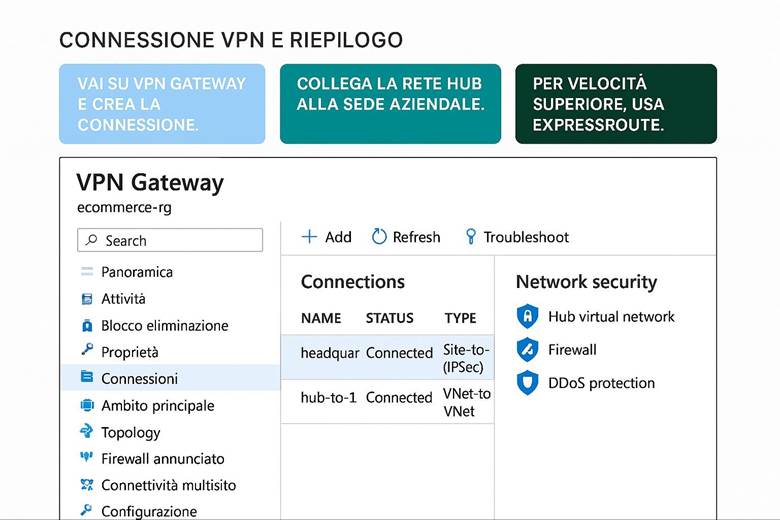

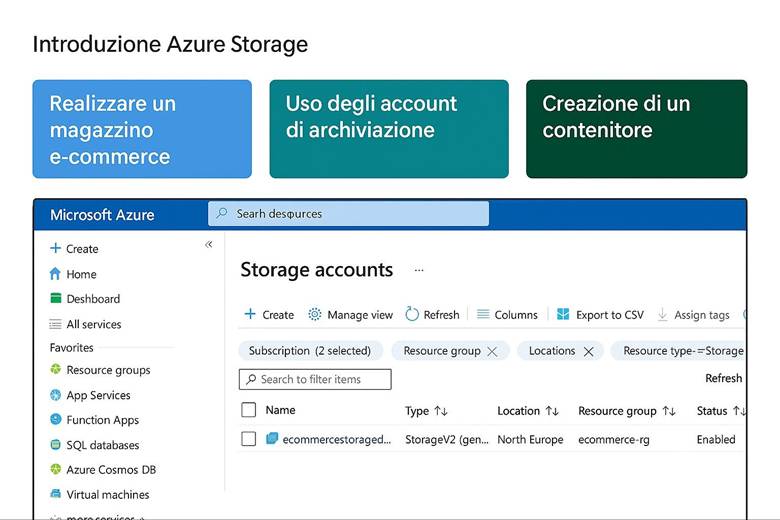

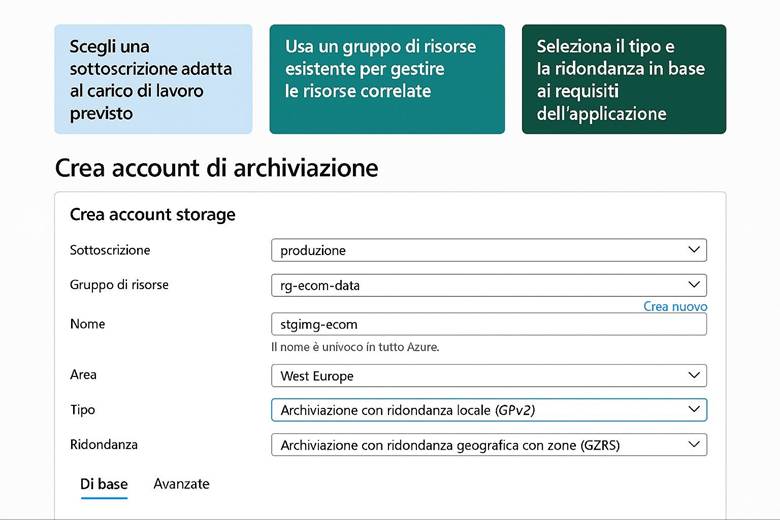

PROGETTO FINALE – Realizzazione di un e-commerce

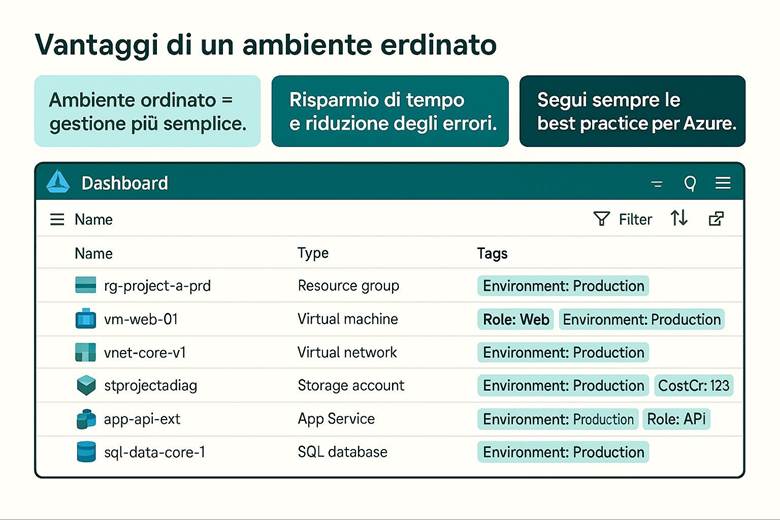

1. Prepariamo della scatola dove mettere le cose (Governance)

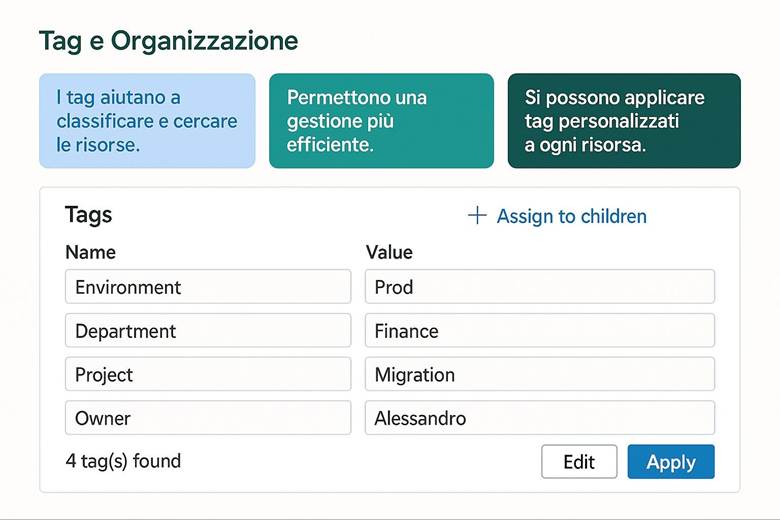

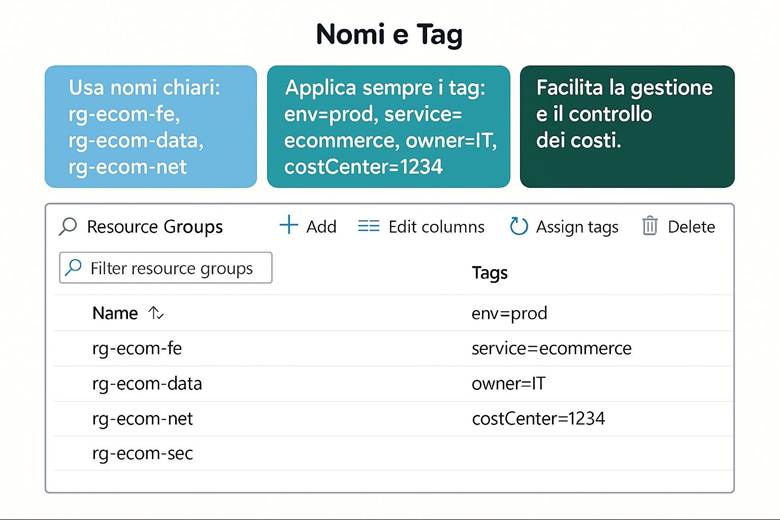

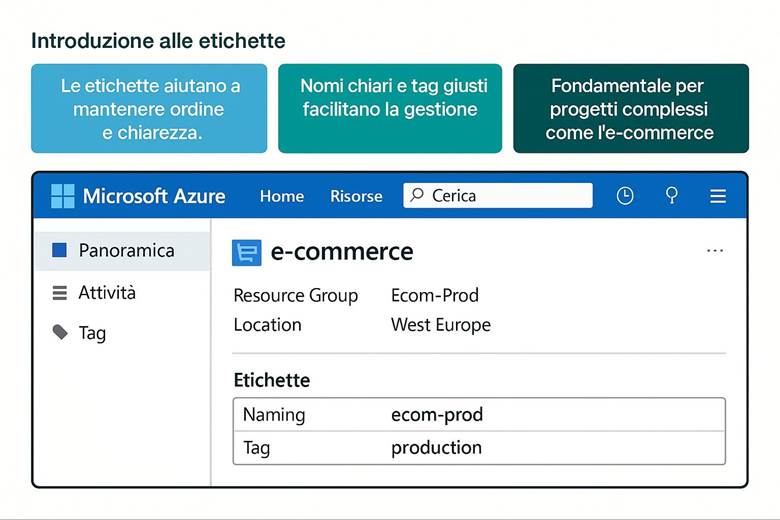

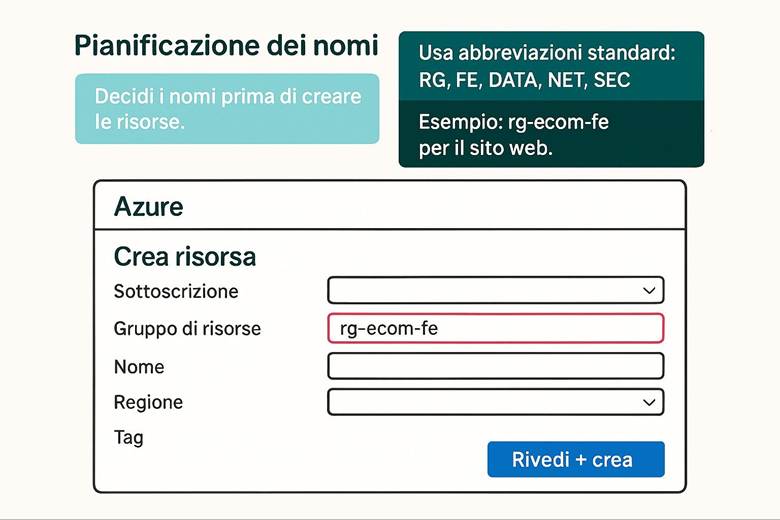

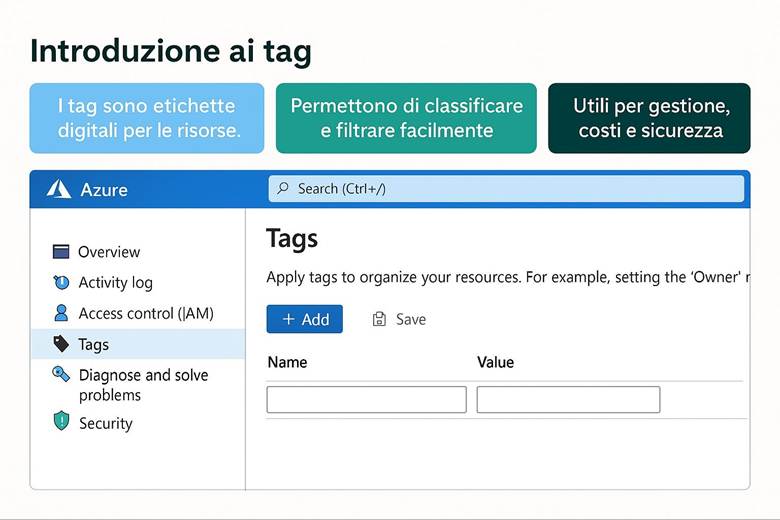

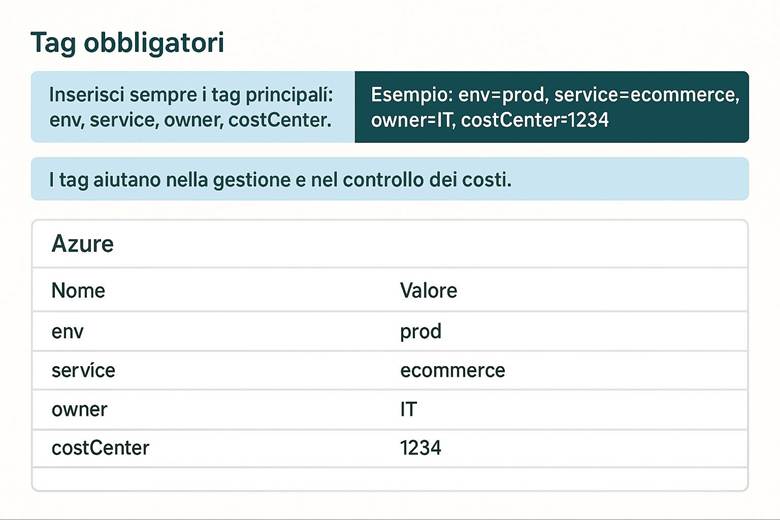

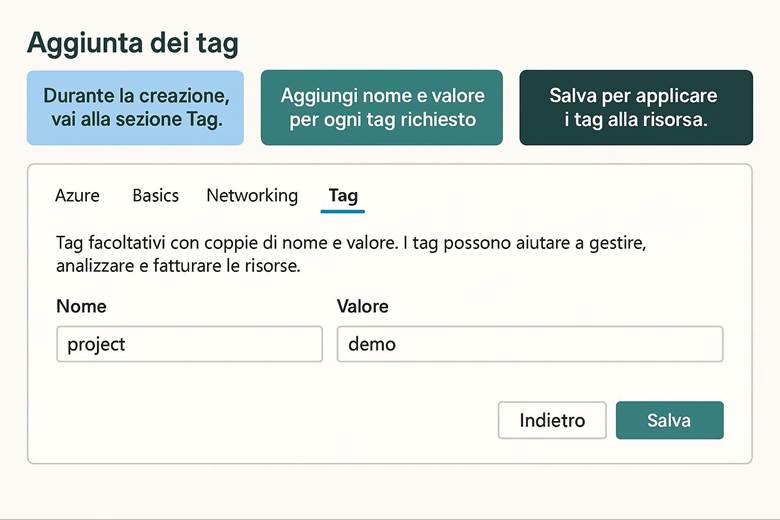

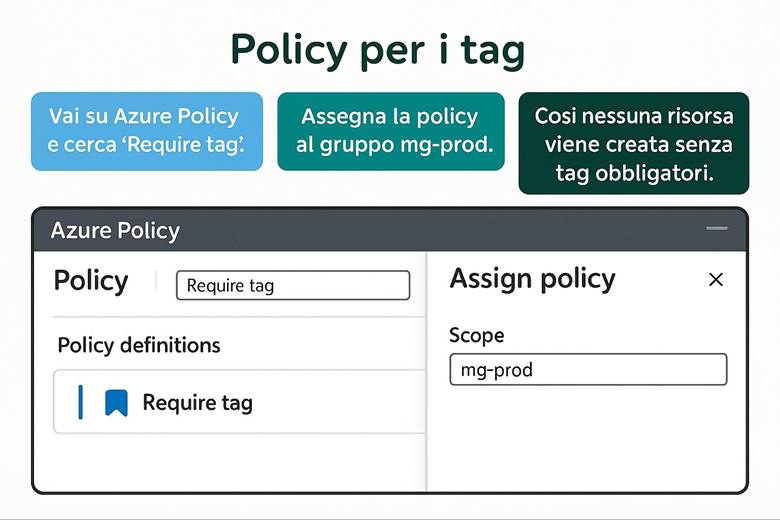

2. Attribuiamo le etichette agli oggetti per riconoscerli (Naming e Tag)

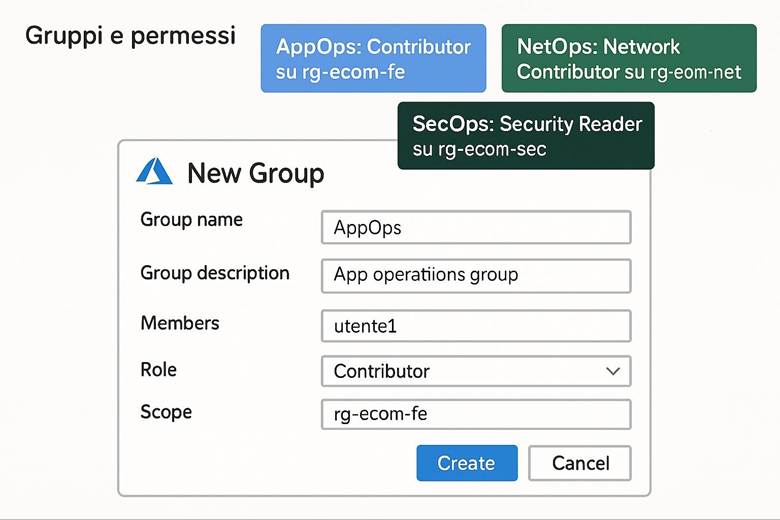

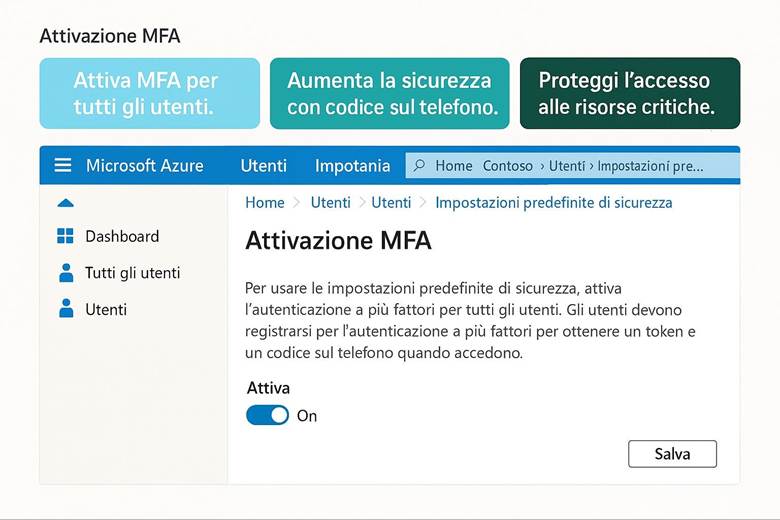

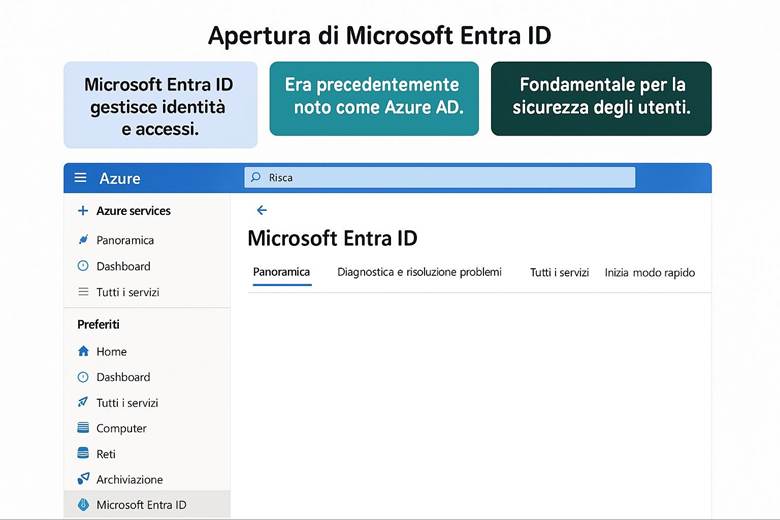

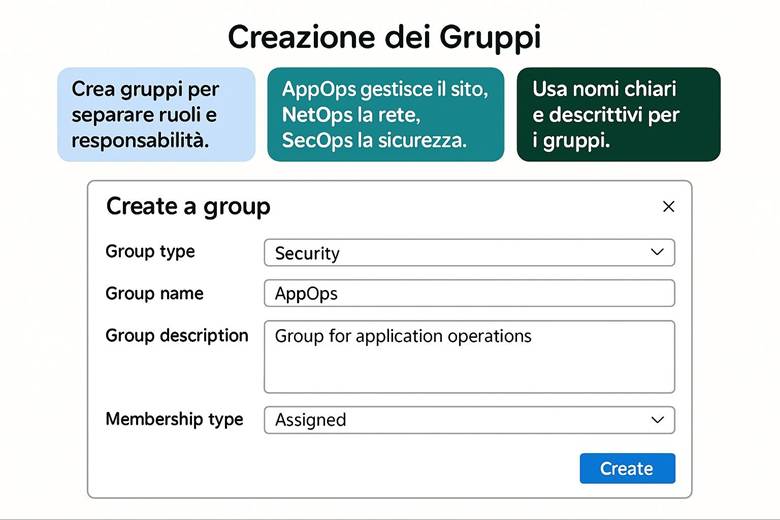

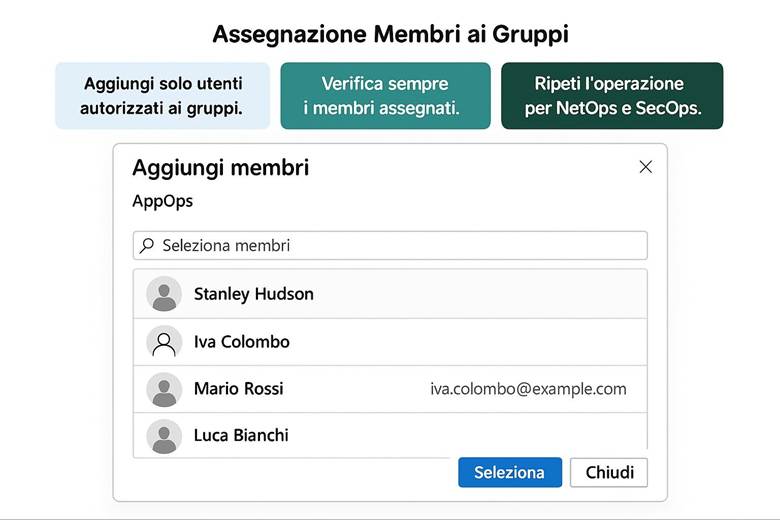

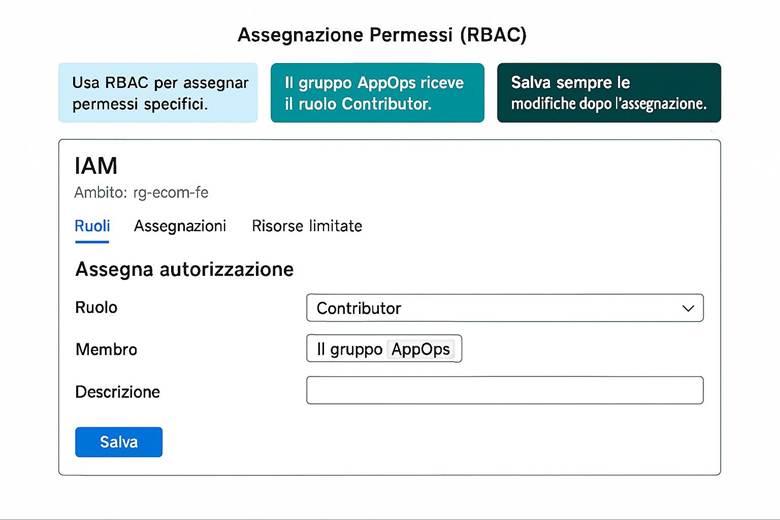

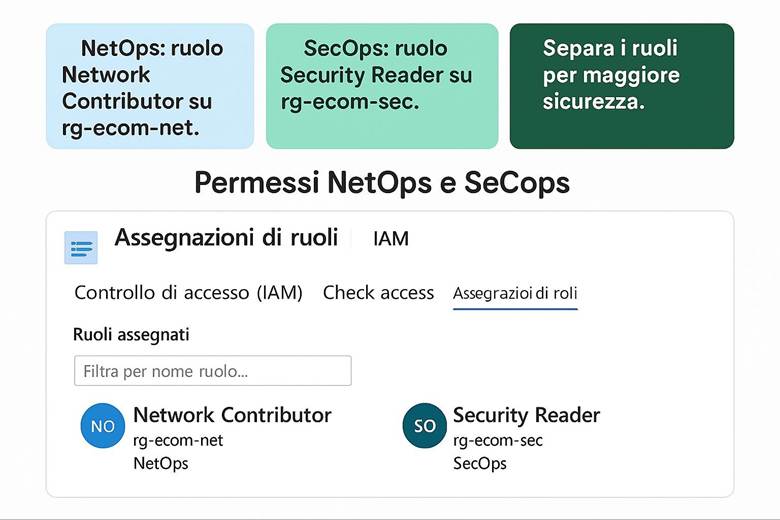

3. Chi può entrare? (Sicurezza e Utenti)

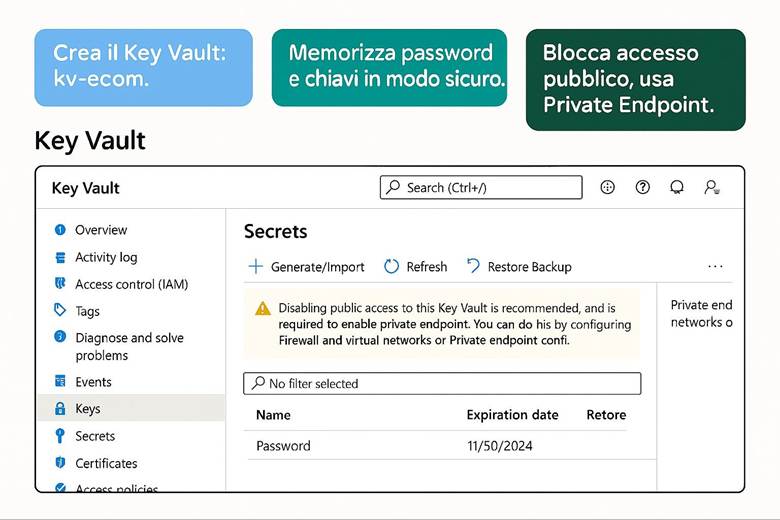

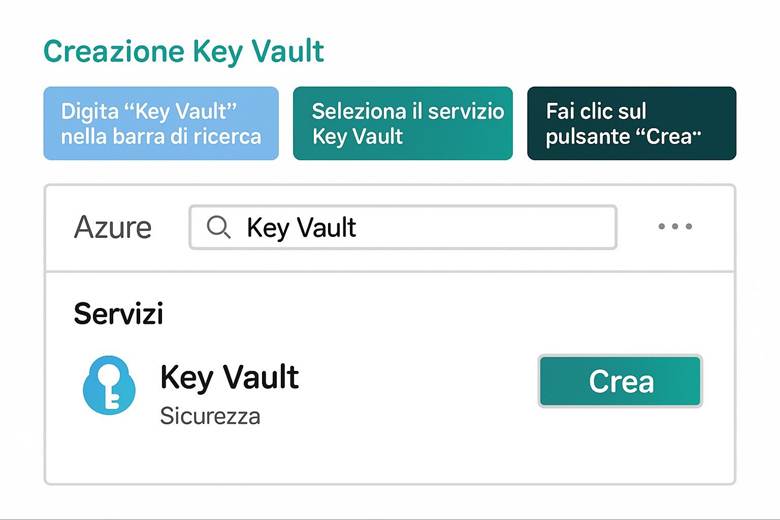

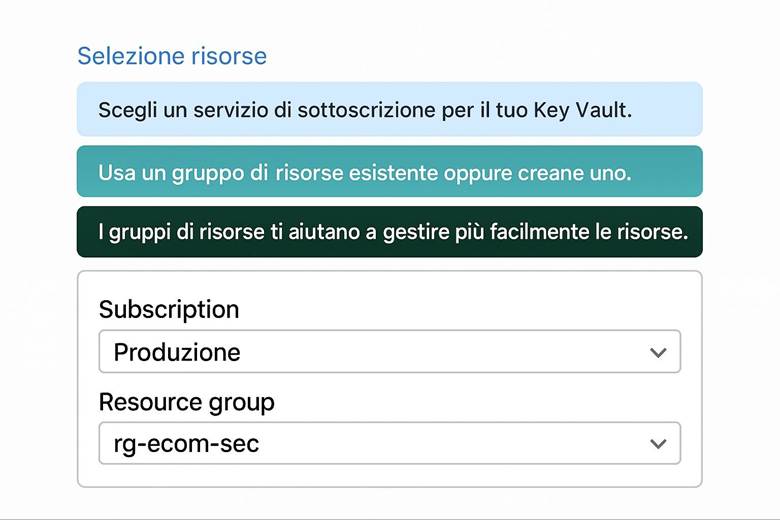

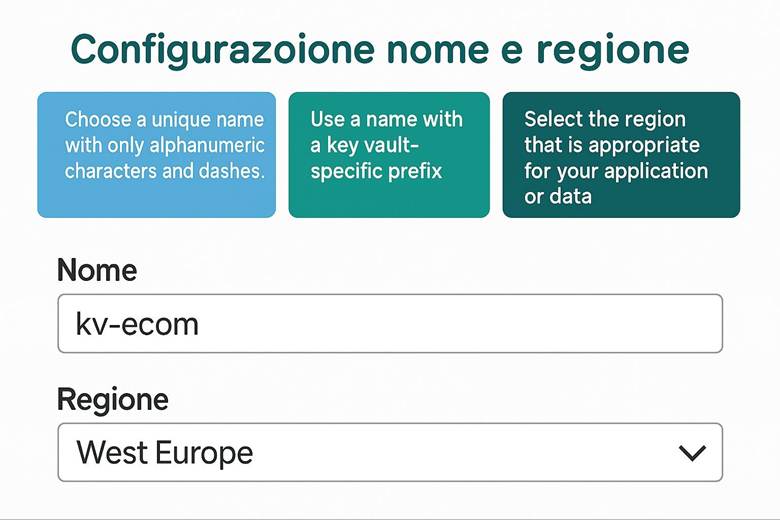

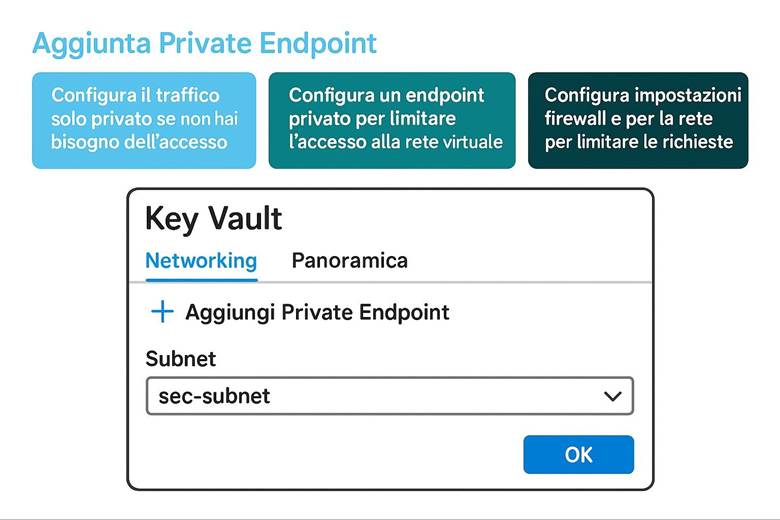

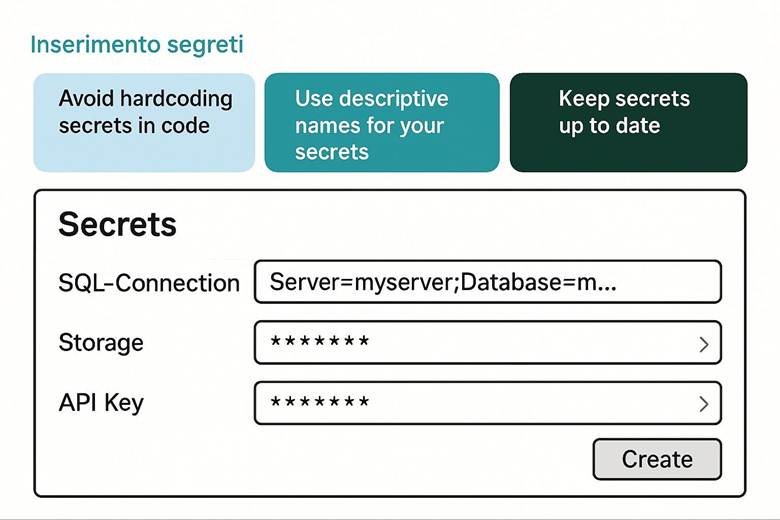

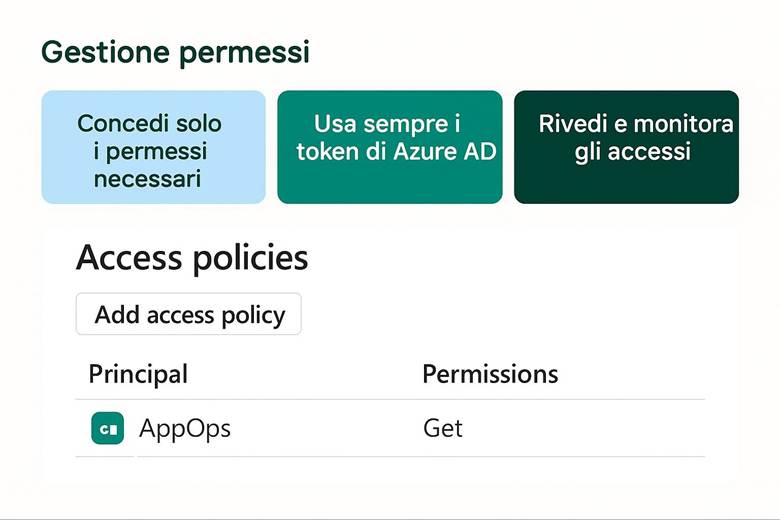

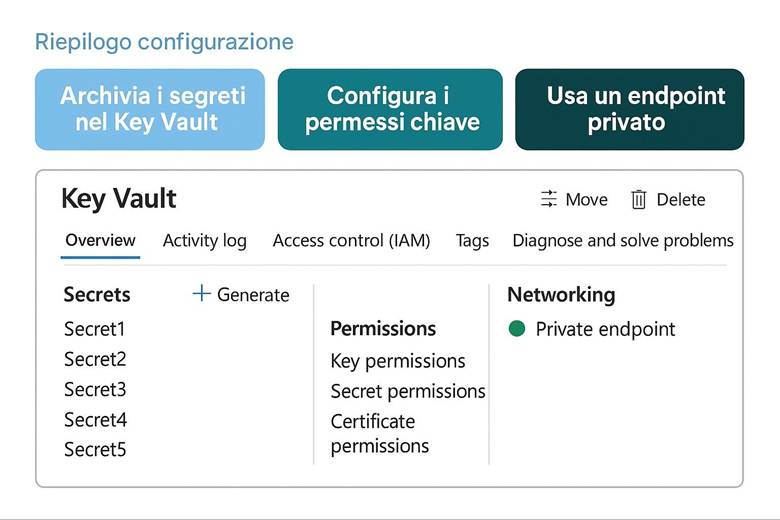

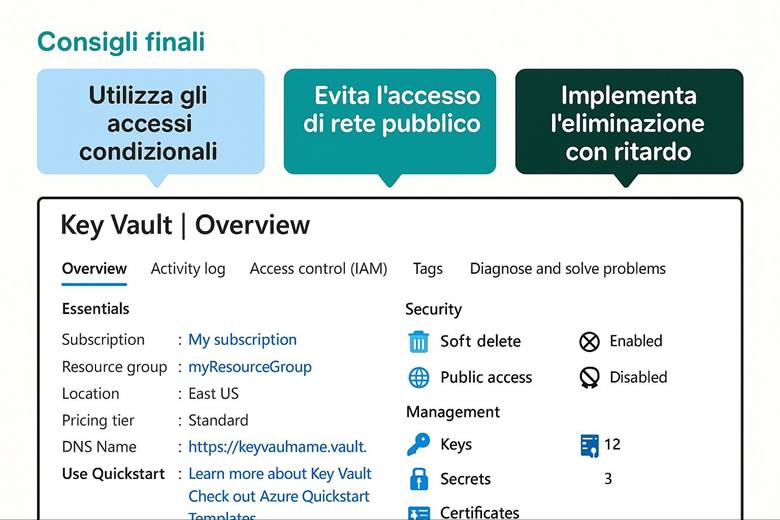

4. Costruiamo una cassaforte per custodire le chiavi (Key Vault)

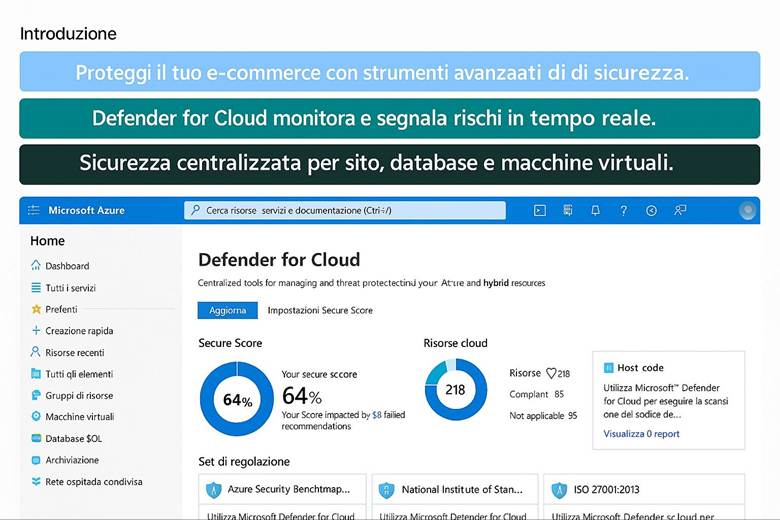

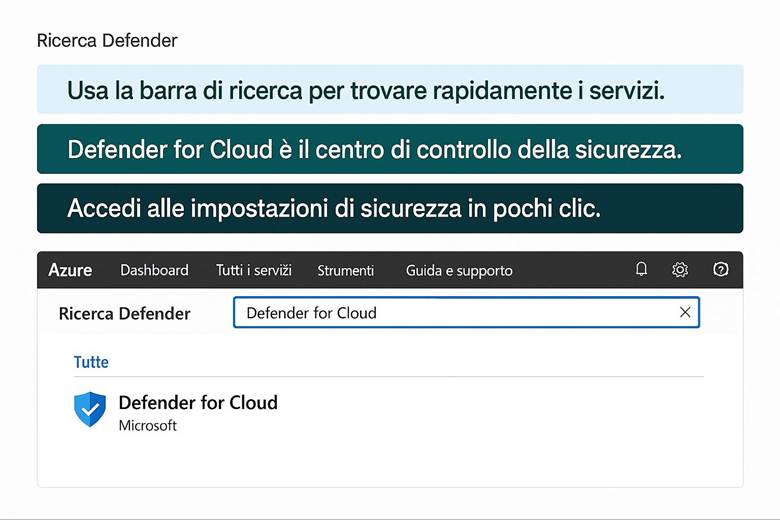

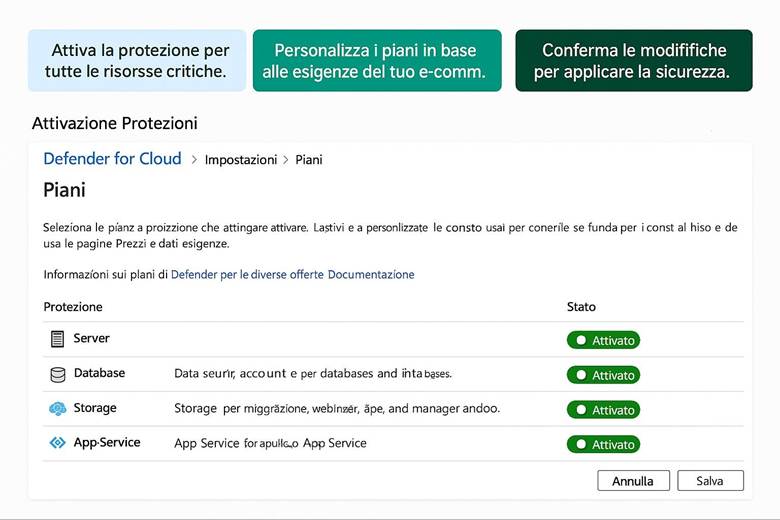

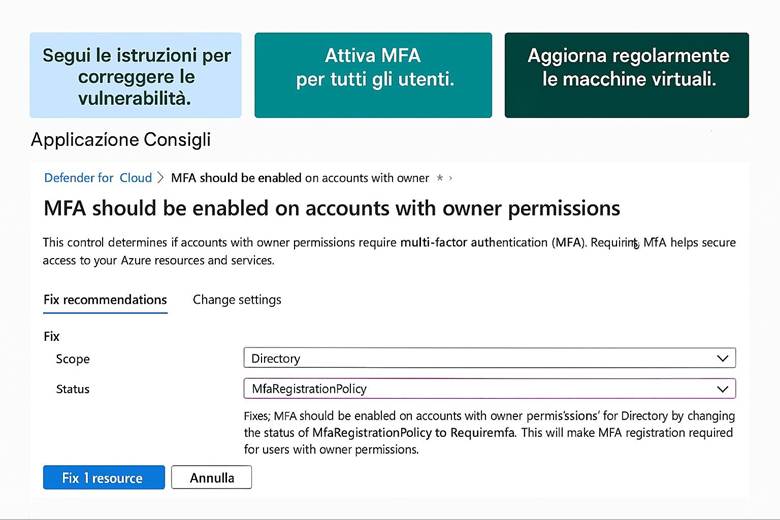

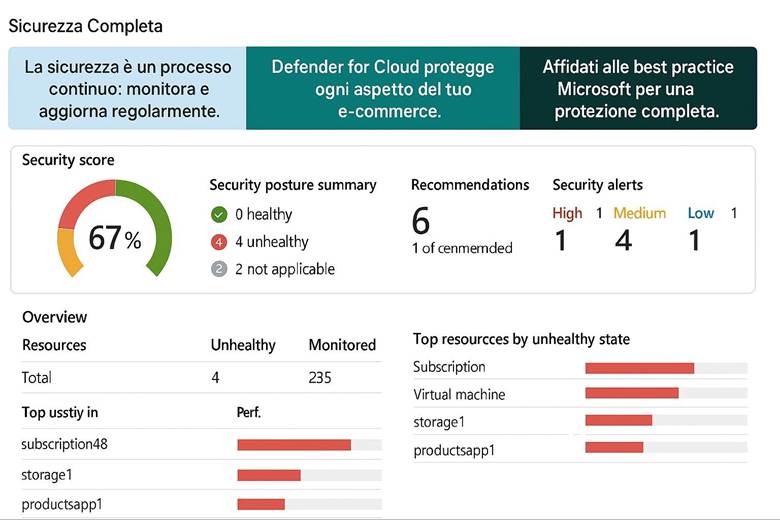

5. Costruiamo un sistema di difesa (Defender for Cloud)

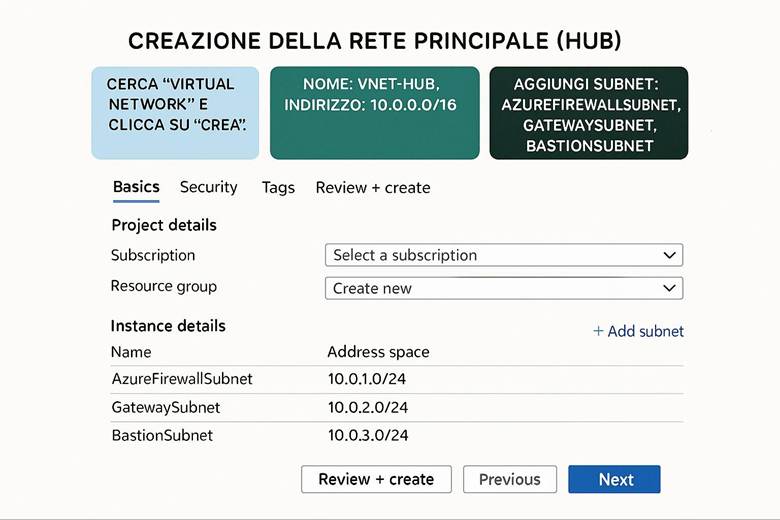

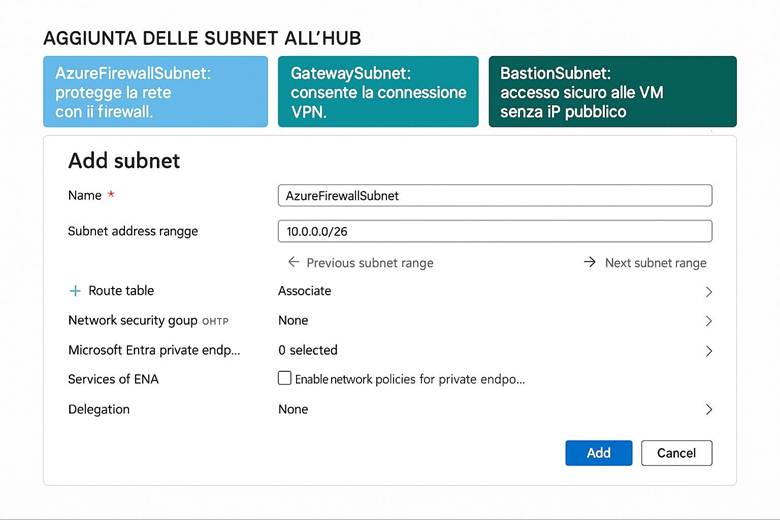

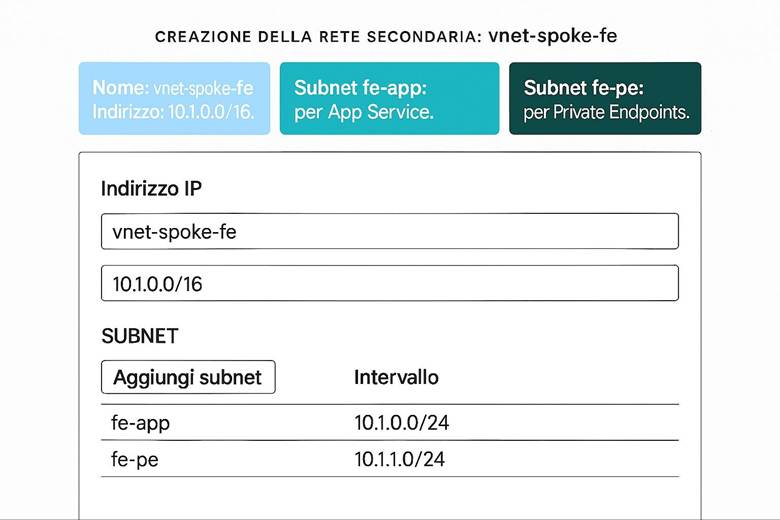

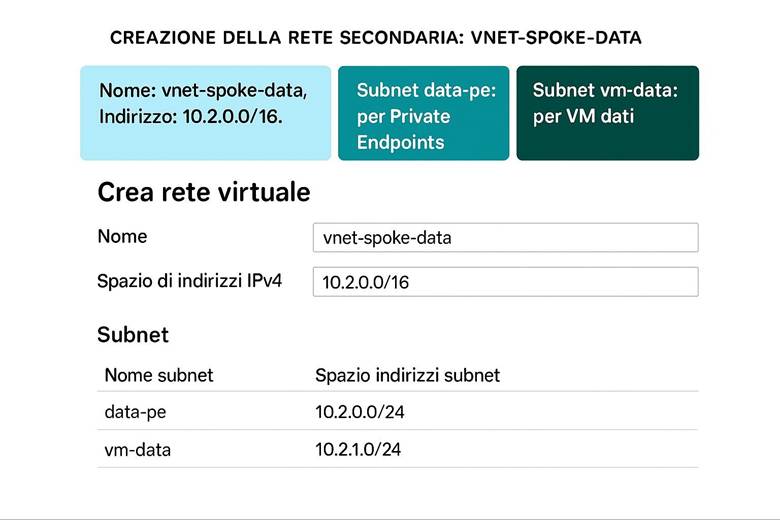

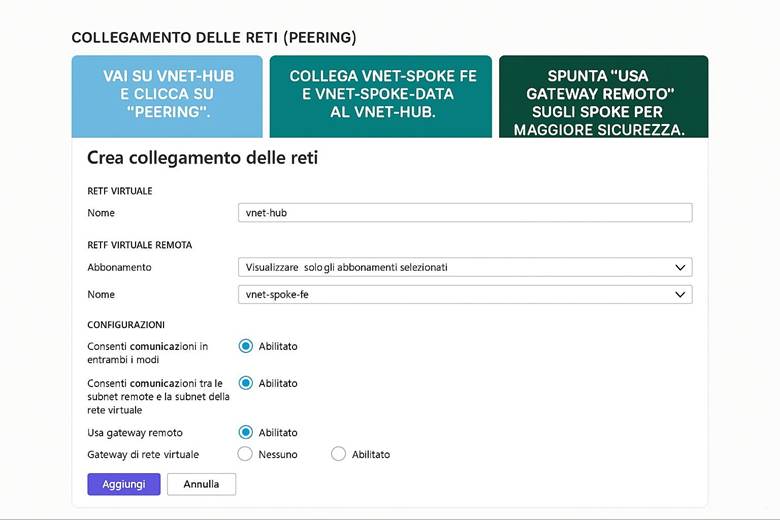

6. Costruiamo le strade che collegano le risorse (Rete)

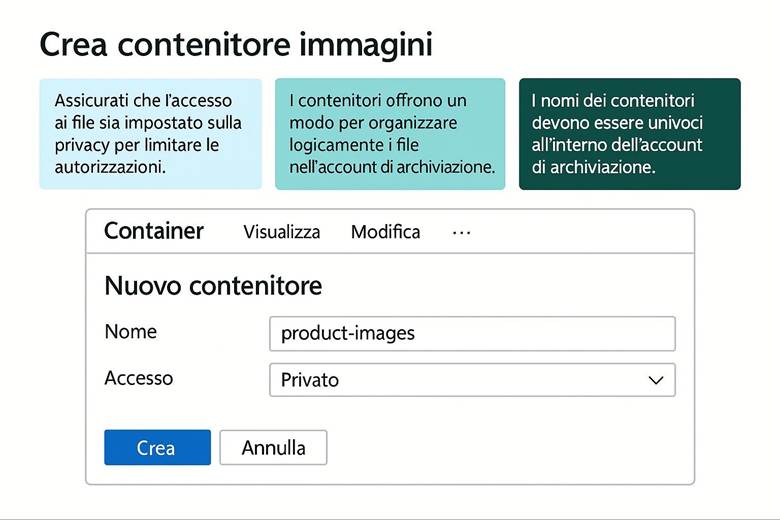

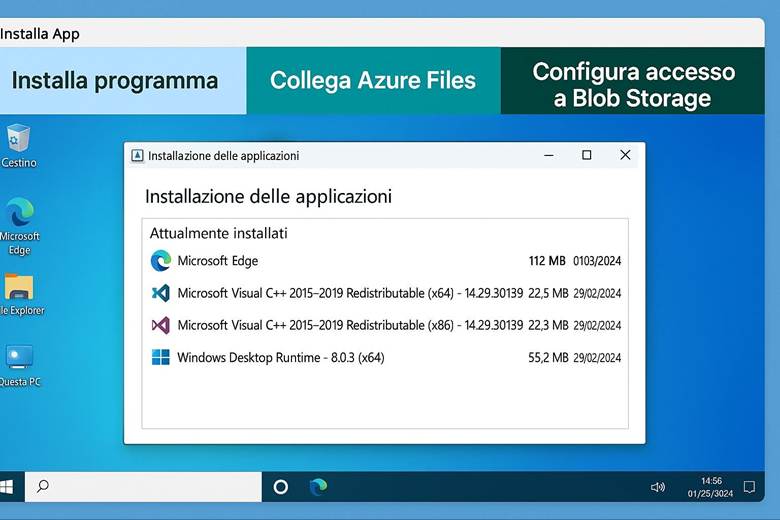

7. Costruiamo il magazzino per i nostri oggetti (Storage)

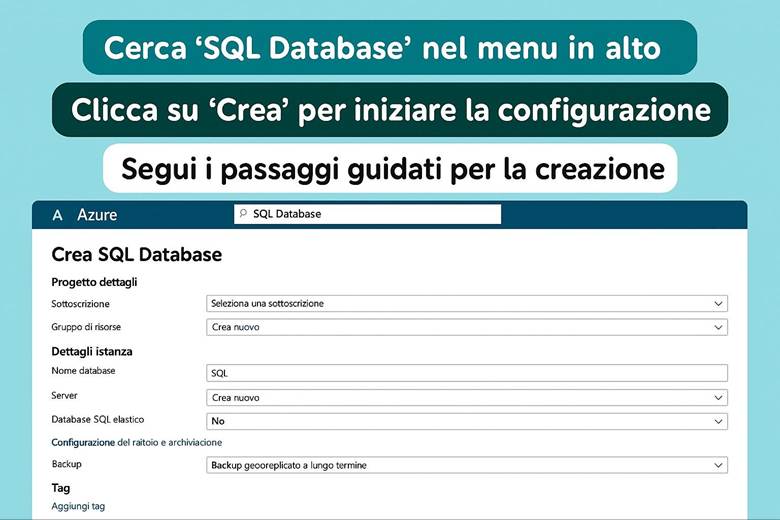

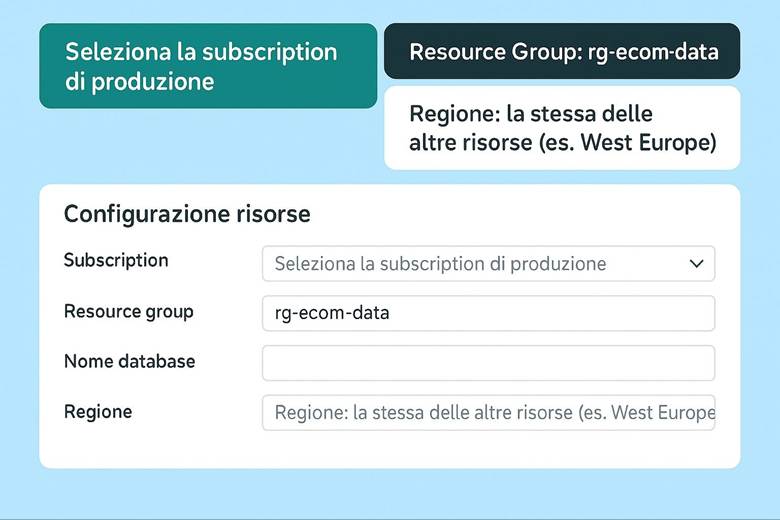

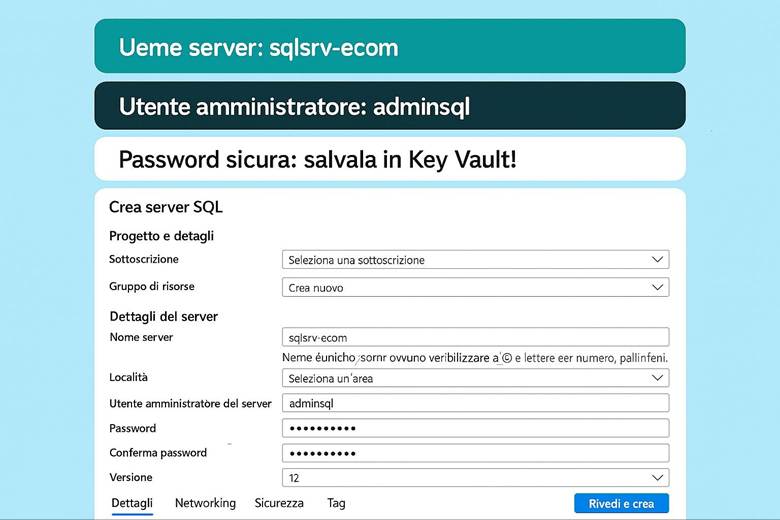

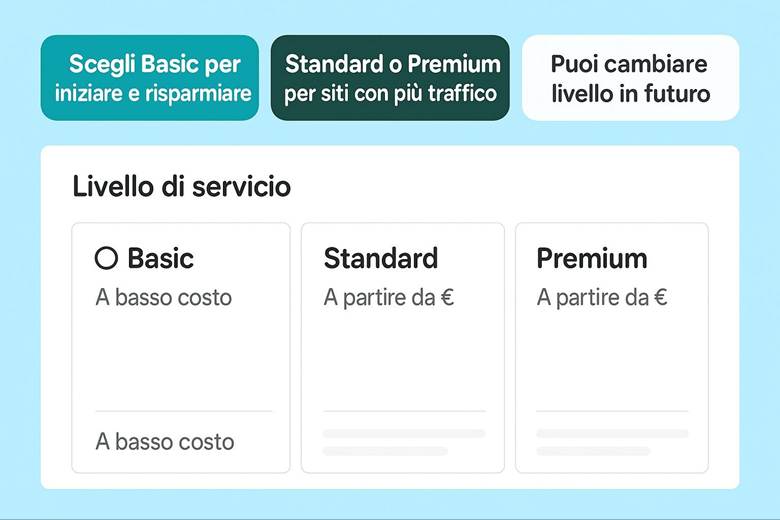

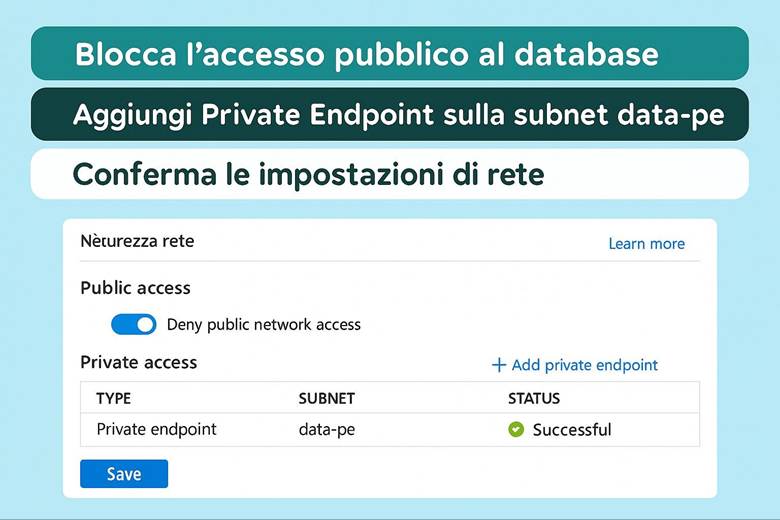

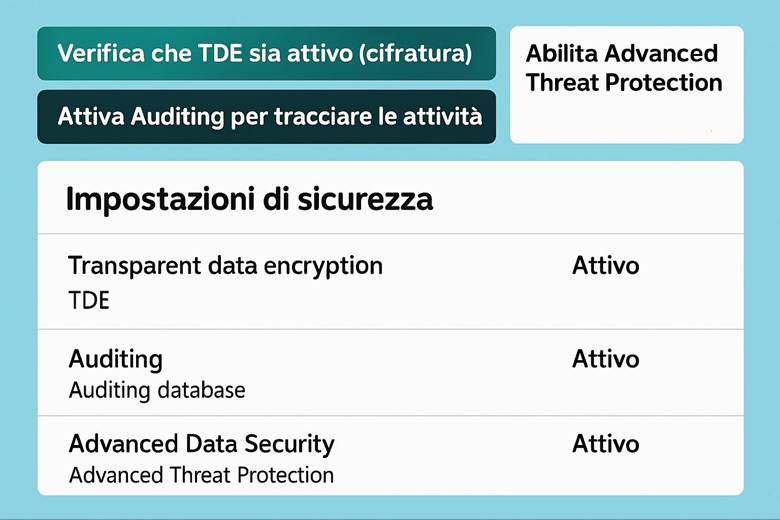

8. Costruiamo il database per prodotti, ordini e clienti (SQL)

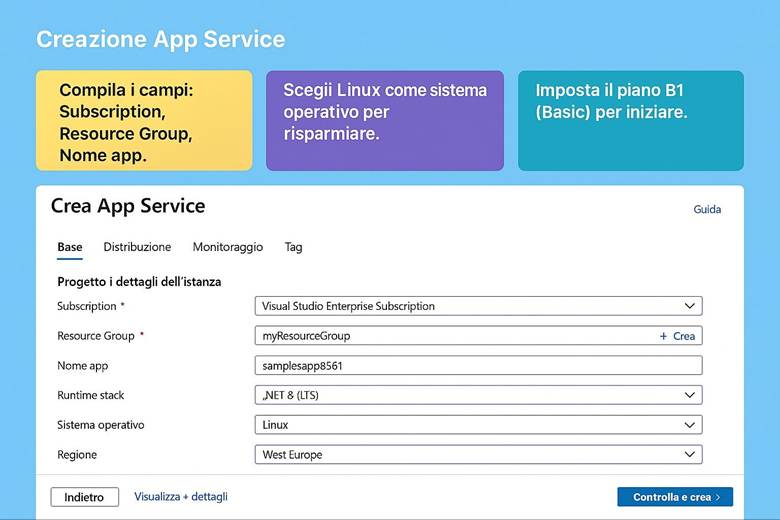

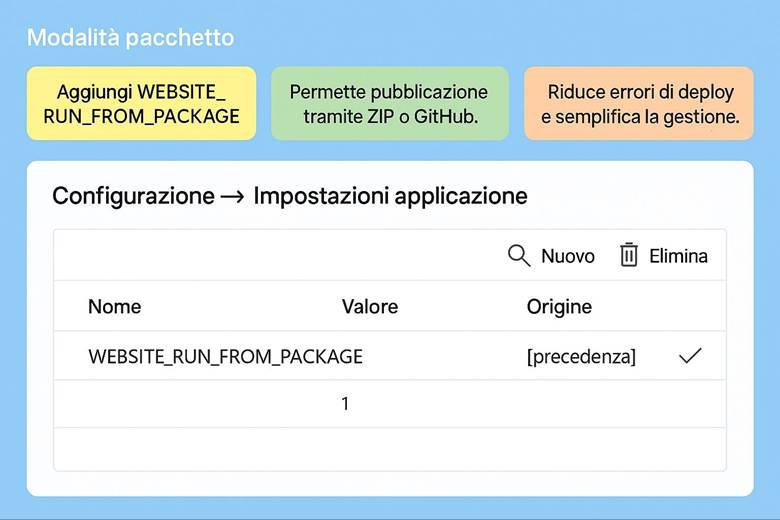

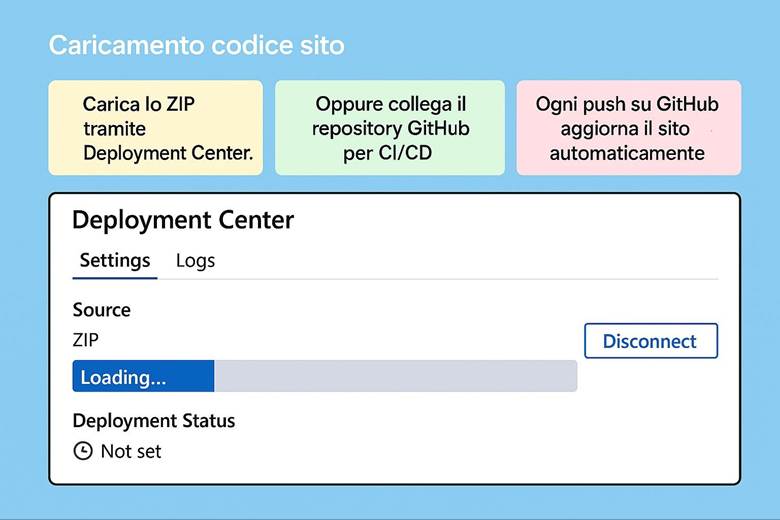

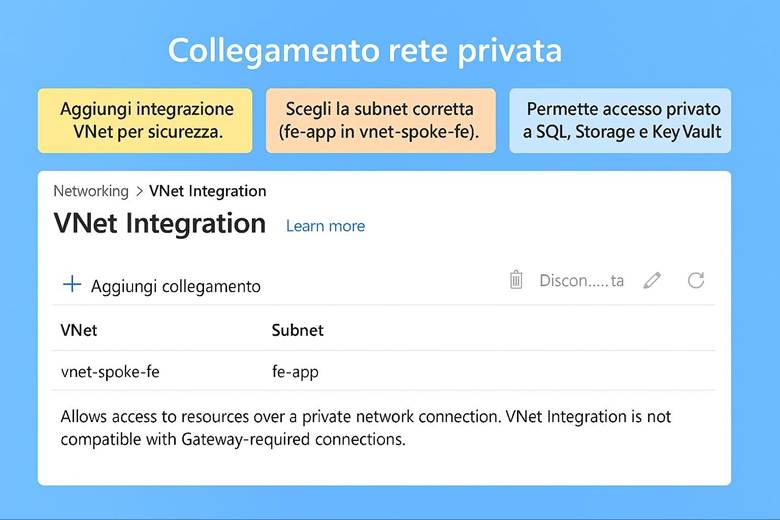

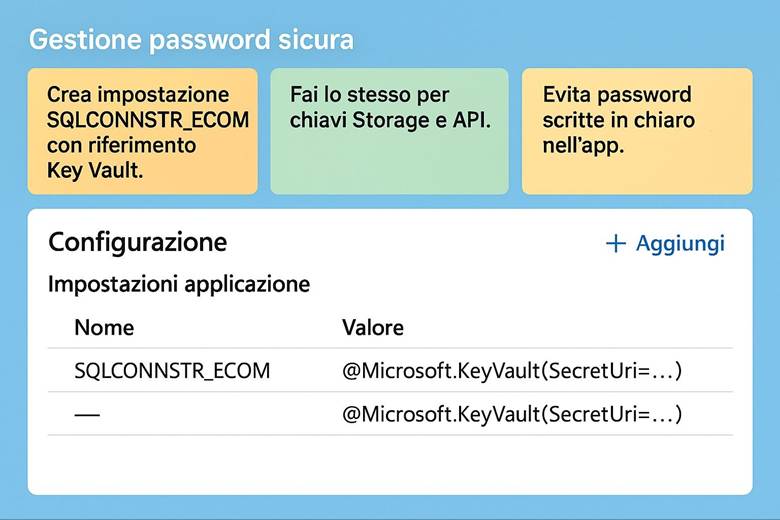

9. Costruiamo il sito: l’interfaccia utente dell’e-commerce (App Service)

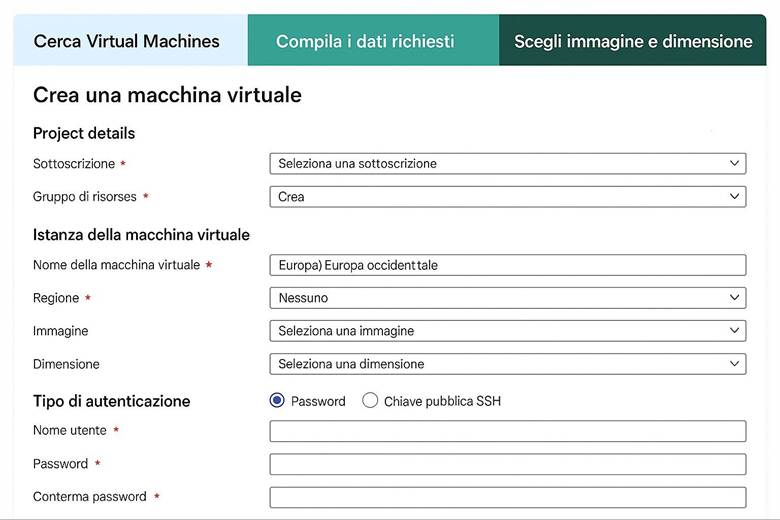

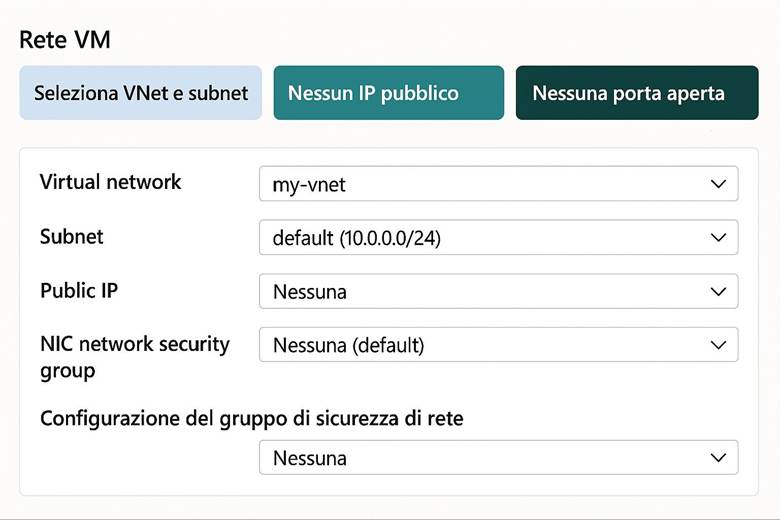

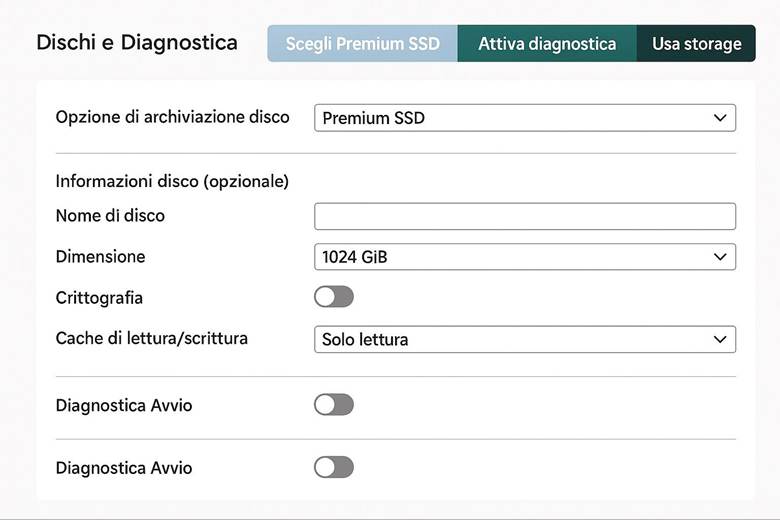

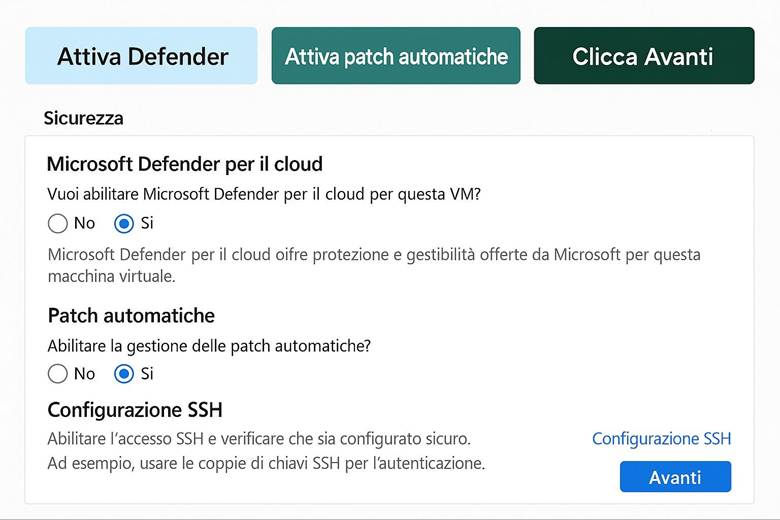

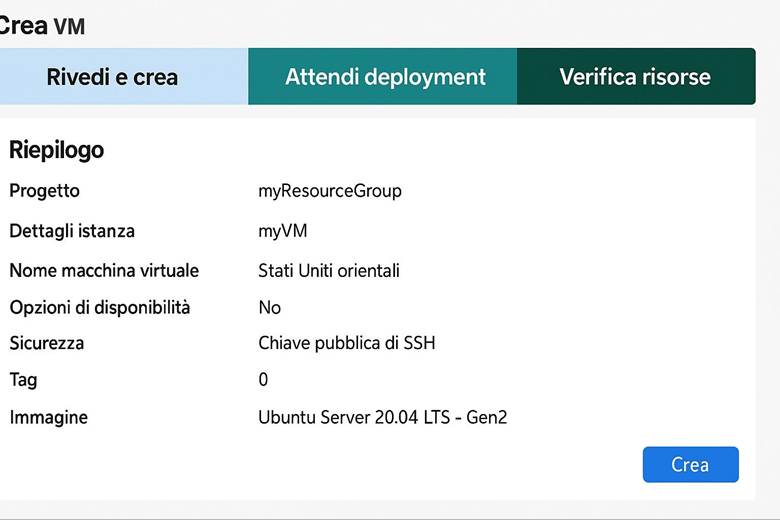

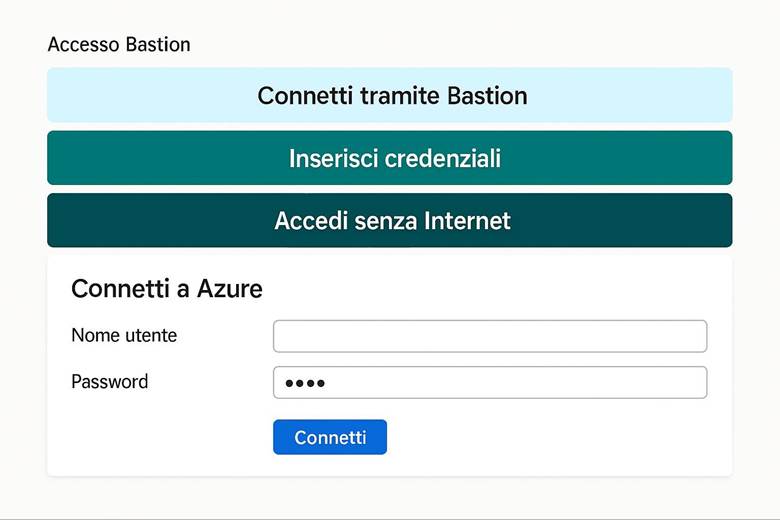

10. Aggiungiamo un computer virtuale per le nostre operazioni (VM)

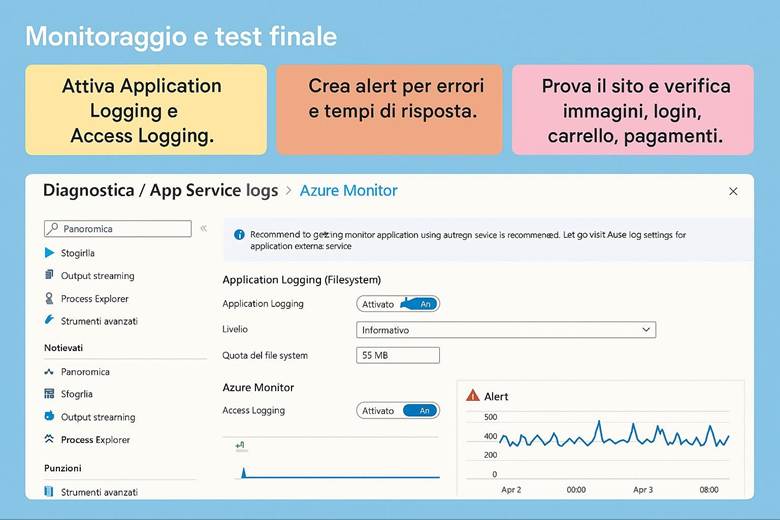

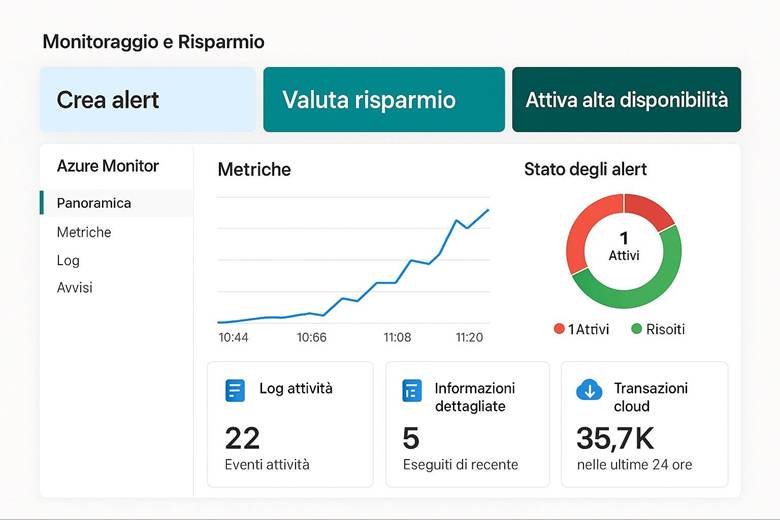

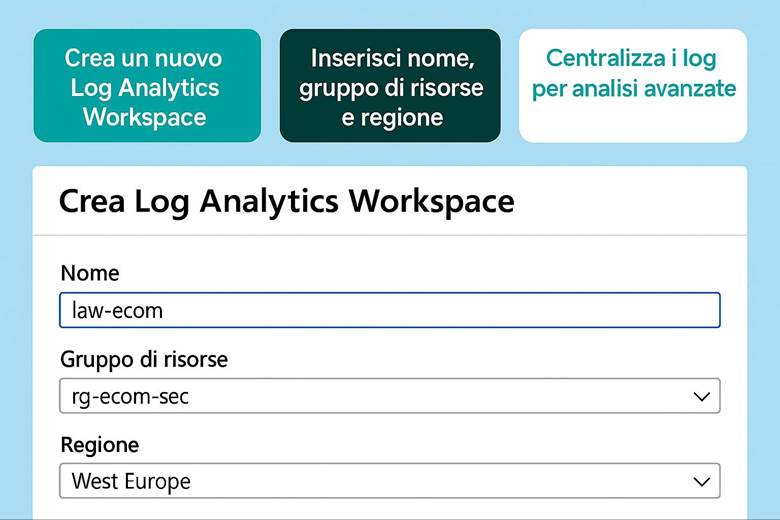

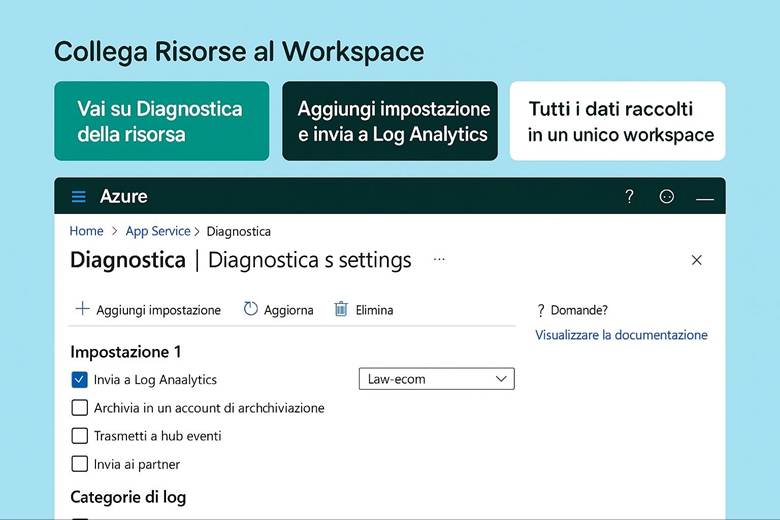

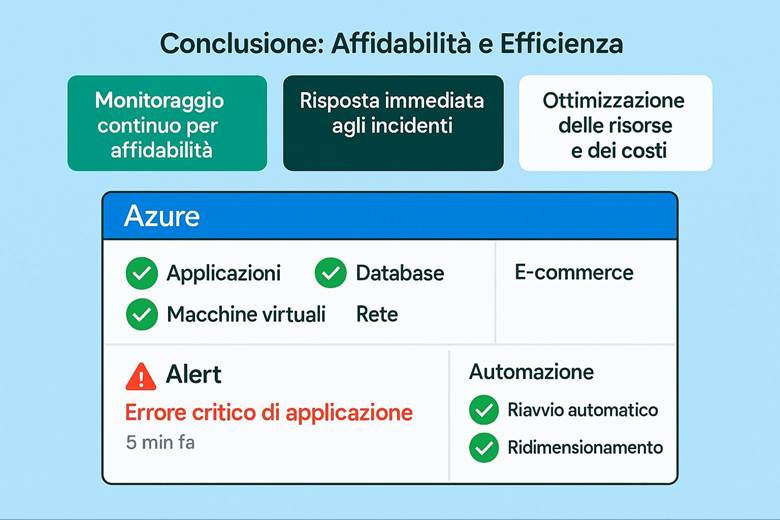

11. Teniamo tutto sotto controllo (Monitor)

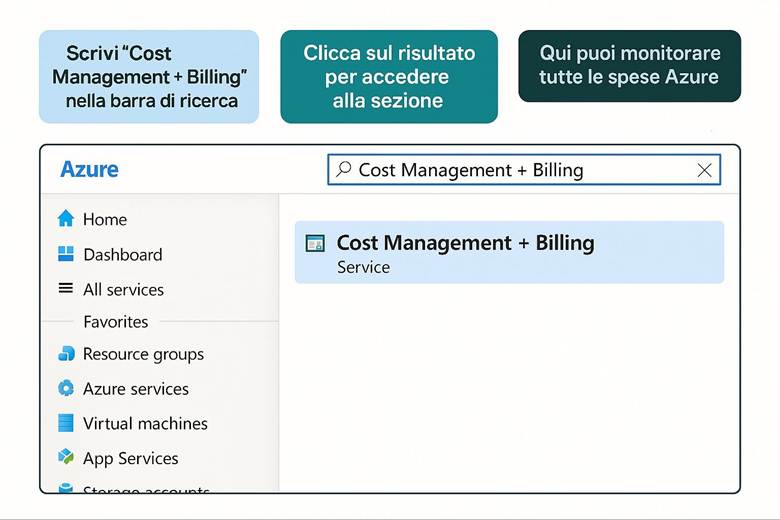

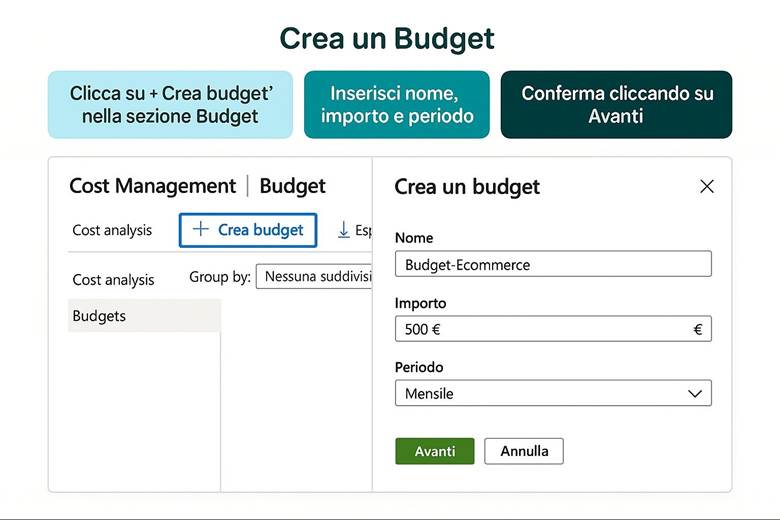

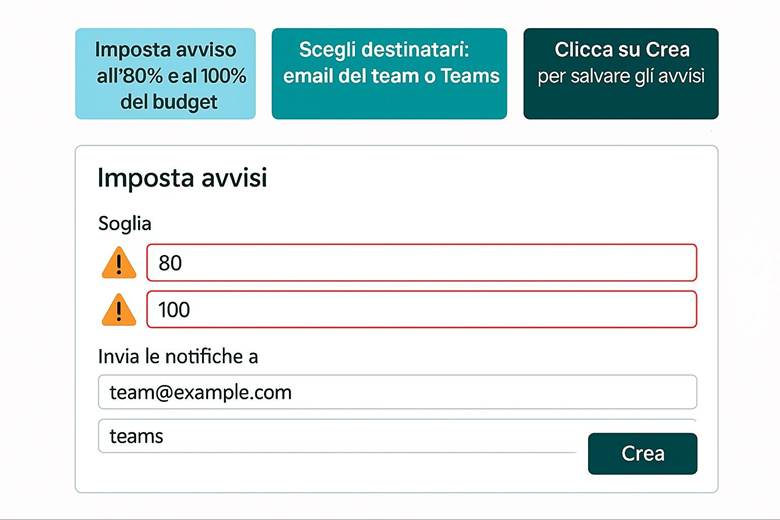

12. Teniamo sotto controllo i costi (Cost Management)

1. Cosa si impara e quali posizioni si possono ricoprire a lavoro

2. Profilo LinkedIn – Specialista in Governance Cloud su Microsoft Azure

3. Curriculum vitae basato su queste competenze

Prefazione dell’autore

Viviamo in un’epoca in cui il cloud computing è diventato il motore dell’innovazione digitale. Tra le piattaforme più diffuse e potenti, Microsoft Azure si distingue per la sua flessibilità, scalabilità e capacità di supportare aziende di ogni dimensione nella trasformazione digitale. Ma utilizzare il cloud in modo efficace non significa solo “spostare” le risorse online: significa anche saperle governare.

Questo ebook nasce con l’obiettivo di guidarti alla scoperta della governance in Azure, un insieme di strumenti e pratiche che permettono di mantenere il controllo su risorse, costi, sicurezza e conformità. Imparerai come strutturare un ambiente Azure ordinato e sicuro, come applicare regole aziendali attraverso le Azure Policy, come gestire gli accessi con RBAC, come monitorare i costi e come garantire che ogni risorsa sia conforme agli standard richiesti.

Per le aziende, una buona governance in Azure significa ridurre i rischi, migliorare la sicurezza, ottimizzare i costi e garantire che ogni team lavori in autonomia ma nel rispetto delle regole comuni. Per te, lettore, significa acquisire competenze sempre più richieste nel mondo del lavoro, in un settore in continua crescita.

Questo ebook è pensato per studenti, professionisti junior o chiunque voglia avvicinarsi al mondo del cloud con un approccio pratico e strutturato. Ogni capitolo affronta un tema chiave con un linguaggio chiaro, esempi concreti e suggerimenti operativi.

Ti invito ad affrontare la lettura con curiosità e spirito pratico. Non è necessario essere esperti di Azure per iniziare: l’importante è avere voglia di imparare e di comprendere come il cloud può essere gestito in modo intelligente. Alla fine del percorso, avrai una visione completa della governance in Azure e sarai pronto a metterla in pratica nei tuoi progetti o a presentarti con maggiore sicurezza nel mondo del lavoro.

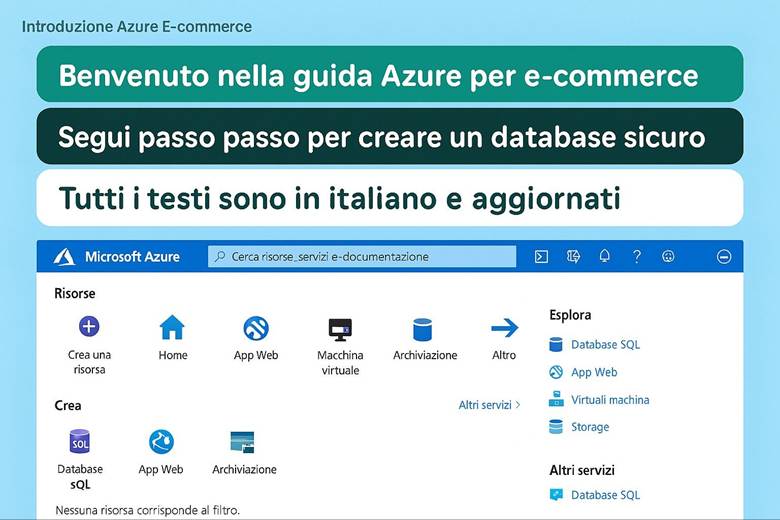

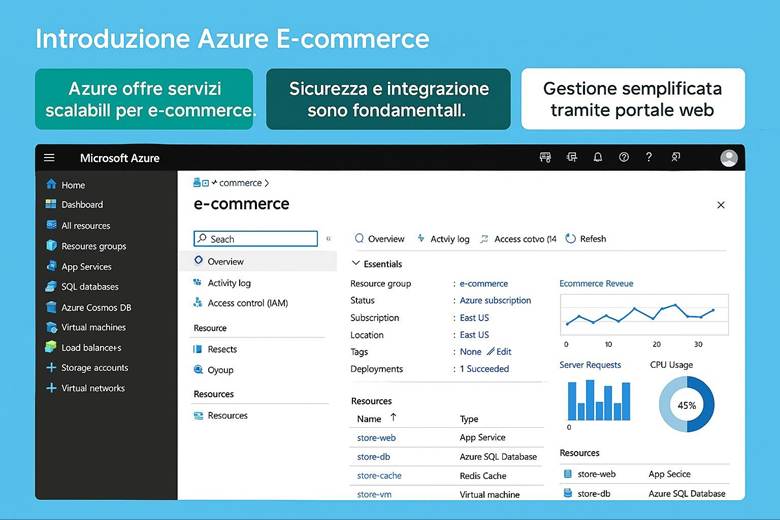

PROGETTO FINALE – Realizzazione di un e-commerce. Breve illustrazione

Non c’è cosa migliore di iniziare a studiare un argomento come questo avendo in mente di poterci realizzare qualcosa che ci piace e che ci può essere utile sul lavoro o per trovare lavoro. Questo ebook su Microsoft Azure è stato pensato proprio con questa filosofia: imparare gli strumenti e i servizi per poi metterli in pratica in un progetto concreto.

Nell’ultimo capitolo troverai il progetto finale, che consiste nella realizzazione di un e-commerce sfruttando tutto ciò che hai appreso. Non si tratta di teoria astratta, ma di passaggi operativi chiari, corredati da immagini esplicative per guidarti passo passo.

Gli step fondamentali che affronterai sono:

1. Crea le scatole: organizza le risorse con Management Groups e Resource Groups.

2. Dai nomi e tag: applica una struttura logica e facilmente gestibile.

3. Metti regole di sicurezza: configura Entra ID e Multi-Factor Authentication (MFA).

4. Crea il Key Vault: proteggi le chiavi e i segreti.

5. Attiva Defender for Cloud: aumenta la sicurezza del tuo ambiente.

6. Configura le reti: realizza l’architettura hub e spoke e collega tutto.

7. Crea lo Storage: archivia le immagini del tuo e-commerce.

8. Imposta il Database SQL: gestisci i dati dei prodotti e degli ordini.

9. Crea l’App Service: ospita il sito web del tuo e-commerce.

10. Aggiungi VM se serve: per esigenze particolari di calcolo.

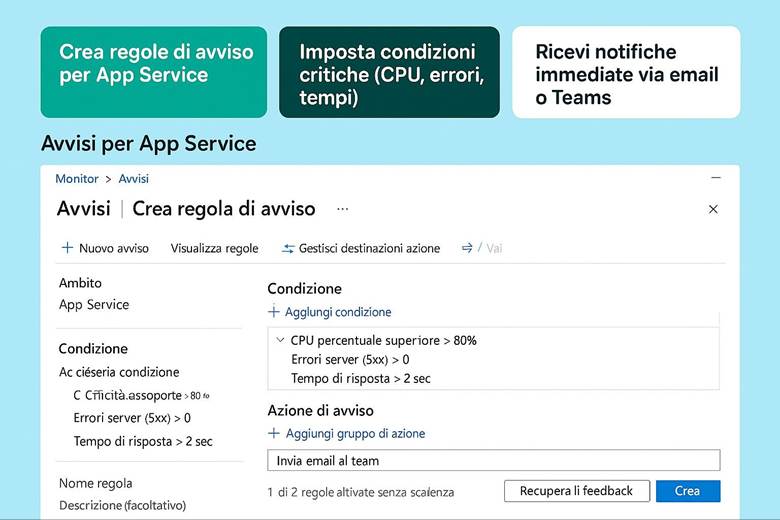

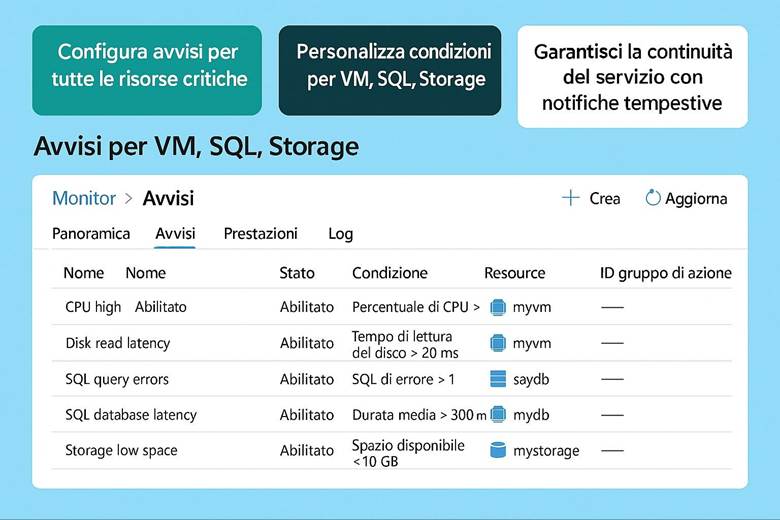

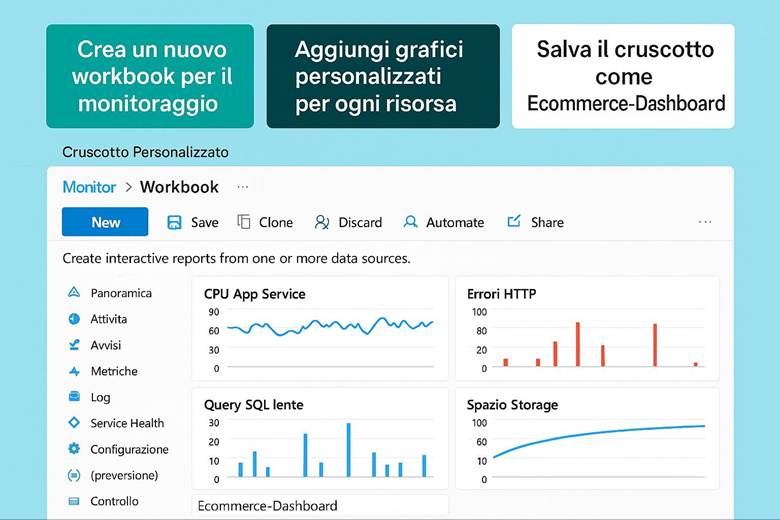

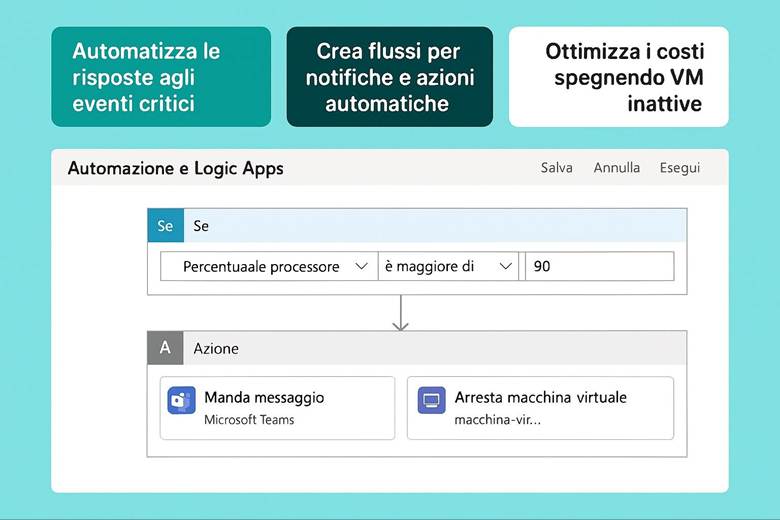

11. Attiva Monitor e alert: controlla lo stato e ricevi notifiche.

12. Controlla i costi: ottimizza il budget e mantieni la spesa sotto controllo.

Questo percorso ti permetterà di applicare concretamente le competenze acquisite, trasformando la teoria in un progetto reale e utile. Alla fine, non avrai solo imparato Azure: avrai creato un e-commerce funzionante, pronto per essere utilizzato o presentato come portfolio professionale.

CAPITOLO 1 – Panoramica Generale

Introduzione generale su Azure

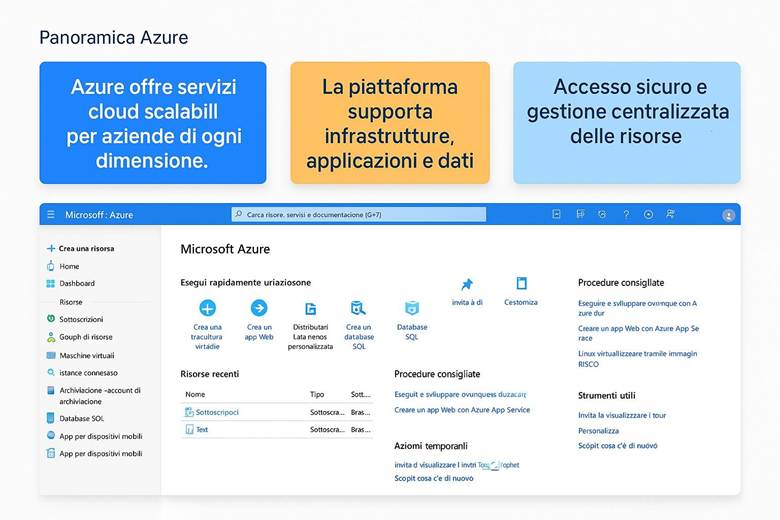

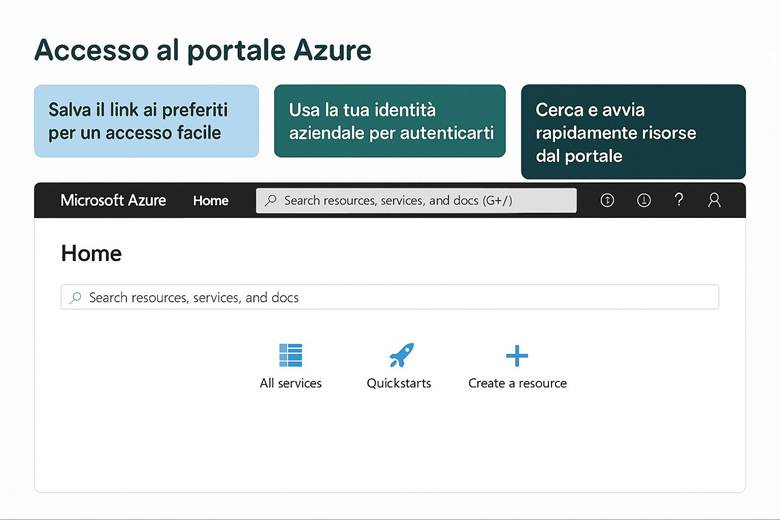

Che cos’è Azure? Microsoft Azure è la piattaforma di cloud computing di Microsoft che offre un insieme vasto di servizi on-demand nel campo del calcolo, dell’archiviazione dati, del networking, della sicurezza e della gestione. Tramite il portale Azure (un’interfaccia web unificata) è possibile distribuire risorse, configurarle e monitorarle centralmente. Rispetto ai data center tradizionali on-premises, Azure garantisce scalabilità elastica (le risorse possono crescere o diminuire in base alle esigenze), alta disponibilità (infrastruttura ridondata globalmente) e modelli di costo flessibili (pagamento in base al consumo, abbonamenti, piani risparmio). In sostanza, Azure consente alle aziende di concentrarsi sullo sviluppo e la gestione delle applicazioni senza preoccuparsi dell’acquisto e manutenzione dell’hardware sottostante.

Pilastri principali di Azure: I servizi di Azure sono organizzati in varie categorie fondamentali (a volte chiamati pilastri). Di seguito i principali pilastri con alcuni esempi di servizi inclusi in ciascuno:

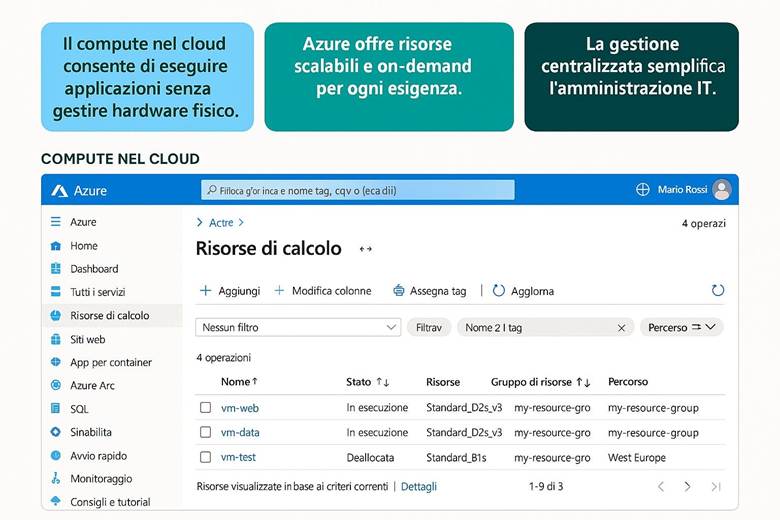

· Compute (Calcolo) – Servizi per eseguire carichi di lavoro: macchine virtuali, container (es. Azure Kubernetes Service), e funzioni serverless (Azure Functions).

· Storage (Archiviazione) – Servizi di archiviazione dati: oggetti (Blob Storage), file (Azure Files), code di messaggi (Queue Storage), tabelle NoSQL (Table Storage) e dischi gestiti per VM.

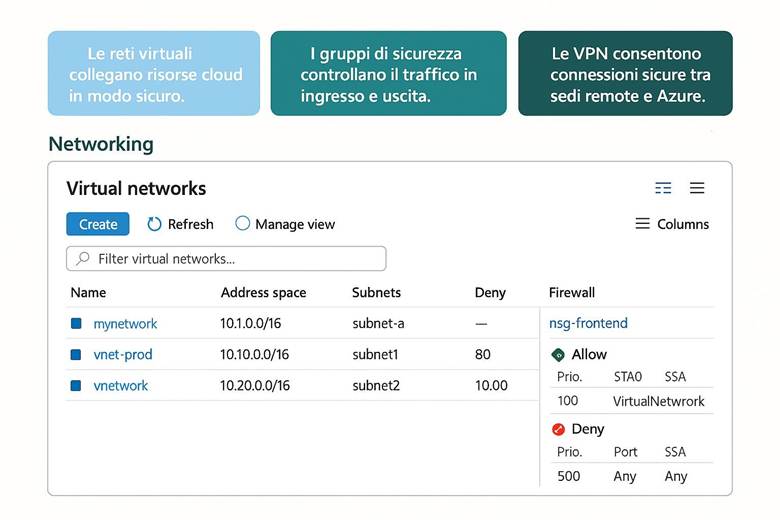

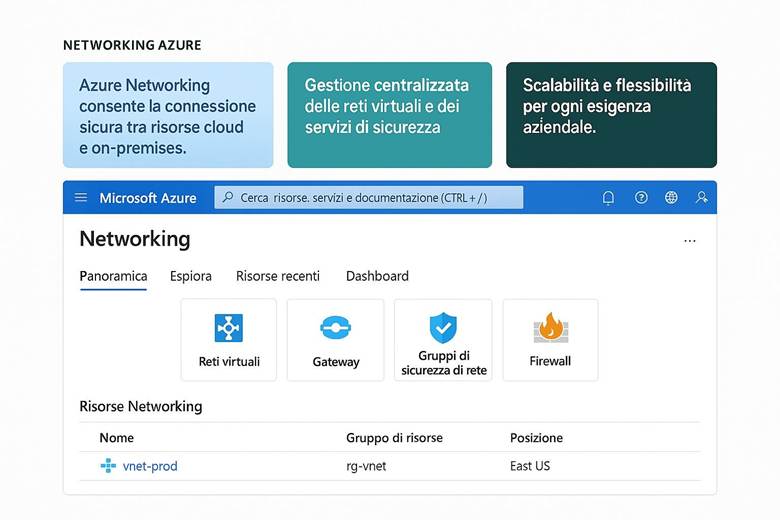

· Networking (Reti) – Servizi di rete: reti virtuali (VNet) per collegare risorse in cloud, bilanciatori di carico, connessioni ibride (VPN, ExpressRoute) per integrare con reti locali.

· Sicurezza e identità – Servizi per proteggere risorse e gestire identità: ad esempio Microsoft Defender for Cloud per la postura di sicurezza, Microsoft Entra ID (precedentemente Azure Active Directory) per l’autenticazione e l’autorizzazione, e Key Vault per la gestione di chiavi e segreti.

· Monitoraggio e governance – Strumenti per controllare e ottimizzare l’ambiente: Azure Monitor per raccogliere metriche e log, Azure Policy per l’applicazione di regole aziendali e Azure Advisor per raccomandazioni di ottimizzazione. Esempio pratico: Un’azienda intende pubblicare un portale di e-commerce in Azure senza doversi occupare dell’infrastruttura fisica. Può ad esempio distribuire un servizio App Service per ospitare l’applicazione web, utilizzare un Azure SQL Database gestito per i dati transazionali, archiviare le immagini dei prodotti su Blob Storage, proteggere l’ambiente con Defender for Cloud e monitorare prestazioni e costi tramite Azure Monitor e Cost Management. Tutto questo viene realizzato in Azure on-demand, evitando all’azienda di acquistare e gestire server fisici. Suggerimenti di visualizzazione: Per introdurre Azure e i suoi pilastri, si potrebbe utilizzare uno schema a blocchi che rappresenta i 5 pilastri principali (Compute, Storage, Networking, Security, Management) collegati tra loro da frecce. Questo diagramma mostrerebbe ad esempio il ciclo di vita di una soluzione cloud: deploy delle risorse → applicazione delle misure di sicurezza → monitoraggio continuo → ottimizzazione dei costi.

Inquadramento argomenti del capitolo con slides illustrate

Microsoft Azure è la piattaforma cloud di Microsoft che offre servizi di calcolo, archiviazione, rete, sicurezza e gestione per applicazioni e infrastrutture di qualsiasi dimensione. Dal portale Azure puoi distribuire, configurare e monitorare tutte le risorse. Rispetto ai datacenter tradizionali, Azure garantisce scalabilità elastica, alta disponibilità e modelli di costo flessibili. I cinque pilastri principali sono: Compute, Storage, Networking, Sicurezza e Identità, Monitoraggio e Governance. Per esempio, un’azienda può pubblicare un portale e-commerce usando App Service per il sito web, SQL Database gestito, archiviazione immagini in Blob Storage, protezione con Defender for Cloud e monitoraggio tramite Azure Monitor e Cost Management, senza acquistare hardware.

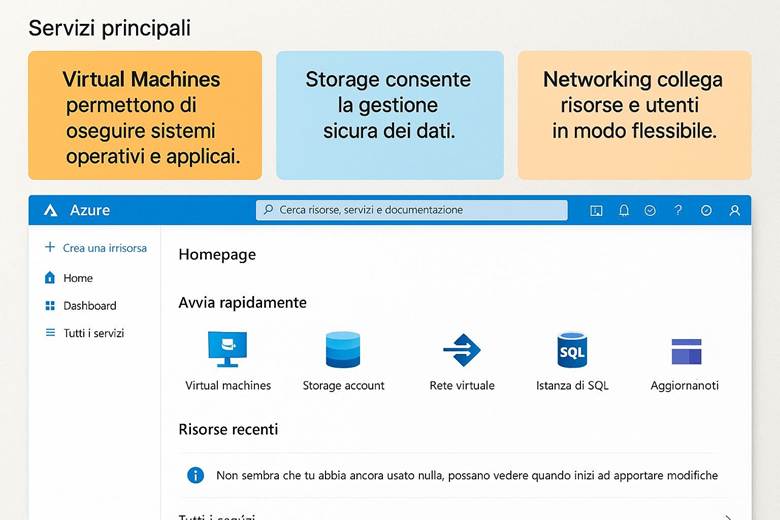

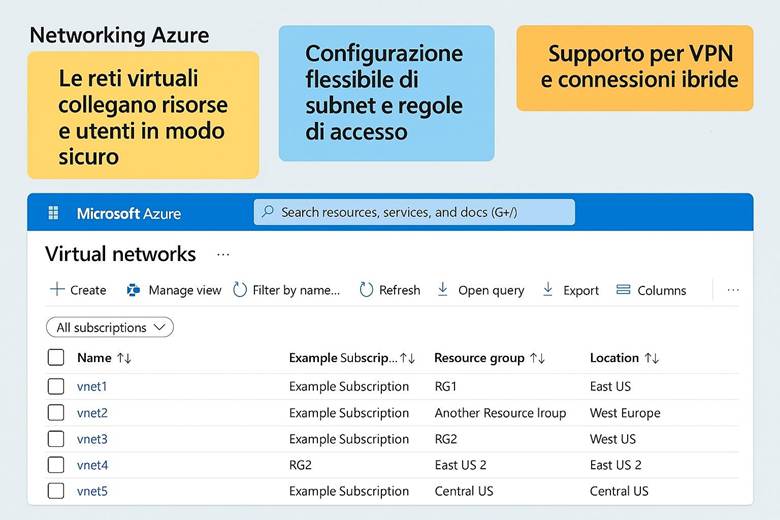

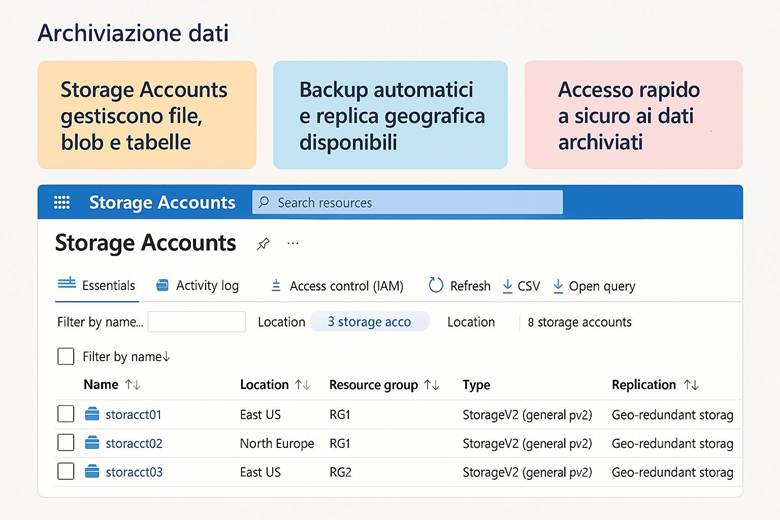

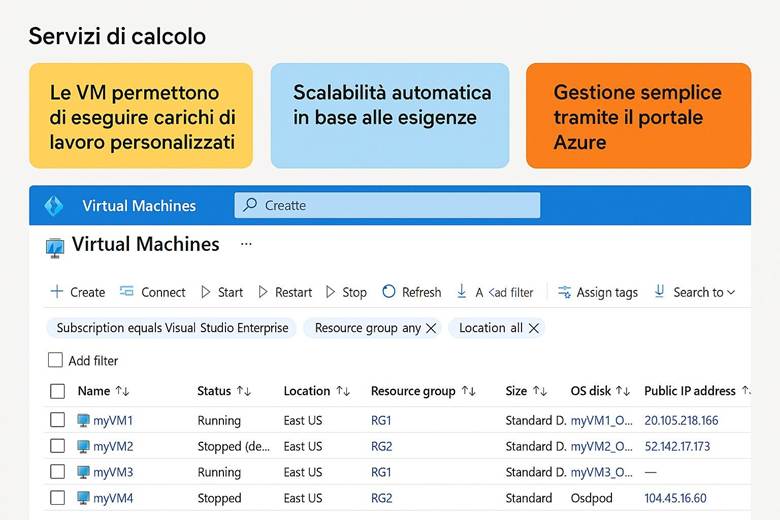

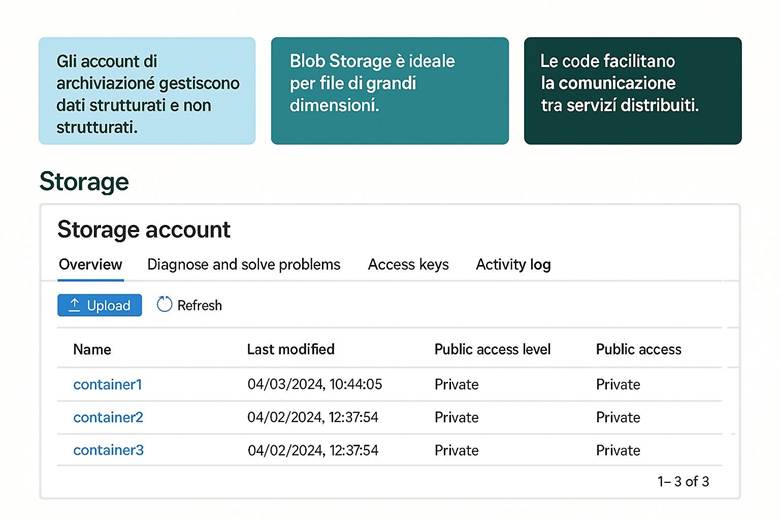

Le macchine virtuali di Azure offrono calcolo on-demand con controllo su sistema operativo, rete e storage, consentendo la scelta della dimensione in base al carico di lavoro e il pagamento solo delle risorse usate. Gli Storage Accounts forniscono uno spazio per Blob, Files, Queues e Tables, con cifratura, durabilità e scalabilità. Le Virtual Network sono essenziali per collegare in modo sicuro le risorse Azure tra loro, con Internet o ambienti on-premise, supportando subnet, filtri NSG e routing personalizzato. Un esempio pratico è un’app gestionale che usa VM Windows, Azure Files, VNet con subnet separate, NSG per regole di accesso e VPN Gateway per collegare la sede aziendale.

I Resource Group sono contenitori logici che raggruppano risorse correlate, facilitando il deploy, l’aggiornamento e la rimozione coordinata. Un naming coerente, il tagging per ambiente, servizio e dipartimento, e una gerarchia organizzata in Management Groups, Subscription, Resource Group e Resources, aiutano la governance e la gestione dei costi. Ad esempio, puoi separare le risorse con cicli di vita diversi, come un Resource Group per il front-end e uno per i dati, applicando RBAC differenziato.

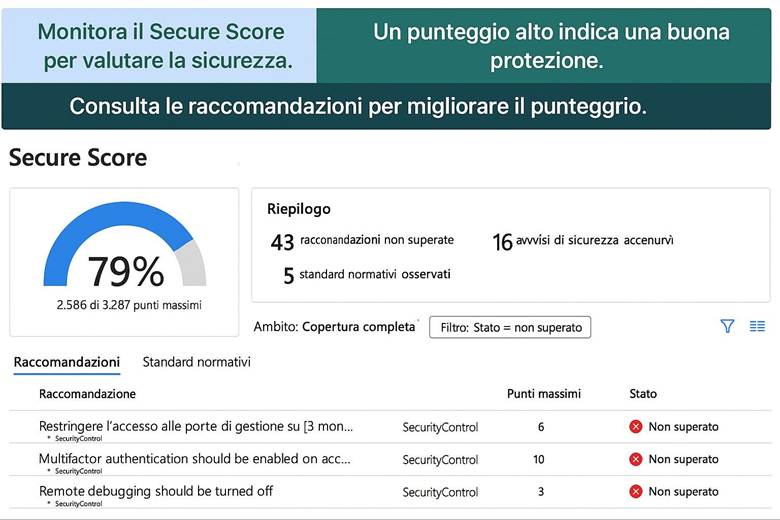

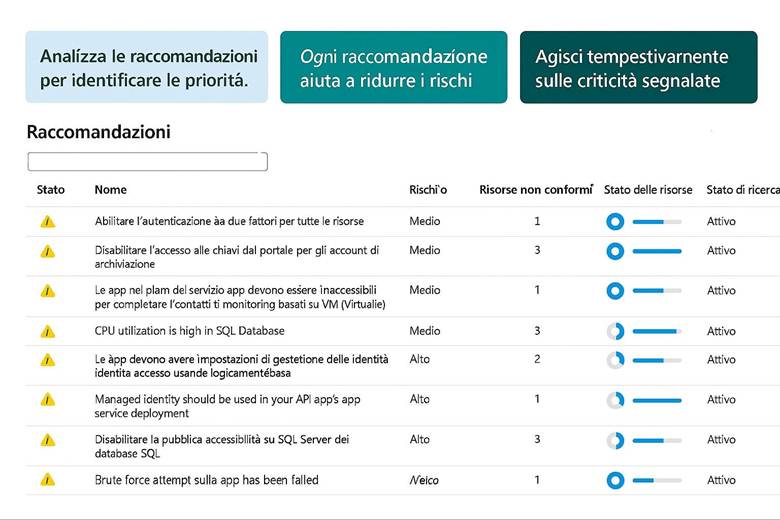

Microsoft Defender for Cloud è una piattaforma CNAPP che unifica la postura di sicurezza, DevSecOps e la protezione dei carichi di lavoro. Fornisce un Secure Score, raccomandazioni, alert e conformità regolatoria. Con Microsoft Entra ID puoi applicare RBAC e principi di Zero Trust, abilitando MFA e Conditional Access. I dati sono cifrati sia at-rest che in transito, e per la gestione di segreti e chiavi si usa Azure Key Vault. Un esempio: abilitare Defender for Servers su un Resource Group di produzione consente valutazioni, scanning agentless, raccomandazioni e integrazione con SIEM come Microsoft Sentinel.

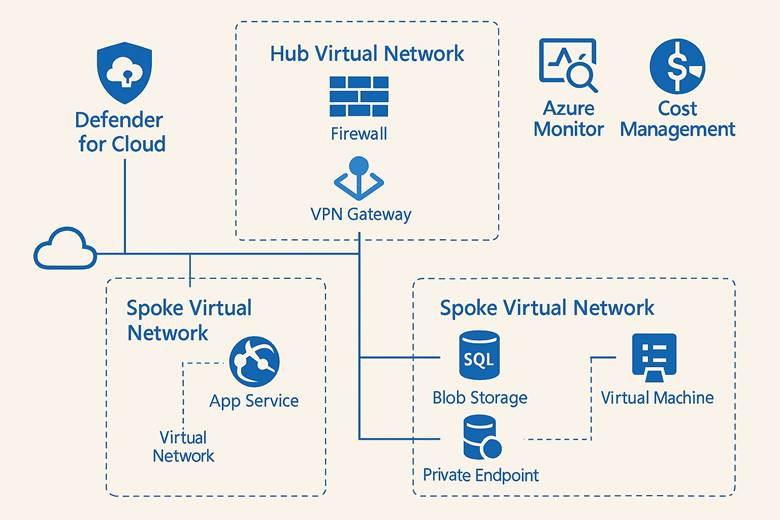

La progettazione della rete in Azure prevede subnet per separare livelli applicativi, NSG per filtrare il traffico, UDR per instradamento personalizzato e Private Link per accesso privato ai servizi PaaS. Per la connettività ibrida si utilizzano VPN Gateway o ExpressRoute, mentre il peering delle Virtual Network permette comunicazione sicura tra regioni. Azure Virtual Network Manager consente la gestione su larga scala tramite topologie hub-and-spoke e regole di sicurezza centralizzate. Un esempio pratico è un’architettura hub-and-spoke con firewall centrale, spoke dedicati e Private Endpoints verso servizi come Storage e SQL.

Azure offre diverse soluzioni di storage: Blob Storage per oggetti, Azure Files per condivisioni SMB o NFS, Queues per messaggistica, Tables per NoSQL semplice e Managed Disks per VM. Gli account GPv2 sono consigliati per la maggior parte degli scenari, mentre Premium offre prestazioni superiori. La ridondanza può essere configurata come LRS, ZRS, GZRS, o RA-GZRS in base alle esigenze. La sicurezza è garantita da cifratura automatica e autorizzazioni granulari tramite Microsoft Entra ID; l’accesso privato avviene tramite Private Endpoints. Un repository immagini può essere configurato con GPv2, ridondanza geografica e policy di lifecycle per ottimizzare costi e prestazioni.

Le VM di Azure sono ideali per applicazioni che richiedono controllo sull’OS o compatibilità con software legacy. Puoi scegliere tra diverse famiglie di VM per ottimizzare risorse e costi, e aumentare la disponibilità tramite Availability Zones o Scale Sets. I costi si riducono con Reserved Instances e Savings Plans, mentre le Spot VMs sono adatte per lavori non critici. Un ambiente CAD, ad esempio, può essere realizzato con NVads v5, dischi Premium SSD, VNet dedicata, accesso sicuro tramite Azure Bastion e monitoraggio completo.

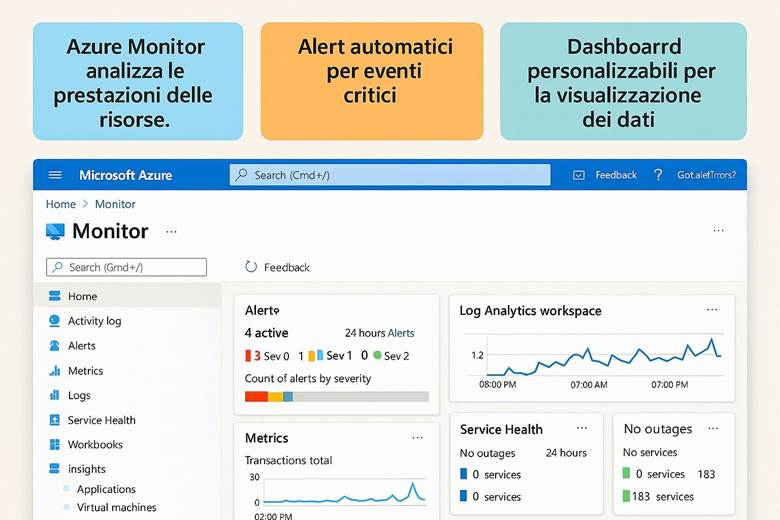

Azure Monitor raccoglie metriche, log e traces da risorse Azure, cloud esterne e on-premise, offrendo visualizzazioni avanzate, alert e automazione. Strumenti come VM Insights, Container Insights e Network Insights facilitano l’analisi delle prestazioni. Puoi configurare Data Collection Rules per inviare log a Log Analytics, impostare alert su soglie critiche e utilizzare workbook per monitorare SLA e tempi di risposta.

Azure Monitor raccoglie metriche, log e traces da risorse Azure, cloud esterne e on-premise, offrendo visualizzazioni avanzate, alert e automazione. Strumenti come VM Insights, Container Insights e Network Insights facilitano l’analisi delle prestazioni. Puoi configurare Data Collection Rules per inviare log a Log Analytics, impostare alert su soglie critiche e utilizzare workbook per monitorare SLA e tempi di risposta.

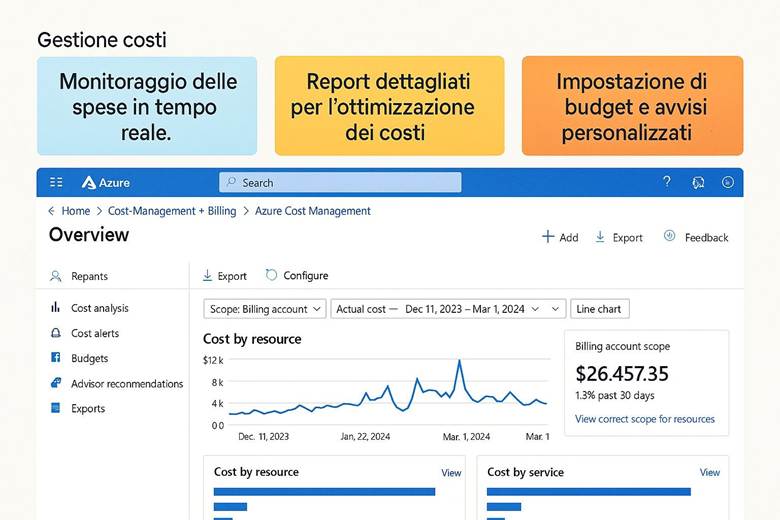

Con Cost Management + Billing puoi analizzare, monitorare e ottimizzare la spesa cloud. È possibile creare budget con alert specifici, visualizzare analisi per risorsa o tag, impostare split dei costi e sfruttare reservations e savings plans. Le best practice includono l’uso di scope e tag, la sorveglianza delle anomalie e il reporting periodico. Un esempio: impostare un budget mensile, ricevere alert all’80% e al 100%, monitorare i costi per servizio e seguire le raccomandazioni di Advisor per ottimizzare le risorse.

1. Servizi principali di Azure – Compute, Storage, Networking

Azure offre tre categorie di servizi cloud fondamentali – calcolo, archiviazione e rete – che costituiscono la base per qualsiasi progetto nel cloud. In questo capitolo esamineremo ciascuna di queste categorie, descrivendone i servizi principali e il loro ruolo.

Compute – Virtual Machines: Le macchine virtuali (VM) di Azure forniscono capacità di calcolo on-demand nel cloud con pieno controllo su sistema operativo, configurazione di rete e storage associato. È possibile scegliere dimensioni e tipi di VM in base alle necessità del carico di lavoro: ad esempio VM General Purpose bilanciate, VM ottimizzate per memoria o per calcolo, oppure VM con GPU per scenari di intelligenza artificiale o rendering grafico intensivo. Le risorse allocate (CPU, RAM, spazio disco) vengono tariffate secondo un modello pay-as-you-go, ovvero in base al consumo effettivo (con fatturazione oraria/minutaria delle VM attive). Azure fornisce inoltre opzioni per scalare il computo in modo elastico: si possono aggiungere o rimuovere VM manualmente, oppure usare servizi gestiti come Virtual Machine Scale Sets per scalare automaticamente in base a regole. (Fonte: Panoramica di Azure Virtual Machines).

Storage – Account di archiviazione: Un Storage Account di Azure offre un namespace unico nel cloud per diversi servizi di archiviazione: Blob (oggetti), File (condivisioni file SMB/NFS), Queue (messaggistica tra componenti) e Table (archivio NoSQL). Tutti i dati archiviati in Azure Storage sono ridondati e cifrati in modo trasparente per garantire durabilità e sicurezza. Gli account di archiviazione più comuni sono di tipo General-purpose v2 (GPv2), adatti alla maggior parte degli scenari, mentre esistono account Premium ottimizzati per prestazioni elevate e bassa latenza (ad esempio per dischi SSD ultra o file share con IO elevato). Quando si crea un account, è possibile scegliere il livello di ridondanza dei dati (LRS, ZRS, GZRS o RA-GZRS) in base ai requisiti di durabilità e continuità operativa: queste opzioni saranno descritte in dettaglio in un capitolo successivo. È inoltre possibile impostare regole di accesso (ad esempio limitando l’accesso di rete tramite firewall o Private Endpoints). (Fonti: Introduzione ad Azure Storage, Panoramica degli account di archiviazione).

Networking – Rete virtuale (VNet): La Azure Virtual Network (VNet) è il componente base per realizzare reti in Azure. Una VNet consente di collegare in modo sicuro le risorse cloud tra loro, di definire segmenti di rete isolati (subnet) e di controllare il traffico in entrata e uscita attraverso regole del Network Security Group (NSG). Con le VNet si possono inoltre stabilire connessioni con l’esterno: accesso a Internet per le risorse che lo richiedono, peering tra VNet in region diverse, oppure connessioni ibride con la rete on-premises dell’azienda tramite gateway VPN IPSec o collegamenti dedicati ExpressRoute. Le VNet supportano la personalizzazione del routing (User-Defined Routes) e l’integrazione con servizi PaaS tramite Azure Private Link (che consente di accedere ai servizi Azure PaaS attraverso endpoint privati nella VNet, evitando il traffico via Internet). Questo garantisce che il networking in Azure sia flessibile e sicuro, permettendo architetture sia completamente cloud sia ibride. (Fonte: Che cos’è una Rete Virtuale di Azure?)

Esempio pratico: Consideriamo un’applicazione gestionale classica da migrare in Azure. Si può creare una VM Windows in Azure per eseguire l’applicazione legacy, utilizzare Azure Files per spostare nel cloud le condivisioni di file SMB utilizzate dall’app, e configurare una VNet con due subnet separate (ad esempio una subnet per l’applicazione ed una per il database). Le regole di un NSG assicurano che solo l’applicazione possa comunicare col database, innalzando la sicurezza. Infine, per connettere l’ambiente cloud con la sede centrale dell’azienda, si può impostare un VPN Gateway che estende la rete locale alla VNet Azure. In questo modo l’applicativo sul cloud può comunicare con i sistemi ancora presenti on-premises in maniera protetta e trasparente agli utenti.

Suggerimenti visivi: Per rappresentare questi tre servizi principali (Compute, Storage, Networking) e le loro interazioni, si potrebbe mostrare un diagramma a triangolo in cui ogni vertice rappresenta uno dei pilastri (ad esempio un’icona di una VM, un’icona di storage e un’icona di rete). Tra questi, frecce e didascalie potrebbero evidenziare come elaborazione, dati e connettività collaborano nelle soluzioni Azure, sottolineando concetti chiave come la sicurezza integrata, la scalabilità e il modello pay-as-you-go.

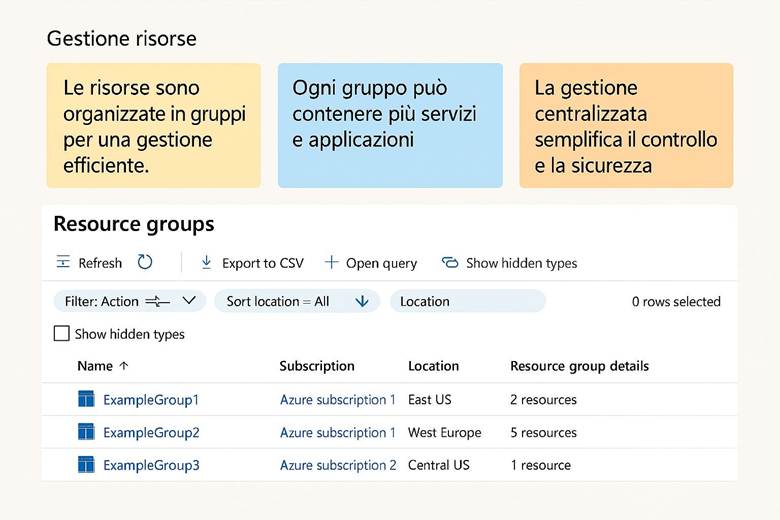

2. Organizzazione e gestione delle risorse con i Resource Groups

Un elemento fondamentale della gestione delle risorse in Azure è il concetto di Resource Group (RG). Un Resource Group è essenzialmente un contenitore logico in cui inserire risorse Azure correlate, in modo da gestirle come un’unità coesa durante tutto il loro ciclo di vita. Ad esempio, si possono raggruppare in un unico RG tutti i componenti di una stessa applicazione (VM, database, account di storage, funzionalità di rete, ecc.), facilitando operazioni come il deployment ripetuto, l’applicazione di politiche di accesso o la rimozione completa dell’ambiente.

Cos’è un Resource Group: In pratica, un RG raggruppa risorse che condividono uno stesso ciclo di vita e spesso uno stesso scopo applicativo. Le risorse all’interno di un RG possono essere gestite in maniera coordinata: ad esempio, eliminando un RG si eliminano tutte le risorse in esso contenute. Inoltre, i Resource Group costituiscono un confine per controllo degli accessi (possiamo assegnare permessi RBAC su un intero gruppo di risorse) e per l’applicazione di tag (etichette chiave-valore utili per categorizzare risorse per reparto, ambiente, progetto, ecc.). I Resource Group risiedono all’interno di Subscription Azure, e a loro volta le subscription possono essere organizzate in Management Groups per strutturare la governance su scala enterprise. Questa gerarchia (Management Groups → Subscription → Resource Groups → Resources) aiuta a separare ambiti amministrativi, costi e politiche di sicurezza a diversi livelli. (Fonte: Cloud Adoption Framework – Organize resources)

Buone pratiche nella gestione dei RG: Quando si progetta la suddivisione delle risorse in Resource Group, è consigliabile seguire alcune best practice per mantenere ordine e coerenza nell’ambiente cloud:

· Naming consistente: Dare ai Resource Group (e alle risorse) nomi standardizzati e comprensibili. Ad esempio, un convenzione potrebbe essere <prefisso>-<app>-<env>-<regione>-<sequenza>, risultando in nomi come rg-app-prod-euw-01. Un naming solido aiuta a identificare rapidamente scopo e ubicazione di un RG.

· Uso dei Tag: Assegnare tag a ogni RG (e risorsa) per indicare metadati utili come l’ambiente (env: produzione/test), il servizio o progetto (app: ecommerce), il dipartimento proprietario (dept: marketing) e la regione (region: West Europe). I tag facilitano filtraggio, reportistica dei costi e applicazione di politiche.

· Struttura gerarchica: Organizzare le risorse seguendo la gerarchia di Azure: Management Groups per raggruppare più sottoscrizioni aziendali; Subscriptions separate ad esempio per ambienti (prod, test) o per business unit; all’interno delle subscription creare RG per ciascun sistema/progetto. Questa separazione consente di applicare controlli di governance e budget a livelli differenti (es: policy a livello di management group; limiti di spesa a livello di subscription; RBAC specifico sui RG). (Fonti: Organize resources – naming e tagging) Esempio pratico: Si consideri un’azienda che ha un’applicazione web e un database. Una buona organizzazione potrebbe prevedere due Resource Group distinti: uno per la parte applicativa front-end (es. RG "app-web") che contiene le risorse aggiornate più frequentemente, come l’app service o le VM web, e un altro per la parte dati (es. RG "data-platform") che ospita il database e archivi blob, i quali tipicamente hanno cicli di aggiornamento diversi. In questo modo si possono applicare politiche di controllo degli accessi differenti: ad esempio, il team di sviluppo web avrà permessi completi sul RG dell’app, mentre l’accesso al RG dei dati sarà ristretto agli amministratori di database. Anche il versionamento e la rimozione delle risorse risultano semplificati, potendo agire sui RG separatamente a seconda delle esigenze. Suggerimenti visivi: Per illustrare l’organizzazione tramite Resource Group, è utile uno schema gerarchico che mostri i diversi livelli: ad esempio un diagramma a piramide con in cima i Management Groups, poi le Subscription, sotto ciascuna vari RG e infine le risorse specifiche dentro ogni RG. Inoltre, si potrebbe includere un esempio di tabella di tagging che elenca alcuni Resource Group con relativi tag chiave (come env, dept, owner, ecc.), evidenziando come i tag vengono applicati per classificare le risorse.

3. Sicurezza in Azure – Postura, Identità e Protezione dei Dati

La sicurezza è un aspetto cruciale del cloud Azure: Microsoft fornisce una serie di servizi integrati per proteggere le risorse cloud, gestire le identità degli utenti e salvaguardare i dati, il tutto in linea con principi di Zero Trust e conformità aziendale. In questo capitolo vedremo come Azure affronta la sicurezza su più fronti: monitoraggio della postura di sicurezza, gestione degli accessi e protezione dei dati.

Microsoft Defender for Cloud: È la piattaforma unificata di sicurezza nativa di Azure, classificata come una soluzione CNAPP (Cloud-Native Application Protection Platform). Defender for Cloud include funzionalità di CSPM (Cloud Security Posture Management) per valutare la postura di sicurezza dell’ambiente Azure e di CWPP (Cloud Workload Protection Platform) per offrire protezione attiva dei carichi di lavoro come VM, container, storage e database. Questo servizio fornisce una Secure Score che sintetizza il livello di sicurezza delle risorse, presenta raccomandazioni su configurazioni da migliorare e genera allarmi in caso di rilevamento di minacce o anomalie. Inoltre, consente di verificare la conformità a standard regolamentari o best practice tramite assessment continui. In pratica, abilitando Defender for Cloud su una sottoscrizione Azure si ottiene una vista centralizzata dello stato di sicurezza e protezione di tutte le risorse, con suggerimenti proattivi per ridurre la superficie di attacco (ad esempio macchine virtuali senza patch, account di storage con accesso pubblico, ecc.). (Fonti: Panoramica Microsoft Defender for Cloud, Documentazione Defender for Cloud)

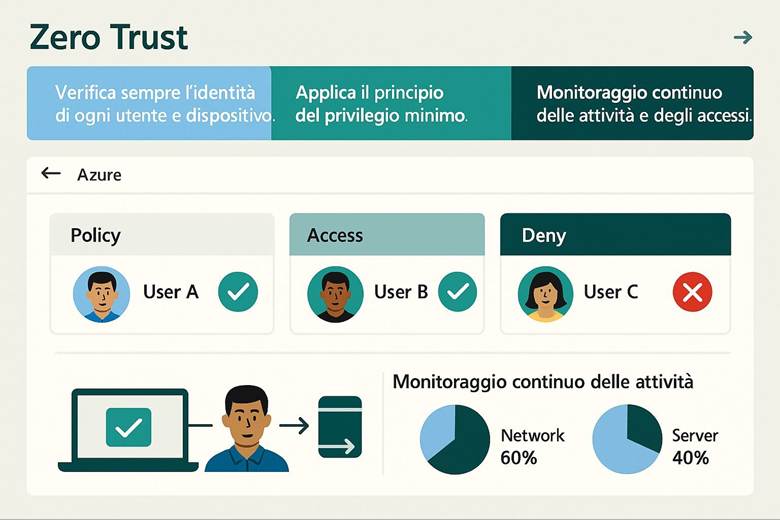

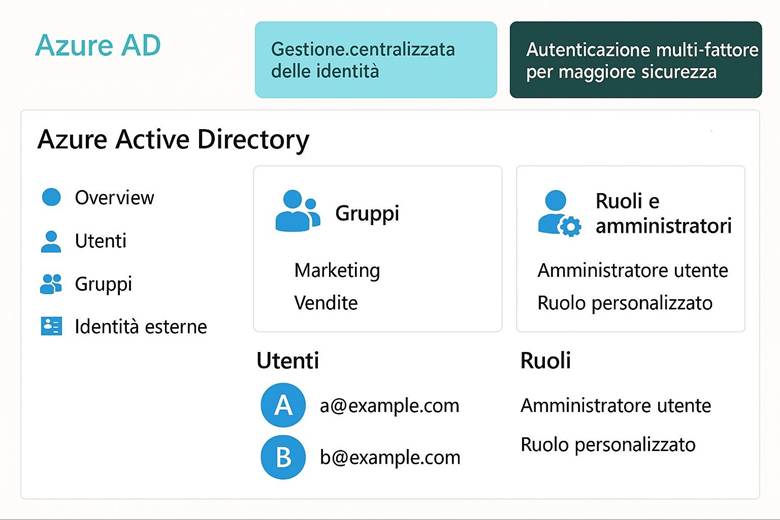

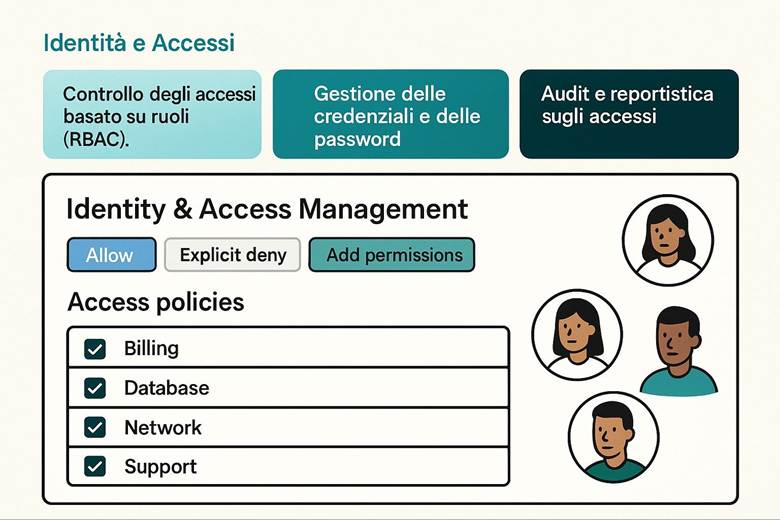

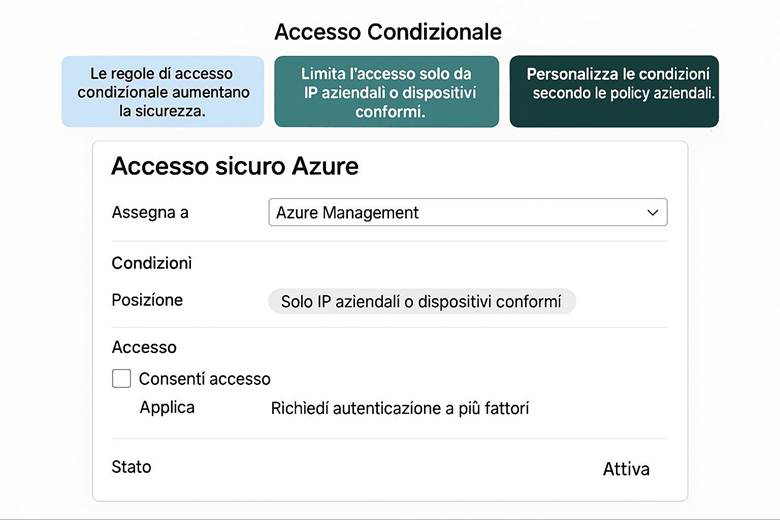

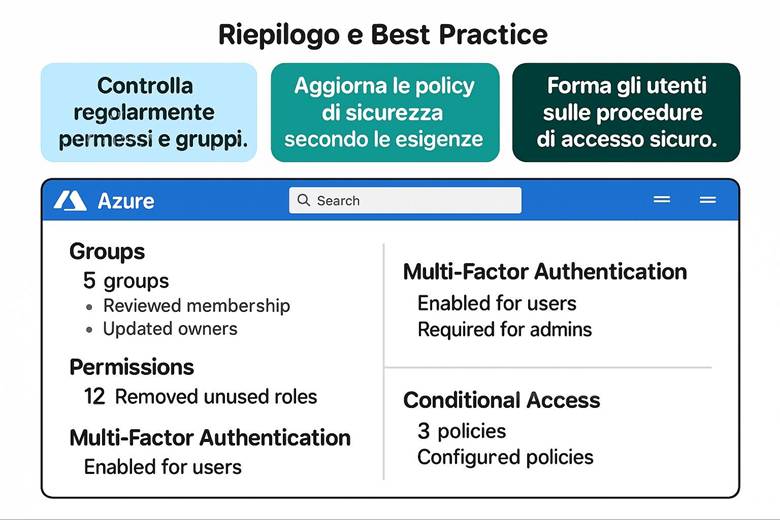

Identità e controllo di accesso: Azure delega la gestione delle identità a Microsoft Entra ID, precedentemente noto come Azure Active Directory. Entra ID gestisce l’autenticazione degli utenti e delle entità di sicurezza e abilita il modello di accesso RBAC (Role-Based Access Control) sulle risorse Azure. Tramite RBAC si assegnano ruoli predefiniti o personalizzati agli utenti/gruppi, garantendo il principio del privilegio minimo. Azure consente di implementare principi di Zero Trust, ad esempio richiedendo MFA (Multi-Factor Authentication) per gli accessi e applicando condizioni tramite Conditional Access (politiche che permettono l’accesso alle risorse solo se certe condizioni sono soddisfatte, come posizione di rete o dispositivo conforme). Oltre a ciò, Azure supporta l’integrazione con identità esterne e la federazione, in modo che gli utenti possano usare le proprie credenziali aziendali o social per accedere alle app Azure, mantenendo un controllo centralizzato. (Fonte: Documentazione sicurezza di Azure – Identità e Zero Trust)

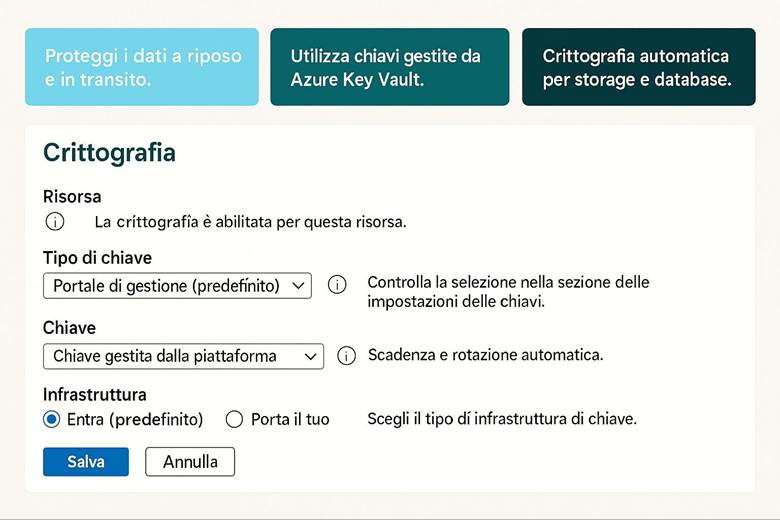

Protezione dei dati: Per tutelare i dati ospitati in Azure, la piattaforma implementa cifratura dei dati a riposo e in transito. Ciò significa che i servizi di archiviazione (dischi, file, database, ecc.) criptano automaticamente il contenuto salvato su disco (data at rest) usando chiavi gestite da Microsoft o, a scelta, chiavi gestite dal cliente tramite Azure Key Vault. Analogamente, le comunicazioni verso e tra i servizi Azure avvengono su canali crittografati (HTTPS/TLS) garantendo la protezione in transit. Azure Key Vault è il servizio dedicato alla gestione centralizzata di chiavi crittografiche, segreti e certificati utilizzati dalle applicazioni: le chiavi possono essere utilizzate per cifrare dati applicativi oppure per gestire la crittografia dei dischi (Azure Disk Encryption) e dei workspace di Log Analytics, mentre i segreti (come stringhe di connessione, password) possono essere richiamati in sicurezza dalle applicazioni runtime. Queste misure assicurano che solo utenti e applicazioni autorizzate possano accedere ai dati sensibili e mitigano i rischi in caso di accessi non autorizzati o compromissioni di account. (Fonte: Azure security documentation)

Esempio pratico: Un caso di utilizzo potrebbe essere l’abilitazione di Defender for Cloud su tutti i Resource Group di produzione di un’azienda. Una volta abilitato, Defender esegue la valutazione automatica delle configurazioni (ad esempio controlla che le porte delle VM esposte ad Internet siano protette da NSG, che gli storage account non abbiano contenitori pubblici, ecc.) e avvia anche uno scansione agentless delle VM alla ricerca di vulnerabilità note. Supponiamo che rilevi delle macchine virtuali non aggiornate: la piattaforma fornirà raccomandazioni su come risolvere (ad esempio “Applica le ultime patch di sicurezza”). Inoltre, se abilitiamo anche l’integrazione con un SIEM come Microsoft Sentinel, eventuali allarmi critici (es. tentativi di intrusione, esfiltrazione di dati) vengono inviati a Sentinel per consentire analisi e risposta centralizzate. In parallelo, per l’accesso degli utenti, l’azienda implementa MFA obbligatoria per tutti gli account con privilegi elevati e definisce policy di Conditional Access per limitare, ad esempio, l’accesso al portale Azure solo da reti aziendali o dispositivi conformi. Con queste configurazioni, l’ambiente Azure dell’azienda è protetto su più livelli: configurazioni sicure di base, monitoraggio continuo delle minacce e controlli di accesso stringenti.

Suggerimenti visivi: Per rappresentare la sicurezza in Azure si potrebbe utilizzare un cruscotto di sicurezza come immagine esplicativa. Ad esempio, un dashboard che mostri la Secure Score globale, il numero di raccomandazioni aperte vs risolte, e una panoramica grafica delle risorse coperte da Defender (magari una mappa dell’infrastruttura evidenziando quali risorse hanno allarmi di sicurezza). Un altro elemento grafico potrebbe essere uno schema di Zero Trust, con un flusso che parte dall’utente (a cui viene applicata MFA) e attraversa controlli di Conditional Access prima di arrivare alle risorse interne.

4. Reti in Azure – Connettività sicura e flessibile

Le funzionalità di networking in Azure permettono di costruire infrastrutture di rete complesse e sicure, analoghe a quelle on-premises, ma con la flessibilità tipica del cloud. Azure fornisce strumenti per segmentare il traffico, collegare ambienti differenti e gestire la rete su larga scala. Vediamo alcuni aspetti chiave del networking Azure.

Virtual Network e segmentazione: Come accennato in precedenza, Azure Virtual Network (VNet) consente di creare reti private in Azure in cui posizionare le risorse. All’interno di una VNet, suddividere la rete in subnet aiuta a isolare i diversi livelli applicativi – ad esempio una subnet per i server web, una per i server applicativi e una per i database. A ciascuna subnet si possono associare NSG (Network Security Group) che agiscono come firewall sulle porte e sugli IP: ad esempio, un NSG può permettere accesso HTTP/HTTPS solo alla subnet web e bloccare qualsiasi traffico non autorizzato verso il database. Per controllare il routing del traffico, Azure consente anche route definite dall’utente (UDR), utili ad esempio per instradare il traffico attraverso appliance di rete come firewall di terze parti. Infine, tramite Private Link, si possono mappare servizi PaaS (come Azure SQL, Storage, ecc.) all’interno della VNet, ottenendo punti di accesso privati nel network e impedendo l’esposizione tramite IP pubblici. Tutto ciò permette di costruire architetture a più livelli con una segmentazione granulare della rete, migliorando sia la sicurezza sia la gestione del traffico. (Fonti: Panoramica di Azure Networking, Panoramica di Virtual Network)

Connettività ibrida e interconnessione: Molte organizzazioni necessitano di collegare l’ambiente Azure con ambienti esterni, come data center aziendali o altre cloud. Azure supporta questo con due principali soluzioni: VPN Gateway e Azure ExpressRoute. Il VPN Gateway crea un tunnel crittografato (IPsec) attraverso Internet tra la VNet Azure e la rete on-premises, offrendo una connessione sicura ma con latenza variabile a seconda di Internet. L’ExpressRoute invece fornisce un circuito dedicato (fornito da un provider telecom) tra l’infrastruttura on-premises e Azure, garantendo una connessione privata ad alta velocità e bassa latenza, ideale per integrazioni strette e trasferimenti di dati ingenti. All’interno di Azure, è possibile collegare tra loro più Virtual Network tramite VNet Peering, anche se si trovano in region differenti, creando di fatto una rete interconnessa globale. Questo consente, ad esempio, a servizi in diverse region geografiche di comunicare tra loro su rete Azure privata senza passare da Internet. (Fonte: Azure Networking fundamentals)

Gestione del networking su larga scala: Quando si hanno decine di VNet e configurazioni di rete ripetitive, Azure fornisce servizi per semplificarne la gestione centralizzata. Azure Virtual Network Manager è uno strumento che consente di applicare configurazioni e policy di rete a più VNet in modo orchestrato. Ad esempio, con Virtual Network Manager si può definire una topologia hub-and-spoke a livello aziendale: nominare una rete hub centrale (dove posizionare servizi comuni come firewall, servizi di gestione, o un gateway verso on-prem) e collegare ad essa varie reti spoke (che ospitano applicazioni isolate per team o dipartimenti). Si possono definire regole di sicurezza amministrativa (Security Admin Rules) applicabili globalmente (ad esempio, vietare completamente traffico RDP/SSH in ingresso su tutte le VNet spoke a prescindere dalle impostazioni locali di NSG). Inoltre il VNet Manager può gestire la connettività tra le spoke, permettendo o negando il traffico in base a criteri centrali. Questo approccio facilita la consistenza delle configurazioni di rete in ambienti complessi e multi-regione. (Fonte: Azure Virtual Network Manager – Panoramica)

Esempio pratico: Un’architettura di rete cloud comune per una grande organizzazione è il modello hub-and-spoke. Si può implementare definendo una VNet di hub che contiene servizi condivisi come un Azure Firewall o Azure Front Door per la protezione perimetrale e l’esposizione di applicazioni web. Poi si creano più VNet di spoke, ad esempio una per l’applicazione finanziaria, una per il sistema di BI, ecc., ognuna isolata con le proprie subnet e NSG. Le spoke sono connesse all’hub tramite peering o tramite Virtual Network Manager, e l’hub è a sua volta collegato alla rete on-premises via VPN Gateway o ExpressRoute per consentire agli utenti aziendali di raggiungere i servizi cloud. Inoltre, dove necessario, sulle spoke si utilizzano Private Endpoints verso i servizi PaaS (ad esempio un database SQL gestito o un account Storage) per far sì che i dati viaggino solo all’interno della rete privata. Con questa configurazione, qualsiasi traffico tra on-premises e cloud o tra diverse spoke può essere controllato centralmente (passando dal firewall nell’hub), garantendo sia sicurezza sia ottimizzazione del routing.

Suggerimenti visivi: Una rappresentazione efficace per questo capitolo è un diagramma di rete che illustri la topologia hub-and-spoke. Nel diagramma l’hub centrale potrebbe essere evidenziato, collegato a diversi spoke, con simboli per il VPN Gateway e ExpressRoute che connettono l’hub all’esterno. Sulle connessioni potrebbero essere indicati i controlli di sicurezza (es. icona di firewall sull’hub, simboli di NSG sulle subnet delle spoke). Inoltre, si può evidenziare visivamente l’uso di Private Endpoint disegnando un servizio PaaS (es. un database) connesso a una subnet privata all’interno di una spoke, distinto da un ipotetico accesso via Internet (quest’ultimo sbarrato per indicare che non avviene). Questo aiuterebbe a capire come Azure permette una connettività ibrida e segmentata con controllo centralizzato.

5. Archiviazione dei dati – Tipi di account e ridondanza

La piattaforma Azure offre diverse soluzioni per l’archiviazione dei dati, ciascuna ottimizzata per scenari specifici. Inoltre, Azure Storage consente di configurare vari livelli di ridondanza per garantire la disponibilità e durabilità dei dati anche in caso di guasti. In questo capitolo analizzeremo i principali servizi di archiviazione e le opzioni di resilienza offerte.

Servizi di archiviazione dati in Azure: Un singolo account di archiviazione Azure può contenere differenti tipi di dati. I servizi di archiviazione principali sono i seguenti:

Blob Storage: Archivia oggetti non strutturati come documenti, immagini, video, backup o log. Fornisce storage scalabile a costi contenuti per una grande mole di dati accessibili via protocollo HTTP/HTTPS (ad esempio attraverso REST API). È ideale per contenuti statici di siti web, dati distribuiti tramite CDN, file di log e backup.

Azure Files: Offre condivisioni file accessibili tramite i protocolli SMB o NFS , rendendo possibile il lift-and-shift di applicazioni che utilizzano file system tradizionali. Si comporta come un file server gestito nel cloud, utile per condividere file tra VM o accedere a file da on-premises senza mantenere un file server locale.

Queue Storage: Fornisce code di messaggi persistenti utilizzate per la comunicazione tra componenti applicative in modo asincrono. È spesso impiegato in architetture decoupled dove un servizio mette messaggi in coda e un altro li elabora in seguito, garantendo affidabilità nello scambio di task o eventi.

Table Storage Offre un archivio NoSQL a bassa latenza per dati strutturati in forma di tabelle, con un modello chiave/attributo. È adatto per conserve grandi volumi di dati semi-strutturati (ad es. log, dataset di IoT) quando non è richiesta la complessità di un database relazionale.

Managed Disks: Fornisce dischi gestiti per le Macchine Virtuali. Si tratta di volumi virtuali (HDD o SSD) che possono essere collegati alle VM Azure come dischi di sistema o aggiuntivi. Azure gestisce automaticamente la resilienza di questi dischi e ne semplifica la scalabilità, offrendo vari tipi (Standard HDD, Standard SSD, Premium SSD, Ultra SSD) per diverse necessità di performance.

Nota: Tutti questi servizi di archiviazione beneficiano delle caratteristiche intrinseche di Azure Storage, come la cifratura automatica dei dati a riposo e l’integrazione con Microsoft Entra ID per il controllo degli accessi a livello di risorsa (ad esempio controlli di ACL sui file Azure Files, o SAS token e ruoli per l’accesso ai Blob). Inoltre, tramite la funzionalità di Private Endpoint, è possibile accedere a servizi come Blob Storage o Azure Files direttamente da una rete privata Azure (VNet) senza esporli su Internet, aumentando la sicurezza.

Tipi di account di archiviazione e prestazioni: I servizi elencati sopra risiedono in un account di archiviazione, e il tipo di account influenza alcune caratteristiche di performance e fatturazione. Gli account General Purpose v2 (GPv2) sono la scelta predefinita e supportano tutti i servizi (Blob, Files, Queue, Table, Disk) con una combinazione di costi e prestazioni adatta alla maggior parte degli scenari. Invece, gli account Premium sono progettati per scenari con requisiti di alta I/O e bassa latenza: essi utilizzano hardware SSD più performante e sono indicati ad esempio per carichi intensivi su file share o dischi di VM con elevato throughput e IOPS. Gli account Premium hanno costi più elevati e talvolta dimensioni massime inferiori, ma garantiscono prestazioni più costanti. È importante scegliere il tipo di account in base al workload: se dobbiamo supportare un sito di contenuti statici con picchi elevati di richieste, un account GPv2 con blob in hot tier potrebbe bastare; se invece abbiamo un database intensivo su disco, potrebbe servire un disco gestito Premium. (Fonte: Storage account overview)

Opzioni di ridondanza dei dati: Azure Storage offre diversi livelli di replica dei dati per proteggere dall’indisponibilità dovuta a guasti hardware o eventi catastrofici. Le opzioni disponibili, configurabili al momento della creazione dell’account (e modificabili successivamente in alcuni casi), sono:

LRS (Locally Redundant Storage): Replica locale (all’interno di un singolo data center o zona di disponibilità nella regione primaria). Mantiene 3 copie dei dati all’interno della stessa regione</i>. È l’opzione più economica, che protegge da guasti hardware locali (come il crash di un server o un rack) garantendo almeno 11 9’s di durabilità in un anno. Non protegge però da fail di intero data center o regione.

ZRS (Zone-Redundant Storage): Replica zonale (distribuita su più Availability Zone nella regione primaria). Mantiene 3 copie dei dati su data center/zones differenti all’interno della regione. Garantisce che anche se un’intera zona della regione diventa indisponibile (es. blackout in una zona), i dati rimangano accessibili tramite le copie in un’altra zona. Offre 12 9’s di durabilità annuale. Non copre i disastri regionali totali, ma riduce drasticamente il rischio di perdita in caso di problemi in un singolo edificio.

GZRS (Geo-Zone-Redundant Storage): Replica geografica con supporto zonale. Combina ZRS e replica geografica. Mantiene copie su più zone nella regione primaria e** in aggiunta effettua una replica asincrona in una **regione secondaria distante (nel paired region Azure). In totale i dati hanno 3 copie nella regione primaria e 1 (o più) copie nella regione secondaria. Protegge sia da guasti zonali sia dalla perdita dell’intera regione primaria, garantendo durabilità elevatissima (16 9’s). In caso di disastro che colpisce la regione primaria, i dati sono conservati nella regione secondaria (ma non immediatamente accessibili senza failover).

RA-GZRS (Read-Access GZRS): Replica geografica con accesso in lettura alla secondaria. Estende GZRS consentendo accesso in sola lettura alla replica nella regione secondaria in ogni momento. Ciò significa che, anche senza effettuare un failover, le applicazioni possono leggere</i> i dati dalla replica geografica se la regione primaria non è raggiungibile. È utile per scenari di alta disponibilità in lettura. (Analogamente esiste RA-GRS per la replica geo senza zones, ma GZRS ha di fatto sostituito GRS in molti scenari).

Scegliere la ridondanza: La scelta tra queste opzioni dipende dagli obiettivi di durabilità e disponibilità dell’applicazione. In generale, LRS è adatto per dati di cui esiste una copia di backup o che possono essere rigenerati facilmente; ZRS è indicato per applicazioni che richiedono alta disponibilità all’interno di una singola regione (es. sistemi critici dove la perdita di un data center non deve interrompere il servizio); GZRS/RA-GZRS vanno usati per assicurare continuità anche in caso di disastro regionale, ad esempio per dati mission-critical che devono sopravvivere anche a eventi estremi come terremoti o grandi blackout che colpiscano un’intera area geografica. (Fonte: Azure Storage redundancy options – Documentation)

Sicurezza e accesso ai dati: Oltre alla resilienza, Azure Storage offre vari meccanismi per proteggere l’accesso ai dati. Tutti i file e i blob sono cifrati automaticamente con chiavi gestite dal servizio (o con Customer-managed keys in Key Vault, se configurato). Per l’accesso, Azure consente di usare Azure AD/Entra ID per assegnare permessi granulari alle entità (ad esempio un ruolo predefinito “Storage Blob Data Reader” può permettere a un’applicazione di leggere solo i blob di un container). In alternativa o in aggiunta, sono disponibili strumenti come le SAS (Shared Access Signatures), token a tempo limitato che concedono diritti specifici su un oggetto (utile per dare accesso temporaneo a un cliente a un file, ad esempio). Infine, l’uso di reti private (VNet e firewall) garantisce che solo fonti autorizzate possano comunicare con l’account di storage, riducendo la superficie di attacco. (Approfondimenti: Azure Storage security guide – Microsoft Docs)

Esempio pratico: Immaginiamo di dover progettare un repository centralizzato per contenere le immagini dei prodotti di un sito di e-commerce, con requisiti di alta disponibilità e distribuzione globale. Potremmo creare un Storage Account GPv2 configurato con RA-GZRS in modo che ogni immagine caricata sia replicata sia in zona locale sia in una seconda regione geografica per sicurezza. Impostiamo inoltre una Azure Storage lifecycle policy per spostare automaticamente le immagini meno recenti su tier di accesso più freddi (ad es. da Hot a Cool e infine ad Archive) così da ridurre i costi di storage a lungo termine man mano che le immagini invecchiano e vengono consultate raramente. Per distribuire queste immagini agli utenti finali sparsi globalmente con latenze ridotte, potremmo sfruttare un CDN (Content Delivery Network) o Azure Front Door, che mette in cache il contenuto nelle POP server vicine ai clienti. In sintesi, con poche configurazioni abbiamo uno storage duraturo (grazie a RA-GZRS), efficiente in termini di costi (tiering automatico) e performante per gli utenti finali (tramite CDN).

Suggerimenti visivi: Per questo capitolo si prestano bene due rappresentazioni: (1) una tabella comparativa delle tipologie di storage (Blob, Files, etc.) con righe “caratteristiche” (ad esempio: tipo di dati, protocollo di accesso, scenari d’uso, prestazioni, limiti) per evidenziare le differenze e aiutare nella scelta del servizio giusto; (2) uno schema della ridondanza geografica: ad esempio una mappa stilizzata con due region Azure collegate, dove nella regione primaria i dati sono replicati su 3 zone (indicando LRS/ZRS) e poi replicati verso la regione secondaria. Accanto, icone di un occhio sbarrato vs aperto potrebbero indicare la differenza tra GZRS (replica ma senza accesso diretto) e RA-GZRS (replica con accesso in lettura nella secondaria). Questo aiuterebbe a visualizzare concretamente cosa succede ai dati in ognuna delle opzioni di ridondanza.

6. Servizi di calcolo – le Macchine Virtuali (VM) in dettaglio

Nel panorama dei servizi di Compute di Azure, le Virtual Machines occupano un ruolo centrale poiché offrono massima flessibilità e controllo. In questo capitolo approfondiremo quando e come utilizzare le VM, come garantirne disponibilità e prestazioni, e come gestirne i costi.

Quando usare le VM: Le macchine virtuali in Azure sono particolarmente indicate in quei scenari dove è necessario avere pieno controllo sull’ambiente operativo, oppure per esigenze di compatibilità con software specifici. Ad esempio, se si ha un’applicazione legacy che deve girare su un certo sistema operativo (Windows Server, Linux particolare) o con driver speciali, una VM permette di installare e configurare tutto come in un server fisico. Anche quando si necessita di configurazioni di rete o di storage molto particolari (ad esempio usando file system specifici, o connettendo interfacce di rete multiple in un modo personalizzato), le VM forniscono la flessibilità necessaria. In generale, uno Use case tipico per le VM è il lift-and-shift di workload esistenti dall’on-premises al cloud, senza doverli riprogettare: basta creare VM simili ai server originari e si mantengono compatibilità e funzionalità. Va tenuto presente però che, rispetto a servizi PaaS gestiti (come App Service per le web app o Azure SQL per i database), le VM richiedono più oneri gestionali (patch del sistema operativo, configurazione backup, etc.). (Fonte: Panoramica Macchine Virtuali Azure)

Scelta del tipo di VM e alta disponibilità: Azure offre un catalogo ampio di SKU di VM, raggruppate in serie caratterizzate da diverse risorse di calcolo. Ad esempio, la serie Dv3/Dv4 è bilanciata per usi generici, la serie Ev3/Ev4 ha memoria maggiorata per database o analytics in-memory, la F privilegia il numero di core CPU per calcoli intensivi, mentre le serie N includono GPU per machine learning o visualizzazioni 3D. Quando si crea una VM si deve scegliere dimensione (es. D2s_v3, E4s_v4, etc.) tenendo conto di vCPU, RAM, throughput disco e caratteristiche necessarie. Per garantire alta disponibilità, Azure consente distribuzione su Availability Options come Availability Set o Availability Zone. Con un Availability Set, multiple VM (ad esempio due VM che fanno parte di un cluster) vengono collocate in fault domain diversi all’interno dello stesso data center, in modo che la manutenzione o un guasto hardware non le colpisca entrambe contemporaneamente. Con le Availability Zone, invece, le VM replicate vengono posizionate in data center fisicamente separati (zone diverse) all’interno della stessa regione, aumentando ulteriormente la resilienza. Inoltre, per scenari di scalabilità automatica, le Virtual Machine Scale Sets permettono di gestire un insieme di VM identiche che possono aumentare o diminuire di numero secondo la domanda (ad esempio, aggiungendo VM quando il carico CPU medio supera un certo threshold). La scelta occulata della famiglia di VM e della strategia di disponibilità è fondamentale per bilanciare costi e SLA del servizio. (Fonti: Documentazione VM (Azure), Azure Architecture Center – VM best practices)

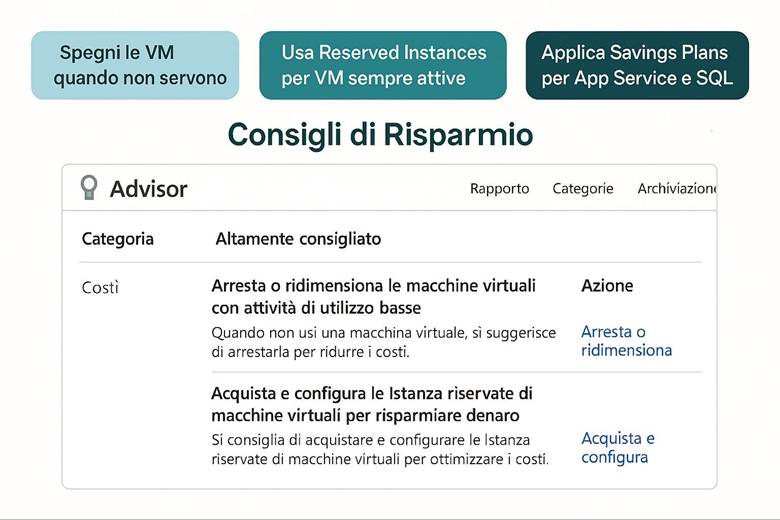

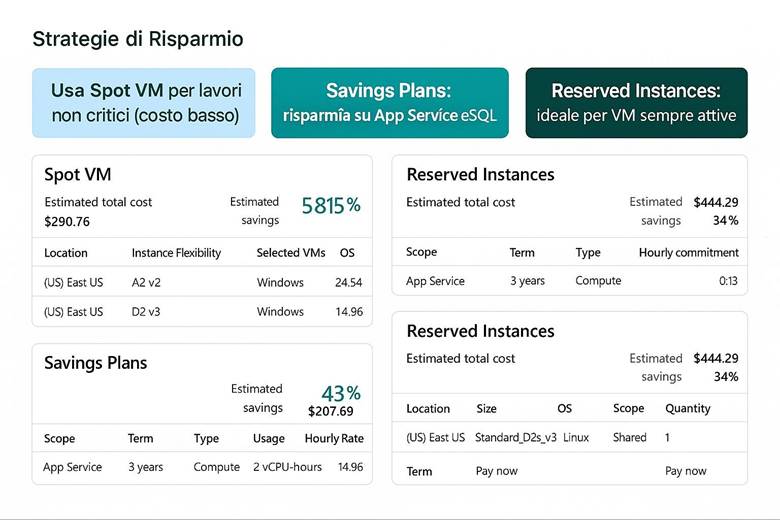

Ottimizzazione dei costi delle VM: Poiché le VM possono rappresentare una voce di spesa significativa in ambiente cloud, Azure fornisce diversi meccanismi per ottimizzarne il costo. Uno dei principali è l’uso di Reserved Instances (RI): si tratta di prenotazioni di capacità di VM per 1 o 3 anni, che in cambio di un impegno di utilizzo offrono sconti notevoli (fino al 70-80% rispetto al pay-as-you-go). Le RI sono convenienti per workload stabili e di lungo periodo (es. un server di produzione sempre acceso). In alternativa, i Savings Plan offrono flessibilità su famiglia e regione di VM, applicando sconti orari in modo più elastico a fronte di un impegno di spesa. Per workload non critici e interrompibili, esistono le Spot VM, che utilizzano capacità inutilizzata di Azure a tariffe fortemente scontate (ma Azure può deallocarle quando ha bisogno di risorse per altri). Le Spot VM sono ideali per job batch, test, o scenari dove un’interruzione non causa problemi seri. Oltre a questi, Azure Advisor nel suo modulo Cost fornisce raccomandazioni, ad esempio segnalando VM con utilizzo CPU molto basso che potrebbero essere ridimensionate (principio del right-sizing), o suggerendo di applicare Azure Hybrid Benefit per risparmiare sui costi di licenza se si hanno già licenze Windows Server o SQL Server attive on-prem. Infine, un semplice accorgimento: arrestare le VM non in uso (soprattutto ambienti di test/dev fuori dall’orario di lavoro) per non pagarne il consumo quando non servono. (Fonte: Azure Cost Management & Billing)

Esempio pratico: Un’azienda che offre servizi di progettazione CAD decide di spostare in Azure il suo ambiente di rendering 3D per sfruttare la scalabilità del cloud. Per questi carichi sceglie VM della serie NVads v5, dotate di GPU ad alte prestazioni, in modo da fornire la potenza grafica necessaria. Ogni VM è associata a dischi gestiti Premium SSD v2 (per assicurare velocità di lettura/scrittura elevate sui dati di progetto) e viene inserita in una rete dedicata con Azure Bastion abilitato, così che i designer possano connettersi alle VM tramite desktop remoto in modo sicuro, senza esporre porte RDP pubblicamente. Per tenere sotto controllo lo stato delle VM, l’azienda abilita Azure Monitor con la soluzione VM Insights, ricavando metriche dettagliate su CPU, memoria e utilizzo GPU, e configura log analytics per tracciare gli eventi di sistema. In base ai dati raccolti, potrebbero impostare alert (ad esempio per notificarli se una sessione di rendering supera un certo tempo o se l’utilizzo della GPU è al 100% per troppo a lungo) e valutare se aggiungere un’altra NVads v5 in un Scale Set per bilanciare il carico. Questo scenario evidenzia come le VM Azure possano soddisfare requisiti molto specifici (GPU, rete sicura, telemetria dettagliata) con un controllo end-to-end da parte dell’azienda, ma richiede parallelamente attenzione nella gestione (monitoraggio continuo e ottimizzazione della spesa, es. usando macchine spot per i job meno urgenti).

Suggerimenti visivi: Un possibile diagramma per questo capitolo potrebbe mostrare un’architettura di deployment tipica con VM. Ad esempio, un disegno con un Load Balancer pubblico che distribuisce traffico su un set di VM in una Availability Zone, con dietro un Azure Scale Set per indicare la possibilità di scalare. Nel diagramma potrebbero comparire anche servizi complementari: un’icona di Azure Key Vault collegata alle VM per la gestione dei segreti (come password o certificati), e un simbolo di Storage che rappresenti i dischi gestiti collegati alle VM (magari distinguendo Premium vs Standard). In aggiunta, si potrebbe mostrare un piccolo riquadro con l’indicazione “Savings: RI/Savings Plan” e “Spot VM” per ricordare i metodi di ottimizzazione dei costi, oppure un grafico a confronto del costo orario pay-as-you-go vs reserved vs spot. Questi elementi aiuterebbero a riassumere visivamente sia l’architettura tecnica che le strategie finanziarie legate alle VM.

7. Monitoraggio e Osservabilità con Azure Monitor

Quando si gestiscono applicazioni e infrastrutture in Azure (o in generale nel cloud), è fondamentale avere visibilità sul loro funzionamento. Azure Monitor è il servizio integrato che fornisce funzionalità di monitoraggio e osservabilità end-to-end sulle risorse Azure, risorse on-premises estese al cloud e persino su altre piattaforme cloud. In questo capitolo approfondiremo cosa offre Azure Monitor e come aiuta a mantenere sotto controllo l’ambiente.

Cos’è Azure Monitor e cosa fa: Azure Monitor raccoglie e centralizza metriche, log e tracce dalle risorse e applicazioni. Le metriche sono valori numerici a intervalli regolari (per esempio CPU utilizzata di una VM, numero di richieste a un’app web al secondo, percentuale di utilizzo di un disco, ecc.), utili per capire le prestazioni in tempo quasi reale. I log sono dati testuali o semi-strutturati che descrivono eventi (ad esempio log di attività di Azure, log di applicazione, eventi di sistema delle VM, ecc.), adatti per analisi dettagliate, auditing e diagnostica. Le traces (tracce) si riferiscono spesso a informazioni di transito di applicazioni, utili soprattutto in contesti di debug o APM (Application Performance Management). Azure Monitor non solo raccoglie questi dati, ma offre strumenti per visualizzarli e agire su di essi: si possono creare dashboard personalizzati e workbook interattivi per rappresentare graficamente l’andamento delle metriche e correlare dati; si possono impostare regole di alert che inviano notifiche o attivano azioni automatiche quando certi valori superano soglie (ad esempio, un alert su “CPU > 80% per più di 5 minuti”); e si integrano servizi come Autoscale (che utilizza metriche di monitor per scalare risorse automaticamente) o Logic Apps/Automation per reagire a eventi specifici. Azure Monitor funge insomma da “occhi e orecchie” dell’operatore cloud, consentendo un approccio proattivo alla gestione: invece di scoprire i problemi dai disservizi, si ricevono avvisi e si osservano trend per intervenire in anticipo. (Fonti: Azure Monitor overview, Data platform – the 3 pillars)

Insights e monitoraggio specializzato: Azure Monitor fornisce delle soluzioni pronte all’uso chiamate Insights per servizi specifici. Ad esempio, VM Insights offre viste specifiche per monitorare macchine virtuali (mostrando immediatamente CPU, memoria, consumo di disco e rete, e identificando le top process che consumano risorse in una VM). Container Insights fa lo stesso per orchestratori come Kubernetes (AKS), dando visibilità su cluster, nodi e performance dei container. Azure Monitor for Networks fornisce mappe e stato di connessione per resource di rete (VPN, ExpressRoute, ecc.). Esistono anche Application Insights, integrata in Azure Monitor, che è una soluzione APM per applicazioni custom: permette di tracciare richieste end-to-end, eccezioni applicative, e analizzare la user experience (ad esempio tempi di caricamento di pagine web, percentuali di errori HTTP). Queste soluzioni insight semplificano il monitoraggio perché offrono dashboard predefiniti e logiche già pronte per l’analisi di quei particolari servizi, senza richiedere all’utente di costruire tutto manualmente. Naturalmente, Azure Monitor rimane estensibile e consente di scrivere query Kusto (KQL) sui log aggregati nel Log Analytics Workspace per fare analisi avanzate, correlare dati di diverse origini (es. log di applicazione con log di infrastruttura) e generare report personalizzati. (Fonte: Azure Monitor Insights overview)

Esempio pratico: Un team DevOps configura Azure Monitor per un’applicazione enterprise composta da più componenti: macchine virtuali, database SQL, e un’applicazione .NET ospitata su App Service. Per prima cosa, abilita Log Analytics Workspace e collega ad esso tutte le risorse – così i log di attività Azure, i log delle VM (tramite l’agente Diagnostics), e i log applicativi (tramite Application Insights per .NET) confluiscono in un unico archivio interrogabile. Quindi creano alcune Metric Alerts: ad esempio un alert critico se la CPU di una VM rimane sopra l’85% per più di 10 minuti o se la DTU (unità di utilizzo) del database SQL supera una certa soglia. Configurano gli alert in modo che inviino notifiche al team via email e Teams, e che eseguano anche una Azure Function che in caso di CPU alta riavvia un processo specifico sulla VM (azione automatica di auto-riparazione). Contestualmente, preparano un Azure Dashboard che mostra: un grafico in tempo reale delle CPU delle VM, un grafico delle latenze medie delle query SQL, e una tabella con eventuali errori applicativi estratti dai log (ad esempio errori 500 dell’app web). Infine, impostano un workbook per le review mensili di performance, includendo le metriche chiave di SLA (uptime, tempi di risposta medi, utilizzo risorse) e correlando i costi – così da vedere in un unico report come l’utilizzo di risorse impatta sulla spesa. Grazie a questa implementazione, il team riesce a individuare velocemente colli di bottiglia (ad esempio, dal dashboard notano che ogni lunedì mattina la CPU del DB va al 90% e hanno un picco di errori – segnale per ottimizzare una query lenta) e a reagire con prontezza agli incident (il sistema di alert li avvisa immediatamente se qualcosa va fuori soglia, garantendo interventi tempestivi e riducendo il downtime percepito).

Suggerimenti visivi: Una dashboard è l’elemento visivo per eccellenza nel monitoraggio. Per questo capitolo si potrebbe presentare un esempio di dashboard di Azure Monitor con vari riquadri: un grafico lineare mostrante l’andamento della CPU di alcune VM e la memoria utilizzata, accanto un grafico a barre della latenza media di un’applicazione web, sotto una tabella di errori recenti (codici di errore e conteggio) e un elenco degli alert attivi con indicazione di severità. Ogni riquadro avrebbe un titolo (es. “CPU Usage”, “Response Time”, “Error Log”, “Active Alerts”). In alternativa, una serie di piccoli screenshot stilizzati di workbook, Application Insights map (che mostra la mappa delle dipendenze di un’app) ecc., per evidenziare la ricchezza degli strumenti di visualizzazione offerti. Queste immagini aiuterebbero a fissare l’idea che Azure Monitor permette di vedere realmente cosa accade nel sistema tramite pannelli e grafici in tempo reale.

8. Gestione dei costi e Budgeting nel cloud Azure

Uno dei vantaggi del cloud è il modello di costo flessibile, ma senza un adeguato controllo il rischio di superare il budget è concreto. Azure fornisce strumenti dedicati al Cost Management e al Billing (fatturazione) per aiutare gli utenti ad analizzare, monitorare e ottimizzare la spesa legata ai servizi cloud. In questo capitolo vedremo come tenere sotto controllo i costi in Azure e adottare pratiche per una gestione finanziaria efficiente.

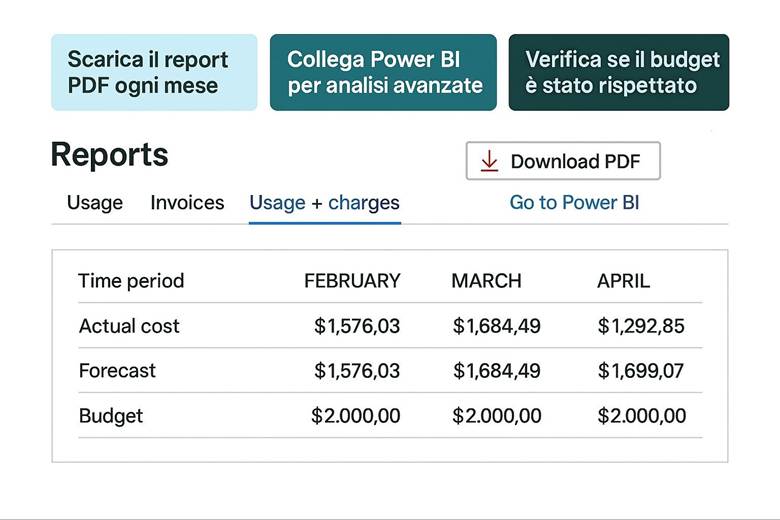

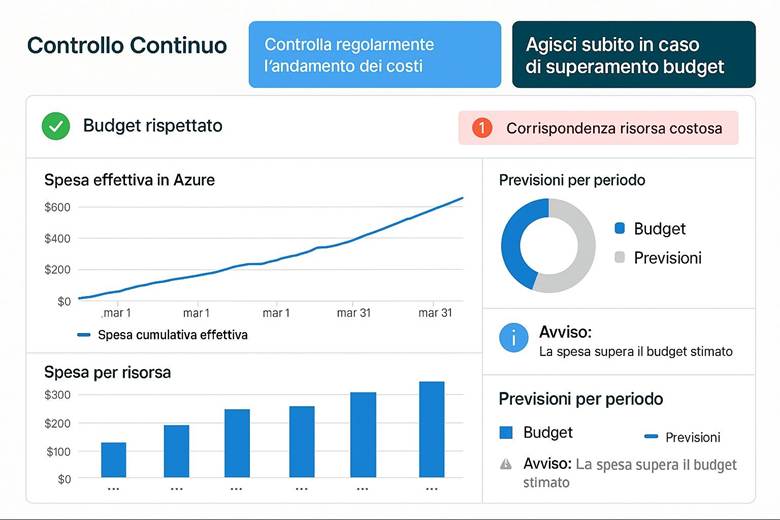

Azure Cost Management + Billing: Questo è il portale e insieme di servizi nativi per il controllo dei costi Azure. Tramite Cost Management è possibile visualizzare la spesa suddivisa per servizio, per risorsa o per gruppo di risorse, e filtrarla per periodi di tempo o per tag. Ad esempio, si può vedere quanto si è speso nell’ultimo mese in Macchine Virtuali, o quanto costa un certo progetto (se tutte le risorse di quel progetto condividono un tag identificativo). Una funzionalità chiave è la creazione di budget: si possono definire soglie di spesa (mensili, trimestrali, annuali) per la propria subscription o RG e ricevere alert quando si supera una certa percentuale di quel budget (ad esempio avviso al 80% e al 100% del budget mensile consumato). Cost Management offre anche viste di riportistica e forecast: proietta la spesa a fine periodo sulla base dell’andamento corrente, aiutando a capire se si rischia uno sforamento. Nella sezione Recommendations vengono inoltre evidenziate opportunità di ottimizzazione collegate ad Azure Advisor – ad esempio suggerisce di deallocare risorse sottoutilizzate o di acquistare riservations/savings plans per workload costanti. La parte Billing permette invece di gestire metodi di pagamento, fatture, e se si è in un contesto enterprise, di suddividere le spese tra diverse unità aziendali o ricevere fatturazione consolidata. (Fonti: Azure Cost Management and Billing docs, FinOps in Azure)

Pratiche consigliate di gestione costi: Per evitare brutte sorprese e assicurarsi che il cloud rimanga conveniente, si raccomanda di seguire alcune best practice:

· Definizione dello scope di analisi: organizza le risorse in modo che sia semplice attribuire i costi. L’uso di tag appropriati (ad esempio tag Department, Project, Environment) e di Resource Group dedicati per progetto/cliente facilita l’analisi granulare. Inoltre, sfrutta la suddivisione in subscription se hai bisogno di separare nettamente ambienti di costo (alcune aziende mettono progetti di clienti diversi in subscription diverse per isolare la rendicontazione).

· Monitoraggio proattivo e alert finanziari: non aspettare la fattura a fine mese per accorgerti di anomalie. Imposta budget mensili per progetto e attiva gli alert. Azure può anche rilevare anomalie di costo (spike insoliti) e notificare se ad esempio in un giorno si spende molto più della media – questo è utile per individuare subito problemi, come una risorsa creata per errore che sta generando costi inaspettati.

· Ottimizzazione continua: esamina regolarmente le raccomandazioni di Azure Advisor e di Cost Management. Valuta di applicare Azure Hybrid Benefit se hai licenze Windows/SQL già possedute, così da usarle sulle VM e non pagarle di nuovo (porta risparmi significativi). Fai right-sizing delle risorse: se un database usa solo il 10% delle prestazioni di cui è capace, riduci la sua SKU; se una VM è costantemente sottoutilizzata, spostala a una taglia inferiore o valuta servizi PaaS. Pianifica anche gli orari: spegnere ambienti di sviluppo notturni e nei weekend può tagliare la spesa di un buon 20-30% annuale.

· Visibilità e accountability: condividi con i team i report di costo (magari con dashboard su SharePoint o esportando i dati verso Power BI). Assicurati che ogni team conosca il proprio consumo e responsabilizzali su obiettivi di efficienza. In contesti avanzati di FinOps, si tengono riunioni regolari per rivedere l’andamento dei costi e ottimizzare architetture in ottica cost-aware.

Esempio pratico: Una startup che gestisce una piattaforma SaaS in Azure decide di mettere sotto controllo i costi fin dall’inizio. Crea un budget mensile di, poniamo, 5.000€, e imposta avvisi: uno al raggiungimento dell’80% (4.000€) e uno al 100%. A metà mese riceve un alert dell’80% e questo porta il team a investigare: scoprono che un ambiente di test dimenticato acceso stava esaurendo il budget. Spengono le risorse di test e valutano l’uso di Auto-shutdown pianificato per quelle VM la sera. Inoltre, guardando i report, notano che la voce “Azure App Service” incide molto: approfondendo, vedono che sono attivi istanze in S2 tier per tutti i clienti, anche quelli piccoli. Decidono quindi di passare i clienti minori a un tier più economico S1, riducendo i costi senza impatto. A fine mese restano entro il budget e preparano un dashboard costi per il mese successivo, evidenziando le top 5 risorse per spesa, così da avere immediatamente sotto’occhio dove va la maggior parte del denaro. Inoltre attivano un rapporto programmato settimanale che viene inviato via email ai responsabili, così che non ci siano sorprese. Seguendo questo approccio, la startup adotta una mentalità di continua ottimizzazione: ogni mese investiga la voce di costo maggiore (es. trasferimenti di dati, istanze di database, etc.) e cerca soluzioni per ridurla, come ad esempio utilizzare Reserved Instances per i server sempre attivi (beneficiando di sconti sui loro database di produzione) o sfruttare servizi pass-through come Azure Advisor che suggerisce di eliminare una IP pubblica inutilizzata o di combinare diverse risorse su uno stesso piano tariffario. Queste azioni, sommate, portano risparmi che poi possono essere reinvestiti in nuove funzionalità.

Suggerimenti visivi: Per rappresentare la gestione dei costi, possiamo immaginare tre elementi grafici: (1) un grafico a linea che mostra l’andamento dei costi cumulativi nel mese rispetto al budget (magari con una linea orizzontale che indica il budget e la curva dei costi che si avvicina a quella linea, con un punto evidenziato al superamento di una soglia di alert); (2) una tabella “Budget vs Spesa” in cui si elencano vari budget (per progetto o reparto) affiancati dalla spesa corrente e dalla previsione a fine periodo, evidenziando in rosso quelli che sforeranno; (3) un riquadro con la lista delle raccomandazioni di Azure Advisor per il risparmio – ad esempio: “3 VM sottoutilizzate: potenziale risparmio 200€/mese”, “Abilitare Hybrid Benefit su 2 SQL Server: risparmio 150€/mese”. Questi elementi aiuterebbero a comunicare visivamente l’idea di doversi mantenere entro certi limiti e di avere opportunità concrete di ottimizzazione evidenziate dagli strumenti.

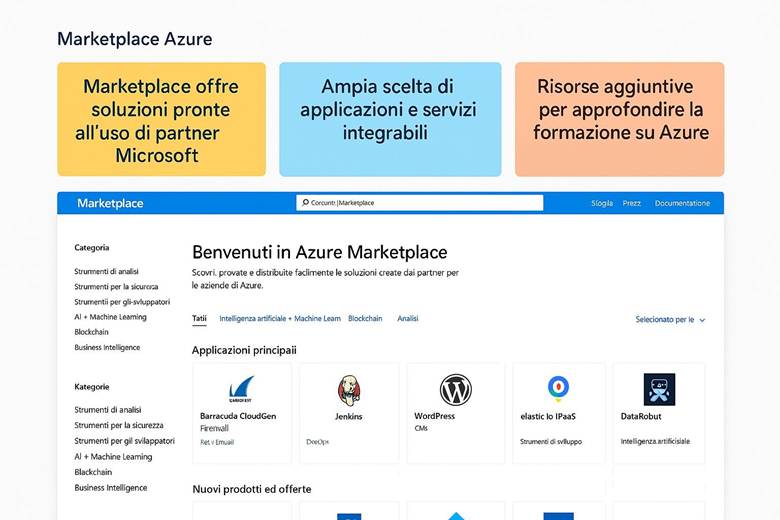

9. Azure Marketplace – Soluzioni pronte dei partner

L’Azure Marketplace è un portale integrato in Azure dove è possibile trovare soluzioni pronte all’uso fornite sia da Microsoft che da partner terzi. In altri termini, è un catalogo online di applicazioni e servizi certificati per essere eseguiti su Azure. In questo capitolo vedremo cos’è il Marketplace, perché può essere utile, e come viene tipicamente utilizzato.

Cos’è Azure Marketplace: Quando si accede al portale Azure e si sceglie “Create a resource”, si sta in effetti consultando l’Azure Marketplace. Questo marketplace include immagini di macchine virtuali preconfigurate, modelli di soluzioni complete (template ARM o soluzioni gestite), servizi SaaS di terze parti integrabili, e anche offerte di servizi professionali (consulenze, supporto) fornite da partner. Esiste anche una versione web pubblica del Marketplace (sito Microsoft) per esplorare le offerte disponibili. Le soluzioni sono categorizzate per tipo (ad esempio: Computing, Networking, Storage, AI + Machine Learning, Security, Databases, DevOps ecc.). Ogni elemento del Marketplace ha una scheda descrittiva con informazioni sul fornitore, sui costi (alcune sono gratuite, altre prevedono costi di licenza o utilizzo), e sulle procedure di installazione. Il Marketplace semplifica la distribuzione di software di terze parti su Azure: invece di dover creare manualmente una VM e installare un software, si può prendere un’immagine già pronta (per esempio un firewall di un certo vendor, o un software open source configurato) e avviarla in pochi clic. (Fonti: Azure Marketplace overview)

Perché usarlo: L’obiettivo del Marketplace è accelerare l’adozione di soluzioni nel cloud. Per le aziende, significa avere a disposizione un ecosistema di soluzioni testate e supportate: si possono trovare database popolari (MySQL, PostgreSQL) già configurati, appliance di sicurezza (come firewall, IPS/IDS) di vendor noti, applicazioni enterprise (SAP, Dynamics) pronte all’installazione, immagini di macchine con software di sviluppo, stack completi (es. LAMP) e molto altro. Usare il Marketplace può far risparmiare tempo perché elimina la necessità di re-inventare la ruota per configurare qualcosa di standard. Inoltre, la fatturazione di queste soluzioni è integrata nella bolletta Azure: se ad esempio si utilizza un firewall di terze parti a pagamento tramite Marketplace, i costi di licenza vengono addebitati sullo stesso account Azure, semplificando la gestione finanziaria. Anche gli aggiornamenti e la compatibilità sono garantiti dal fornitore attraverso il Marketplace, offrendo una maggiore tranquillità rispetto al fai-da-te. Per i partner ISV (Independent Software Vendors), il Marketplace è un canale per raggiungere i clienti Azure con le proprie soluzioni ottimizzate per il cloud.

Esempio pratico: Un team di sviluppo ha bisogno di un sistema di gestione dei contenuti (CMS) per lanciare rapidamente un sito web aziendale. Anziché creare una VM e installare manualmente un CMS open source, decidono di cercare sul Marketplace e trovano una immagine di WordPress ufficiale (offerta dalla community o da Microsoft). In pochi click, l’immagine viene distribuita come Web App con un database MySQL in Azure (o come VM Linux con tutto preinstallato), pronta all’uso. Questo accelera enormemente la messa online. In un altro scenario, un’azienda vuole adottare un’appliance di sicurezza di un partner (ad esempio un firewall Palo Alto Networks): tramite Marketplace può provisioningare il firewall virtuale già pronto all’uso su Azure e poi configurarlo con le regole necessarie. Ancora, si può pensare al caso di integrazione di servizi AI: se un partner offre un API di intelligenza artificiale come servizio, l’azienda può sottoscriverla via Marketplace e la spesa andrà sulla bolletta Azure, evitando contratti separati. Tutto questo evidenzia come il Marketplace aiuti a ridurre la complessità nella fase iniziale di avvio di soluzioni, permettendo di concentrarsi più sulla customizzazione e configurazione applicativa che sull’installazione base.

Suggerimenti visivi: Per rappresentare l’Azure Marketplace, si potrebbe realizzare una griglia di icone suddivise per categorie: ad esempio un riquadro con titolo Database contenente i loghi di MySQL, MongoDB, Cassandra; un riquadro Security con loghi di appliance firewall/popular security solutions; Analytics con icone di piattaforme di BI o big data; AI con icone di servizi cognitivi, e così via. Ogni icona potrebbe avere un piccolo badge Azure per indicare che è un’offerta sul marketplace. Un’altra idea è mostrare uno screenshot semplificato della pagina Marketplace con la barra di ricerca e qualche risultato (es: cercando “WordPress” appare la soluzione WordPress ufficiale). Infine, si potrebbe evidenziare il concetto di “Azure benefit”: alcune offerte Marketplace sono “Azure Benefit Eligible”, significa che se ad esempio si hanno crediti Azure o piani di supporto, certe soluzioni possono sfruttarli – un badge nelle icone potrebbe rappresentare questa caratteristica. Queste immagini aiuterebbero a capire la varietà di soluzioni disponibili e l’immediatezza con cui possono essere adottate attraverso la piattaforma Azure.

Conclusioni

In questa guida abbiamo esplorato una panoramica generale di Microsoft Azure, toccando i concetti fondamentali e i servizi principali organizzati per aree tematiche: calcolo, archiviazione, rete, gestione risorse, sicurezza, monitoraggio, cost management e soluzioni pronte. Azure si presenta come una piattaforma matura e ampia, in grado di supportare dai semplici prototipi fino alle architetture enterprise più complesse, il tutto con un modello operativo orientato al cloud che enfatizza flessibilità, scalabilità e pay-per-use.

Per chi si avvicina ad Azure con conoscenze di base o intermedie di cloud computing, è importante comprendere non solo i singoli servizi, ma anche come integrarli in soluzioni complete. Ad esempio, sapere che esistono VM, storage e database gestiti è utile, ma il vero valore si coglie nel combinarli in un’architettura coerente e nell’utilizzare strumenti come Resource Groups, Policy, Monitor per governarli efficacemente. Speriamo che i capitoli di questo eBook abbiano fornito un orientamento chiaro in tal senso, offrendo sia spiegazioni dettagliate sia esempi pratici e suggerimenti visivi per immaginare meglio l’applicazione reale.

Risorse consigliate per approfondire:

· Documentazione Ufficiale Microsoft Learn: il portale Microsoft Learn offre percorsi guidati e tutorial pratici su Azure. Ad esempio, potete trovare i tutorial introduttivi su Azure, i moduli interattivi per ciascun servizio e percorsi come Azure Fundamentals ideali per chi inizia.